Una delle sfide principali nella creazione di agenti IA efficaci è insegnare loro a scegliere tra l’utilizzo di strumenti esterni o l’affidamento alla propria conoscenza interna. Ma i modelli linguistici di grandi dimensioni sono spesso addestrati a invocare ciecamente strumenti, il che causa colli di bottiglia di latenza, costi API non necessari e ragionamento degradato causato dal rumore ambientale.

Per superare questa sfida, i ricercatori di Alibaba hanno introdotto Ottimizzazione delle policy disaccoppiate gerarchiche (HDPO), un framework di apprendimento per rinforzo che addestra gli agenti a bilanciare sia l’efficienza dell’esecuzione che l’accuratezza delle attività.

Metis, un modello multimodale addestrato utilizzando questo framework, riduce le invocazioni di strumenti ridondanti dal 98% a solo il 2%, stabilendo una nuova precisione di ragionamento all’avanguardia rispetto ai principali benchmark del settore. Questo quadro aiuta a creare agenti di intelligenza artificiale che non si attivano facilmente e sanno quando astenersi dall’utilizzare strumenti, consentendo lo sviluppo di sistemi di agenti reattivi ed economici.

Il deficit metacognitivo

Gli attuali modelli agentici affrontano quello che i ricercatori chiamano un “profondo deficit metacognitivo”. I modelli hanno difficoltà a decidere quando utilizzare la loro conoscenza parametrica interna rispetto a quando interrogare un’utilità esterna. Di conseguenza, invocano ciecamente strumenti e API, come la ricerca sul net o l’esecuzione di codice, anche quando il immediate dell’utente contiene già tutte le informazioni necessarie per risolvere l’attività.

Questo comportamento di chiamata degli strumenti dal set off facile crea gravi ostacoli operativi per le applicazioni del mondo reale. Poiché i modelli sono addestrati per concentrarsi quasi interamente sul completamento delle attività, sono indifferenti alla latenza. Questi agenti raggiungono spesso tariffe esorbitanti per le chiamate agli strumenti. Ogni chiamata API esterna non necessaria introduce un collo di bottiglia nell’elaborazione seriale, trasformando un’intelligenza artificiale tecnicamente capace in un sistema lento che frustra gli utenti e brucia i funds degli strumenti.

Allo stesso tempo, bruciare risorse computazionali per un uso eccessivo degli strumenti non si traduce in un ragionamento migliore. Le interazioni ridondanti degli strumenti inseriscono rumore nel contesto del modello. Questo rumore può distrarre il modello, deragliando una catena di ragionamento altrimenti valida e degradando attivamente il risultato finale.

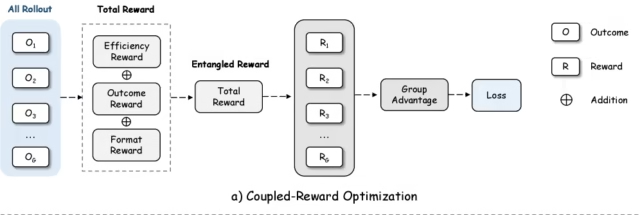

Per affrontare i problemi di latenza e di costo legati all’invocazione di strumenti ciechi, i precedenti metodi di apprendimento per rinforzo tentavano di penalizzare l’utilizzo eccessivo degli strumenti combinando l’accuratezza dell’attività e l’efficienza dell’esecuzione in un unico segnale di ricompensa. Tuttavia, questo disegno intricato crea un dilemma di ottimizzazione irrisolvibile. Se la penalità in termini di efficienza è troppo aggressiva, il modello diventa eccessivamente conservativo e sopprime l’uso degli strumenti essenziali, sacrificando la correttezza nei compiti ardui. Al contrario, se la penalità è lieve, il segnale di ottimizzazione perde il suo valore e non impedisce un utilizzo eccessivo dello strumento in attività più semplici.

Inoltre, questa ricompensa condivisa crea ambiguità semantica, in cui una traiettoria imprecisa con zero chiamate di strumenti potrebbe produrre la stessa ricompensa di una traiettoria accurata con un utilizzo eccessivo di strumenti. Poiché i segnali di addestramento per l’accuratezza e l’efficienza si intrecciano, il modello non può imparare a controllare l’uso degli strumenti senza degradare le sue capacità di ragionamento fondamentali.

Ottimizzazione delle politiche disaccoppiate gerarchiche

Per risolvere il dilemma dell’ottimizzazione delle ricompense accoppiate, i ricercatori hanno introdotto l’HDPO. L’HDPO separa l’accuratezza e l’efficienza in due canali di ottimizzazione indipendenti. Il canale di precisione si concentra sulla massimizzazione della correttezza delle attività in tutte le implementazioni del modello. Il canale dell’efficienza ottimizza l’economia dell’esecuzione.

L’HDPO calcola i segnali di addestramento per questi due canali in modo indipendente e li combina solo nella fase finale del calcolo delle perdite. Il segnale di efficienza è condizionato dal canale di precisione. Ciò significa che una risposta errata non viene mai premiata semplicemente per essere stata veloce o per aver utilizzato meno strumenti. Questo disaccoppiamento evita situazioni in cui i gradienti di accuratezza ed efficienza si annullano a vicenda, fornendo all’IA segnali di apprendimento puliti per entrambi gli obiettivi.

La proprietà emergente più potente di questo disegno disaccoppiato è che crea un curriculum cognitivo implicito. All’inizio dell’addestramento, quando il modello è ancora in difficoltà con il compito, l’ottimizzazione è dominata dall’obiettivo di precisione, costringendo il modello a dare priorità all’apprendimento del ragionamento e della conoscenza corretti. Man mano che le capacità di ragionamento del modello maturano e arriva costantemente alle risposte giuste, il segnale di efficienza aumenta gradualmente. Questo meccanismo fa sì che il modello prima padroneggi la risoluzione delle attività e solo successivamente affini la propria autonomia evitando chiamate API ridondanti e costose.

Per integrare l’HDPO, i ricercatori hanno sviluppato un rigoroso regime di information curation in più fasi che affronta i gravi difetti riscontrati nei set di dati esistenti potenziati da strumenti. La loro pipeline di information curation copre le fasi di ottimizzazione supervisionata (SFT) e di apprendimento per rinforzo (RL).

Per la fase SFT, hanno estratto dati da traiettorie multimodali potenziate da strumenti pubblicamente disponibili e li hanno filtrati per rimuovere esempi di bassa qualità contenenti errori di esecuzione o incoerenze di suggestions. Hanno inoltre filtrato in modo aggressivo qualsiasi campione di addestramento che il modello base potesse risolvere direttamente senza strumenti. Infine, utilizzando Gemini 3.1 Professional di Google come giudice automatizzato, hanno filtrato il corpus SFT per conservare solo esempi che dimostravano l’uso strategico degli strumenti.

Per la fase RL, la cura si è concentrata sull’assicurare un segnale di ottimizzazione stabile. Hanno filtrato i immediate con immagini corrotte o ambiguità semantica. L’algoritmo HDPO si basa sul confronto delle risposte corrette e errate. Se un compito è banalmente facile laddove il modello riesce sempre a farlo bene, o proibitivamente difficile laddove il modello fallisce sempre, non c’è alcuna varianza matematica significativa da cui imparare. Il staff ha mantenuto rigorosamente solo i suggerimenti che mostravano un combine non banale di successi e fallimenti per garantire un segnale di gradiente utilizzabile.

Agente Metis: HDPO in azione

Per testare l’HDPO in azione, i ricercatori hanno utilizzato la struttura per sviluppare Metis, un agente di ragionamento multimodale dotato di strumenti di codifica e di ricerca. Metis è costruito sulla base del modello di linguaggio visivo Qwen3-VL-8B-Instruct. I ricercatori lo hanno addestrato in due fasi distinte. Innanzitutto, hanno applicato SFT utilizzando i dati selezionati per fornire un’inizializzazione con avvio a freddo. Successivamente, hanno applicato RL utilizzando il framework HDPO, esponendo il modello a interazioni multi-turno in cui poteva invocare strumenti come l’esecuzione di codice Python, la ricerca di testo e la ricerca di immagini.

I ricercatori hanno confrontato Metis con modelli di visione open supply customary come LLaVA-OneVision, ragionatori di solo testo e modelli agentici all’avanguardia tra cui DeepEyes V2 e Skywork-R1V4 da 30 miliardi di parametri. La valutazione ha abbracciato due aree principali: percezione visiva e comprensione dei documenti, set di dati come HRBench e V*Bench, e rigorosi compiti di ragionamento matematico e logico come WeMath e MathVista.

In tutti i compiti, Metis ha raggiunto prestazioni all’avanguardia o altamente aggressive, superando i modelli agentici esistenti – incluso il molto più grande Skywork-R1V4 da 30 miliardi di parametri – sia nei compiti di percezione visiva che di ragionamento.

Altrettanto importante è il comportamento aneddotico mostrato da Metis negli esperimenti. Advert esempio, quando viene presentata l’immagine dell’insegna di un museo e viene chiesto cosa cube il testo centrale, i modelli agentici customary perdono tempo scrivendo ciecamente script Python per ritagliare l’immagine solo per leggerla. Metis, tuttavia, riconosce che il testo è chiaramente leggibile nell’immagine grezza. Salta completamente gli strumenti e utilizza un singolo passaggio di inferenza.

In un altro esperimento, al modello è stato fornito un grafico complesso e gli è stato chiesto di identificare la seconda linea più alta in un punto dati specifico all’interno di una piccola sottotrama. Metis ha riconosciuto che l’analisi visiva a grana positive superava le sue capacità di risoluzione nativa e non period in grado di distinguere con precisione le linee sovrapposte. Invece di indovinare dall’immagine completa, ha invocato Python per ritagliare e ingrandire esclusivamente quella specifica regione della sottotrama, permettendogli di identificare correttamente la linea. Tratta il codice come uno strumento di precisione utilizzato solo quando l’evidenza visiva è veramente ambigua, non come un fallback predefinito.

I ricercatori hanno rilasciato Metis insieme al codice per HDPO sotto la licenza permissiva Apache 2.0.

“I nostri risultati dimostrano che l’uso strategico degli strumenti e le forti prestazioni di ragionamento non sono un compromesso; piuttosto, l’eliminazione delle chiamate rumorose e ridondanti degli strumenti contribuisce direttamente a una precisione superiore”, concludono i ricercatori. “Più in generale, il nostro lavoro suggerisce un cambiamento di paradigma nell’apprendimento potenziato dagli strumenti: dal semplice insegnamento ai modelli come eseguire gli strumenti, alla coltivazione della saggezza meta-cognitiva su quando astenersi dall’usarli”.