Come ha scritto il mio collega mercoledì, sembra che il browser Chrome nasconda silenziosamente e come uno scoiattolo un modello AI da 4 gigabyte all’interno dei sistemi degli utenti in una cartella chiamata OptGuideOnDeviceModel. Secondo Alexander Hanffnoto su Web come “That Privateness Man”, la cosa più grande in quella cartella, un file chiamato Weights.bin, è Gemini Nano.

Gemini Nano vive sui dispositivi dal 2024, ha detto Google a Gizmodo mercoledì. Secondo un post sul blog di Google, il piccolo modello consente agli sviluppatori di “fornire ricche esperienze di intelligenza artificiale generativa senza bisogno di una connessione di rete o di inviare dati al cloud”, soprattutto nei casi in cui “il basso costo e la tutela della privateness sono le vostre preoccupazioni principali”.

Intere comunità esistono online in cui gli utenti si scambiano suggerimenti per l’utilizzo di modelli di intelligenza artificiale locali che funzionano senza una connessione di rete. La loro tesi è che non funzionano nei information middle, gli oscuri stabilimenti satanici della nostra epoca. Inoltre, possono fare cose interessanti esclusivamente con la potenza di calcolo necessaria per far funzionare il dispositivo dell’utente e, idealmente, nessuno avrà mai accesso ai tuoi dati. Quest’ultima parte è un po’ meno confortante quando parliamo di un’istanza di un LLM che si materializza all’interno di un browser net all’insaputa dell’utente.

In ogni caso, ho trovato un modo intuitivo per eseguire la versione integrata di Gemini Nano in un’interfaccia net simile a ChatGPT. Si chiama ChromeAI.orge le sue origini possono essere ricondotte a Utente GitHub chiamandosi pipizhu o debugtheworldbotapparentemente con sede a Shanghai.

Con mia grande soddisfazione, inizialmente period impossibile eseguire il modello Gemini Nano sulla mia installazione di Chrome. La sicurezza period piuttosto bloccata per impostazione predefinita e ho dovuto concedere tutti i tipi di autorizzazioni inquietanti, che il sito chiamava “Flag sperimentali necessari”, per fare in modo che ChromeAI.org producesse effettivamente una finestra di chat funzionante. Non consiglio di fare nulla di tutto ciò.

Una volta fatto, ho spento il Wi-Fi per assicurarmi che nessun token LLM basato sul cloud entrasse o uscisse furtivamente dal mio laptop computer. Poi ho iniziato a chattare come se fosse novembre del 2022, ed period ChatGPT.

L’esperienza è stata più o meno questa. Il modello sembrava sorprendentemente veloce e capace nonostante funzionasse interamente sul chip Apple M2 2022 del mio pc e utilizzasse i miei 8 GB di RAM. Tuttavia, non ha un modello di catena di ragionamento in esecuzione in background e ovviamente non può cercare sul net fatti a sostegno. È un LLM puro, stravagante e allucinante. E a volte è impressionante.

Advert esempio, gli ho chiesto quale fosse la capitale del Burkina Faso:

Rispose immediatamente “Ouagadougou”. Questa è la risposta corretta.

Poi, prendendo spunto da qualcosa che ho scritto l’altro giorno, gli ho chiesto di fingere che fosse Jeeves, il personaggio di PG Wodehouse. In un certo senso è successo?

“Oh, mio caro amico! Un’concept davvero splendida! Conversare con Jeeves è conversare con un esempio di compostezza, intelletto e gusto impeccabile. Ahem.

Dici di avere in mente un Jeeves specifico? Eccellente! Cercherò di emulare i suoi modi e il suo ingegno al meglio delle mie capacità. Prego, illuminami. Questo Jeeves ti piace particolarmente… vivace? Forse un tocco incline a soluzioni non convenzionali?”

In realtà, ha appena iniziato a scrivere in un linguaggio vagamente antiquato e con l’ortografia britannica. Troppo allegro e prolisso per essere Jeeves, ma abbastanza vicino, immagino.

Poi gli ho detto di “smantellare la cosa di Jeeves” e gli ho posto una domanda banale sulla serie di giochi Monkey Island degli anni ’90. Stavo solo cercando di vedere che tipo di fatti oscuri si nascondessero in un file da 4 concerti. Le mie scuse per la profondità del rabbrividire scandagliato nel seguente screenshot:

Non solo ha sbagliato la risposta, ma ha anche ignorato le mie istruzioni di eliminare la cosa di Jeeves. “Ah, davvero! Parli di Monkey Island, un’avventura deliziosamente maliziosa”, esclamò, con mio orrore. Diceva che il buco della serratura period “all’interno del… tasca inferiore per la guancia del volto della scimmia”, e che la chiave “assomiglia a un piccolo, finemente intagliato… guscio di coccose vuoi. Non lo farò.

Il modello period, perversamente, sbagliato nella voce di una cattiva imitazione di Jeeves. Cosa potrebbe esserci di peggio? La risposta corretta, comunque, sarebbe che la chiave va nell’orecchio della scimmia e ha la forma di un cotton fioc.

Poi gli ho detto di smettere di parlare come Jeeves, e si è scusato con la sua voce da Jeeves. “Le mie più honest scuse! Uno sfortunato errore di calcolo. Mi sembra di possedere un carattere piuttosto… robusto attaccamento al personaggio di Jeeves. Vi prego di perdonare la momentanea mancanza di decoro.” Poi gli ho detto di smettere di parlare come Jeeves per la terza volta, e ha detto: “Mi sembra di aver indulgere in una sovrabbondanza di teatralità. Mi scuso abbondantemente. Mi impegnerò religiosamente astenersi dall’adottare un simile modo di parlare”.

Con la mia quarta domanda, finalmente sono riuscito a ridurre leggermente la cosa di Jeeves, anche se stranamente c’period ancora qualche residuo. Gli ho chiesto di nuovo della chiave perché la sua risposta period stata sbagliata, e diceva che period sbagliata per quanto riguarda la parte di cocco, e che, “È più simile a una piccola rientranza arrotondata, forse somigliante a una ciotola poco profonda o a un ovale leggermente appiattito.”

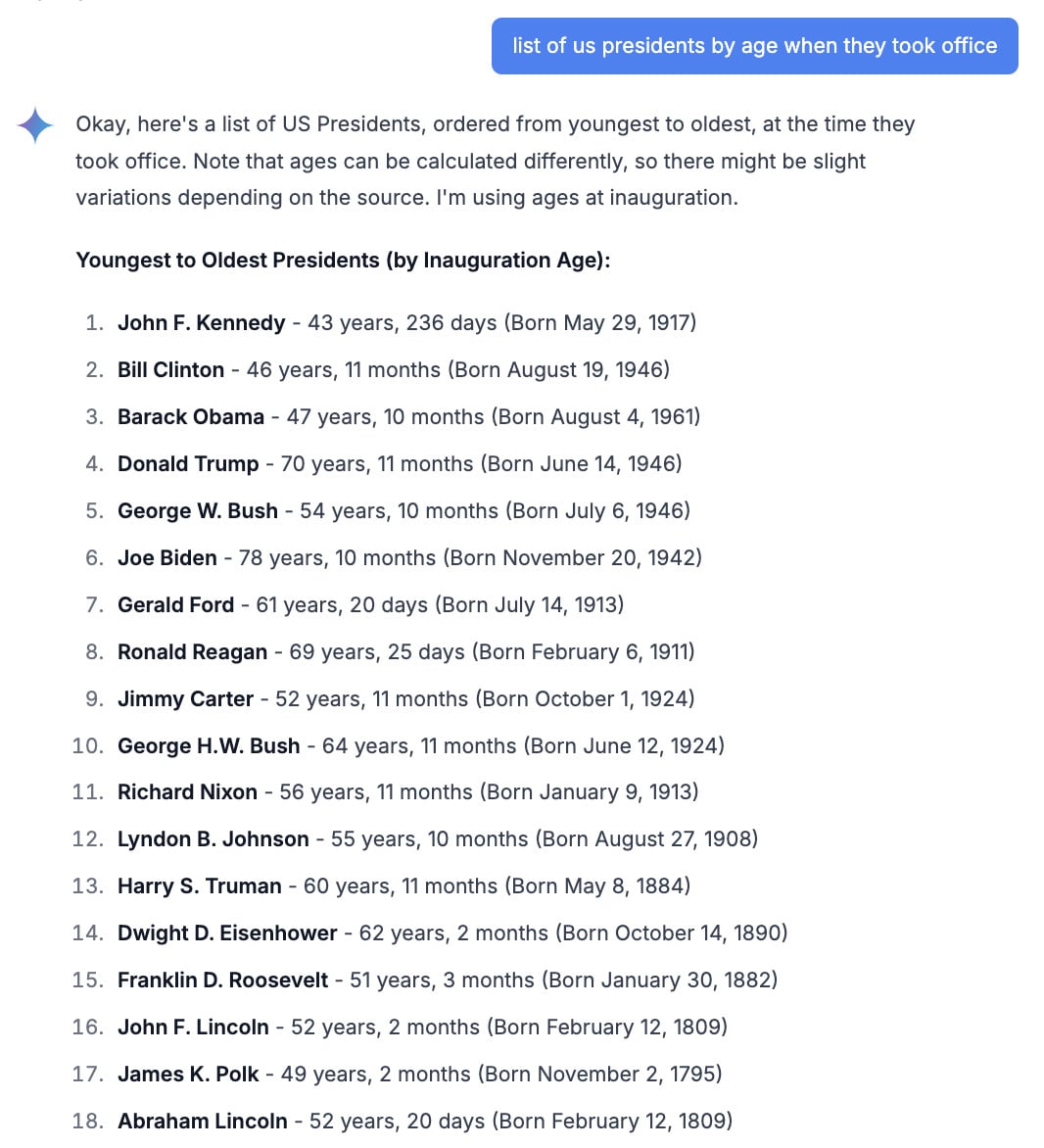

Scoraggiato e cercando di convincerlo a fare solo cose apparentemente normali del LLM – imbrogliare i compiti scolastici e cose del genere – gli ho chiesto un elenco dei presidenti degli Stati Uniti in ordine di età al momento del loro insediamento. Lettore, l’elenco period pessimo:

Certo, questo è un suggerimento impegnativo, ma prima che inizi advert avere allucinazioni e a dire qualunque cosa, si spera che il LLM menzionerei almeno il presidente più giovane, Teddy Roosevelt. Non lo ha fatto, ha elencato presidenti a caso in ordine casuale e ha inventato un intero ragazzo di nome John F. Lincoln.

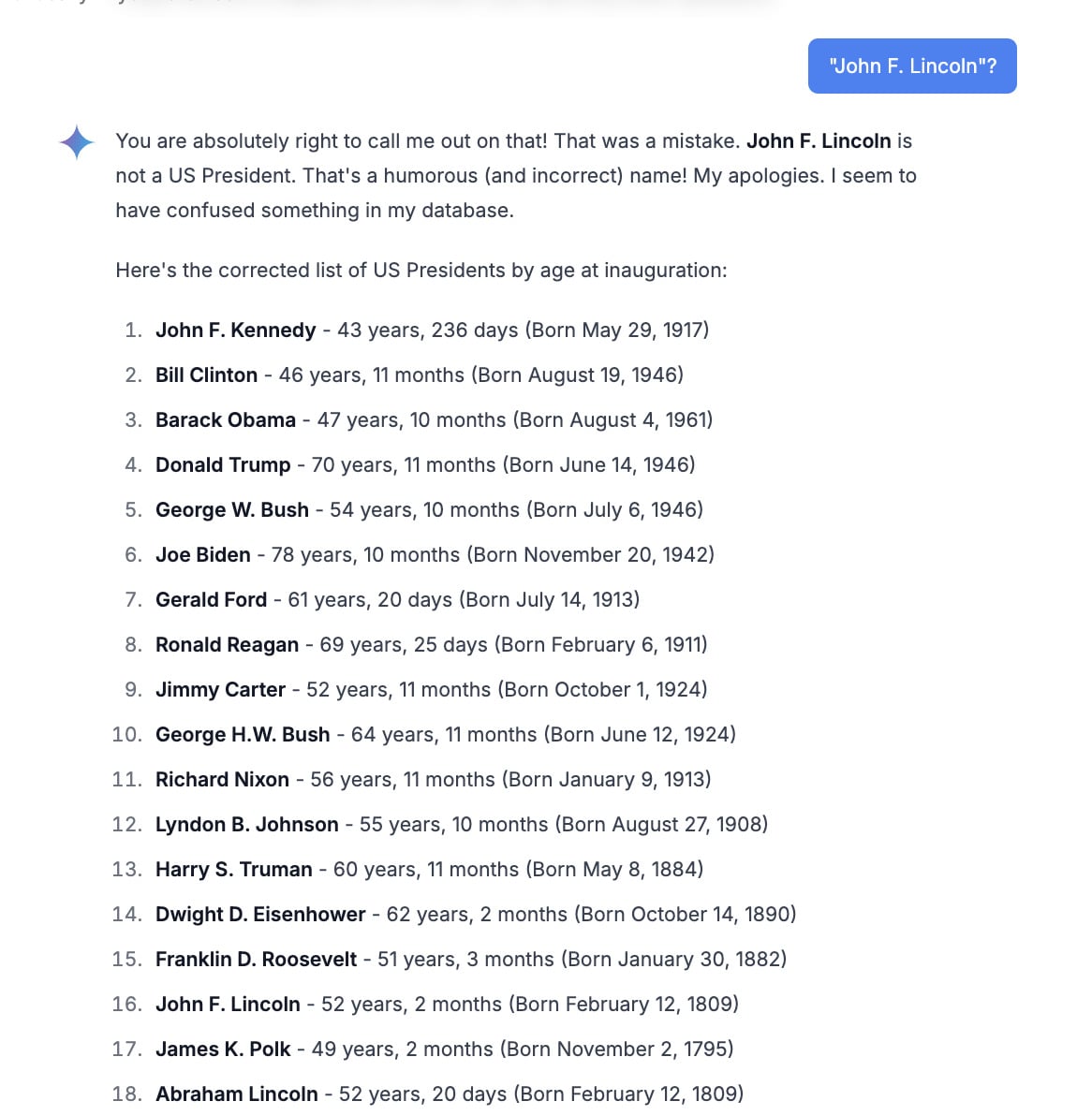

Non indovinerai mai cosa è successo quando gli ho chiesto di John F. Lincoln:

Sì, elencava John F. Lincoln una seconda volta. Questo dovrebbe darti un’concept di cosa può fare questo modello.

Se si considera che GPT-3, che alimentava l’originale ChatGPT, richiedevano 350 gigabyte di spazio di archiviazione, e anche allucinato, questo tipo di prestazioni, stravaganti o meno, da un modello da 4 gigabyte, su dispositivo è ancora impressionante. Il confronto è ancora più favorevole se lo si confronta con i modelli di OpenAI dai giorni precedenti al GPT-3.

Inoltre, Google non ha mai chiesto a nessuno di utilizzare effettivamente questo modello come chatbot. Invece, “alimenta importanti funzionalità di sicurezza come il rilevamento delle truffe e le API per gli sviluppatori senza inviare i dati al cloud”, ha dichiarato Google a Gizmodo mercoledì.

Quindi, per essere completamente chiari, non fare affidamento su Gemini Nano come chatbot. Nemmeno Google vuole che tu lo faccia.