La formazione di modelli di ragionamento basati sull’intelligenza artificiale richiede risorse di cui la maggior parte dei workforce aziendali non dispone. I workforce di ingegneri sono spesso costretti a scegliere tra distillare conoscenze da modelli grandi e costosi o affidarsi a tecniche di apprendimento per rinforzo che forniscono suggestions scarsi.

I ricercatori di JD.com e various istituzioni accademiche hanno recentemente introdotto un nuovo paradigma di formazione che elude questo dilemma. La tecnica, chiamata Apprendimento per rinforzo con ricompense verificabili con auto-distillazione (RLSD), combina il monitoraggio affidabile delle prestazioni dell’apprendimento per rinforzo con il suggestions granulare dell’auto-distillazione.

Gli esperimenti indicano che i modelli addestrati con RLSD hanno prestazioni migliori di quelli costruiti sulla distillazione classica e sugli algoritmi di apprendimento per rinforzo. Per i workforce aziendali, questo approccio riduce le barriere tecniche e finanziarie alla creazione di modelli di ragionamento personalizzati su misura per una specifica logica aziendale.

Il problema con l’addestramento dei modelli di ragionamento

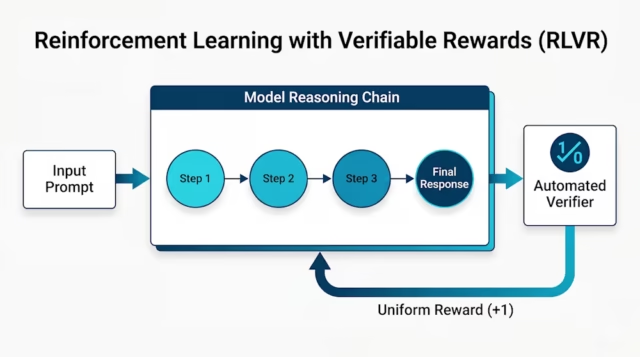

Il metodo commonplace per addestrare i modelli di ragionamento è Apprendimento per rinforzo con ricompense verificabili (RLVR). In questo paradigma, il modello apprende attraverso tentativi ed errori, guidato da un risultato finale proveniente dal suo ambiente. Un verificatore automatico controlla se la risposta del modello è giusta o sbagliata, fornendo una ricompensa binaria, come 0 o 1.

RLVR soffre di suggestions sparse e uniformi. “Il GRPO commonplace ha un problema di densità del segnale”, ha detto a VentureBeat Chenxu Yang, coautore dell’articolo. “Una traccia di ragionamento composta da migliaia di token ottiene una singola ricompensa binaria e ogni token all’interno di quella traccia riceve lo stesso credito, sia che si tratti di un passaggio logico fondamentale o di una frase usa e getta.” Di conseguenza, il modello non apprende mai quali passaggi intermedi hanno portato al suo successo o al suo fallimento.

La On-Coverage Distillation (OPD) adotta un approccio diverso. Invece di aspettare il risultato finale, gli sviluppatori accoppiano un modello di studente più piccolo con un modello di insegnante più grande e più capace. Per ogni esempio formativo, lo studente confronta, gettone per gettone, la sua risposta con quella dell’insegnante. Ciò fornisce allo studente un suggestions granulare sull’intera catena di ragionamento e sul processo di generazione della risposta.

L’implementazione e l’esecuzione di un modello insegnante separato e massiccio insieme allo studente durante l’intero processo di formazione comporta un enorme sovraccarico computazionale. “È necessario mantenere un modello di insegnante più ampio durante tutta la formazione, il che raddoppia all’incirca l’ingombro della GPU”, ha affermato Yang. Inoltre, i modelli di insegnante e studente devono condividere esattamente la stessa struttura del vocabolario, che, secondo Yang, “esclude silenziosamente la maggior parte delle architetture incrociate, delle modalità incrociate o delle configurazioni multilinguistiche effettivamente gestite dalle aziende”.

La promessa e il fallimento dell’autodistillazione

L’autodistillazione on-policy (OPSD) è emersa come una soluzione progettata per superare le carenze degli altri due approcci. Nell’OPSD, lo stesso modello svolge il ruolo sia dello studente che dell’insegnante.

Durante la formazione, lo studente riceve una richiesta commonplace mentre l’insegnante riceve informazioni privilegiate, come una chiave di risposta verificata passo dopo passo. Questa versione del modello per l’insegnante ben informato valuta quindi la versione dello studente, fornendo un suggestions token per token mentre lo studente tenta di risolvere il problema utilizzando solo il immediate commonplace.

L’OPSD sembra essere il compromesso perfetto per il price range aziendale. Fornisce la guida dettagliata e dettagliata dell’OPD. Poiché elimina la necessità di un modello di insegnante esterno, funziona con l’elevata efficienza computazionale e il basso costo di RLVR, richiedendo solo un ulteriore passaggio in avanti per l’insegnante.

Tuttavia, i ricercatori hanno scoperto che l’OPSD soffre di un fenomeno chiamato “fuga di informazioni privilegiate”.

“L’obiettivo è strutturalmente mal posto”, ha detto Yang. “C’è un divario irriducibile di informazione reciproca che lo studente non potrà mai colmare… Quando l’auto-distillazione viene impostata come abbinamento della distribuzione, allo studente viene chiesto di imitare la distribuzione completa dell’output dell’insegnante in un contesto privilegiato.”

Poiché l’insegnante valuta lo studente sulla base di una chiave di risposta nascosta, l’obiettivo formativo costringe il modello dello studente advert apprendere l’esatta frase o i passaggi dell’insegnante invece della logica di ragionamento sottostante. Di conseguenza, il modello studentesco inizia advert avere riferimenti allucinanti a una soluzione invisibile a cui non avrà accesso in una distribuzione nel mondo reale.

In pratica, i modelli OPSD mostrano un rapido picco delle prestazioni all’inizio dell’allenamento, ma le loro capacità di ragionamento presto si stabilizzano e si degradano progressivamente nel tempo.

Disaccoppiamento della direzione dalla magnitudo con RLSD

I ricercatori dietro RLSD si sono resi conto che i segnali che governano il modo in cui un modello aggiorna i suoi parametri hanno requisiti fondamentalmente asimmetrici. Hanno identificato che il segnale che detta la direzione dell’aggiornamento (cioè se rinforzare o penalizzare un comportamento) può essere scarso, ma deve essere perfettamente affidabile, perché indirizzare il modello nella direzione sbagliata danneggia la sua politica di ragionamento.

D’altra parte, il segnale che determina l’entità dell’aggiornamento (vale a dire, quanto credito o colpa relativi merita un passaggio specifico) trae vantaggio dall’essere estremamente denso per consentire correzioni dettagliate e dettagliate.

RLSD si basa su questo principio disaccoppiando la direzione dell’aggiornamento dall’entità dell’aggiornamento. Il quadro consente al suggestions ambientale verificabile proveniente dal segnale RLVR di determinare rigorosamente la direzione dell’apprendimento. Il modello riceve un rinforzo complessivo solo se la risposta finale è oggettivamente corretta.

L’autodidatta viene privato del suo potere di dettare ciò che il modello dovrebbe generare. Invece, la valutazione token per token dell’insegnante viene riproposta per determinare l’entità dell’aggiornamento. Distribuisce semplicemente il merito o la colpa totale tra le singole fasi del percorso di ragionamento del modello.

Ciò altera il modo in cui il modello apprende rispetto al classico paradigma OPSD. Nell’OPSD commonplace, l’obiettivo formativo agisce come una clonazione comportamentale, in cui il modello è costretto a copiare direttamente le parole e le frasi esatte dell’insegnante. Ciò fa sì che lo studente abbia allucinazioni e trapeli riferimenti a dati di cui non dispone.

Invece di forzare il modello a copiare una soluzione nascosta, RLSD fornisce una fonte naturale e praticamente gratuita di informazioni sul credito per token.

“L’intuizione: non stiamo insegnando al modello a ragionare come l’insegnante”, ha detto Yang. “Stiamo dicendo al modello, lungo il percorso che ha scelto, quali dei suoi token stavano effettivamente svolgendo il lavoro. La distribuzione dell’esplorazione del modello rimane la sua. Solo l’allocazione del credito viene migliorata.”

Se una detrazione specifica supporta fortemente il risultato corretto, riceve un punteggio più alto. Se è solo una parola di riempimento inutile, riceve un punteggio di base. RLSD elimina la necessità di addestrare complesse reti di ricompensa ausiliarie, annotare manualmente i dati passo passo o mantenere massicci modelli di insegnanti esterni.

Mettere alla prova RLSD

Per testare l’RLSD, i ricercatori hanno addestrato il modello di linguaggio visivo Qwen3-VL-8B a peso aperto e lo hanno valutato su diversi parametri di riferimento del ragionamento visivo. Questi includevano MMMU per domande multidisciplinari a livello universitario, MathVista, MathVision, WeMath e ZeroBench, un benchmark di stress check esplicitamente progettato per essere quasi impossibile per gli attuali modelli di frontiera.

Hanno confrontato il modello RLSD con il modello base senza post-addestramento, RLVR commonplace tramite l’algoritmo GRPO, OPSD commonplace e una combinazione ibrida dei due.

L’RLSD ha sovraperformato significativamente ogni altro metodo, ottenendo la massima precisione media del 56,18% in tutti e cinque i benchmark. Ha battuto il modello base del 4,69% e ha sovraperformato l’RLVR commonplace del 2,32%. I guadagni sono stati più pronunciati nei compiti di ragionamento matematico complesso, dove l’RLSD ha sovraperformato l’RLVR commonplace del 3,91% sul benchmark MathVision.

Oltre alla precisione, il quadro offre enormi vantaggi in termini di efficienza. “Concretamente, l’RLSD a 200 passaggi di addestramento batte già il GRPO addestrato per 400 passaggi, quindi circa 2 volte la velocità di convergenza”, ha affermato Yang. “Dal punto di vista dei costi, l’unico sovraccarico oltre a una normale pipeline GRPO è un ulteriore passaggio in avanti per risposta per acquisire i log degli insegnanti. Rispetto alla generazione di implementazione… è sostanzialmente gratuito.”

A differenza dell’OPSD, che ha registrato un picco di prestazioni per poi crollare completamente a causa della perdita di informazioni, l’RLSD ha mantenuto la stabilità dell’addestramento a lungo termine e ha convergeto su un tetto prestazionale più elevato rispetto ai metodi commonplace.

I risultati qualitativi evidenziano come il modello altera il suo comportamento di apprendimento. Advert esempio, in un compito di conteggio visivo complesso, l’RLVR commonplace esamina la risposta finale corretta e assegna la stessa ricompensa all’intero paragrafo dei token di ragionamento. RLSD ha applicato chirurgicamente i premi agli specifici passaggi di sottrazione matematica che hanno risolto il problema, riducendo attivamente il peso del testo di riempimento generico come “Guardando l’immagine, vedo…”.

In un altro esempio, il modello ha eseguito una derivazione matematica errata basata su un grafico a barre. Invece di etichettare l’intera risposta come un fallimento, RLSD ha concentrato la penalità più pesante sul punto esatto in cui il modello ha interpretato erroneamente una relazione dal grafico. È rimasto neutrale rispetto al resto dell’impostazione logica, riconoscendo che il quadro iniziale period valido.

Ciò è particolarmente importante per i casi d’uso aziendali disordinati e reali. Se un modello commette un errore analizzando un rapporto trimestrale sugli utili di 50 pagine, gli sviluppatori non vogliono che disimpara l’intero quadro analitico. Vogliono solo che risolva il presupposto specifico che è sbagliato. RLSD consente al modello di apprendere esattamente quali salti logici sono preziosi e quali sono imperfetti, token per token. Poiché RLSD fa ciò riproponendo il modello stesso, fornisce modelli con capacità di ragionamento granulare mantenendo ragionevoli i costi di formazione.

Come possono iniziare le imprese

Per gli ingegneri dei dati e i workforce di orchestrazione dell’intelligenza artificiale, l’integrazione di RLSD è semplice, ma richiede la giusta configurazione. Il requisito più critico è un segnale di ricompensa verificabile, come compilatori di codice, controlli matematici, esecuzione SQL o validatori di schemi. “I compiti senza ricompensa verificabile (dialogo aperto, scrittura vocale del marchio) appartengono a pipeline basate sulle preferenze”, ha affermato Yang.

Tuttavia, RLSD è altamente flessibile per quanto riguarda le informazioni privilegiate di cui ha bisogno. Mentre l’OPSD richiede strutturalmente tracce di ragionamento intermedie full, costringendo le imprese a pagare gli annotatori o a distillare da un modello di frontiera, l’RLSD non lo fa.

“Se disponi di tracce di ragionamento completamente verificate, bene, RLSD le utilizzerà”, ha detto Yang. “Se tutto quello che hai è la risposta definitiva, anche quella funziona… L’OPSD non ha questa flessibilità.”

L’integrazione della tecnica nei framework RL multimodali open supply esistenti come veRL o EasyR1 è incredibilmente leggera. Secondo Yang, non richiede alcuna riscrittura del framework e si inserisce direttamente nello stack commonplace. Lo scambio di codice prevede semplicemente la modifica di decine di righe per adattare l’obiettivo del GRPO e sincronizzare l’insegnante con lo studente.

Guardando al futuro, RLSD offre alle aziende un modo efficace per massimizzare le risorse interne esistenti.

“I dati proprietari che le imprese conservano all’interno del loro perimetro (manuali di conformità, documentazione interna, ticket storici, frammenti di codice verificati) sono essenzialmente informazioni privilegiate gratuite”, ha concluso Yang. “RLSD consente alle aziende di inserire questo tipo di dati direttamente in un contesto privilegiato, che affina il segnale di apprendimento su modelli più piccoli senza bisogno di un insegnante esterno e senza inviare nulla all’esterno della rete”.