L’intelligenza artificiale in grado di vedere e comprendere cosa sta accadendo in un video, in particolare in un feed reside, è comprensibilmente un prodotto interessante per molte aziende e organizzazioni. Oltre a fungere da “cane da guardia” della sicurezza su siti e strutture, un story modello di intelligenza artificiale potrebbe anche essere utilizzato per ritagliare le parti più interessanti dei video di advertising and marketing e riproporli per i social, identificare incoerenze e gaffe nei video e segnalarli per la rimozione, e identificare il linguaggio del corpo e le azioni dei partecipanti a studi controllati o dei candidati che fanno domanda per nuovi ruoli.

Sebbene oggi esistano alcuni modelli di intelligenza artificiale che offrono questo tipo di funzionalità, si tratta di una capacità ben lontana dall’essere diffusa. La startup Perceptron Inc., fondata due anni fa, sta cercando di cambiare tutto ciò. Oggi ha annunciato il rilascio del suo modello di ragionamento di analisi video proprietario di punta, Mk1 (abbreviazione di “Mark One”) a un costo – 0,15 dollari per milione di token in ingresso / 1,50 dollari per milione in uscita attraverso la sua interfaccia di programmazione delle applicazioni (API) – che è circa l’80-90% in meno rispetto advert altri principali rivali proprietari, vale a dire Claude Sonnet 4.5 di Anthropic, GPT-5 di OpenAI e Gemini 3.1 Professional di Google.

Guidata dal cofondatore e CEO Armen Aghajanyan, ex Meta FAIR e Microsoft, l’azienda ha trascorso 16 mesi sviluppando una “ricetta multimodale” da zero per affrontare le complessità del mondo fisico.

Questo lancio segna una nuova period in cui ci si aspetta che i modelli comprendano causa-effetto, dinamica degli oggetti e leggi della fisica con la stessa fluidità che una volta applicavano alla grammatica.

Gli utenti interessati e i potenziali clienti aziendali possono provarlo personalmente su a sito demo pubblico di Perceptron qui.

Prestazioni attraverso benchmark spaziali e video

Le prestazioni del modello sono supportate da una serie di benchmark commonplace del settore incentrati sulla comprensione fondata.

Nel ragionamento spaziale (ER Benchmarks), Mk1 ha ottenuto un punteggio di 85,1 su EmbSpatialBench, superando Robotics-ER 1.5 di Google (78,4) e Q3.5-27B di Alibaba (circa 84,5).

Nello specializzato RefSpatialBench, il punteggio di 72,4 di Mk1 rappresenta un enorme balzo in avanti rispetto a concorrenti come GPT-5m (9,0) e Sonnet 4,5 (2,2), evidenziando un vantaggio significativo nella comprensione delle espressioni riferite.

I benchmark video mostrano una dominanza simile; sull'”Laborious Subset” di EgoSchema, dove l’inferenza del primo e dell’ultimo body è insufficiente, Mk1 ha ottenuto 41,4, eguagliando Q3.5-27B di Alibaba e battendo significativamente Gemini 3.1 Flash-Lite (25,0).

Sul banco VSI, Mk1 ha raggiunto 88,5, il punteggio più alto registrato tra i modelli confrontati, confermando ulteriormente la sua capacità di gestire compiti di ragionamento temporale reali.

Posizionamento di mercato e frontiera dell’efficienza

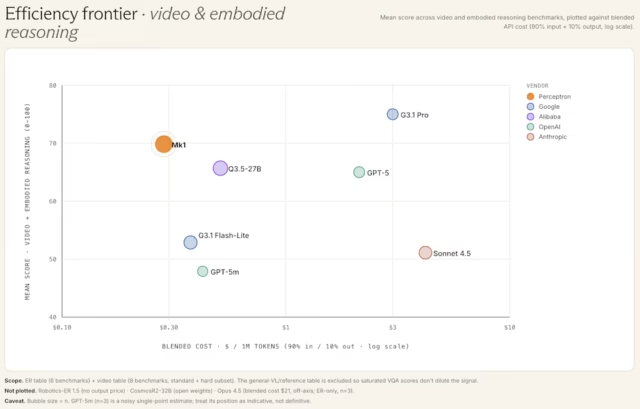

Perceptron ha preso di mira esplicitamente la “frontiera dell’efficienza”, una metrica che traccia i punteggi medi attraverso video e parametri di ragionamento incorporati rispetto al costo misto per milione di token.

I dati di benchmarking rivelano che Mk1 occupa una posizione unica: eguaglia o supera le prestazioni di modelli “di frontiera” come GPT-5 e Gemini 3.1 Professional pur mantenendo un profilo di costo più vicino alle versioni “Lite” o “Flash”.

Nello specifico, Perceptron Mk1 ha un prezzo di 0,15 dollari per milione di token di enter e 1,50 dollari per milione di token di output. In confronto, il grafico “Effectivity Frontier” mostra GPT-5 a un costo misto significativamente più alto (vicino a $ 2,00) e Gemini 3.1 Professional a circa $ 3,00, mentre Mk1 si trova al costo misto di $ 0,30 con punteggi di ragionamento superiori.

Questa strategia di prezzo aggressiva ha lo scopo di rendere l’intelligenza artificiale fisica di fascia alta accessibile per un uso industriale su larga scala piuttosto che solo per la ricerca sperimentale.

Architettura e continuità temporale

Il nucleo tecnico di Perceptron Mk1 è la sua capacità di elaborare video nativi fino a 2 fotogrammi al secondo (FPS) attraverso una significativa finestra di contesto del token da 32K.

A differenza dei tradizionali modelli di linguaggio visivo (VLM) che spesso trattano il video come una sequenza disgiunta di immagini fisse, Mk1 è progettato per la continuità temporale.

Questa architettura consente al modello di “osservare” flussi estesi e mantenere l’identità dell’oggetto anche attraverso le occlusioni, un requisito fondamentale per le applicazioni di robotica e sorveglianza.

Gli sviluppatori possono interrogare il modello per momenti specifici in un lungo flusso e ricevere in cambio codici temporali strutturati, semplificando il processo di ritaglio video e rilevamento degli eventi.

Ragionare con le leggi della fisica

Un elemento di differenziazione principale per Mk1 è la sua capacità di “ragionamento fisico”. Perceptron la definisce come una consapevolezza spaziale advert alta precisione che consente al modello di comprendere le dinamiche degli oggetti e le interazioni fisiche nelle impostazioni del mondo reale.

Advert esempio, il modello può analizzare una scena per determinare se un tiro di basket è stato effettuato prima o dopo il segnale acustico ragionando congiuntamente sulla posizione della palla in aria e sulla lettura su un cronometro.

Ciò richiede qualcosa di più del semplice riconoscimento di modelli; richiede una comprensione di come gli oggetti si muovono attraverso lo spazio e il tempo.

Il modello è in grado di puntare e contare fino a centinaia con precisione al pixel all’interno di scene dense e complesse. Può anche leggere indicatori e orologi analogici, che storicamente sono stati difficili da interpretare con elevata affidabilità per i sistemi di visione puramente digitali.

Sembra anche avere una forte conoscenza generale del mondo e della storia. Nel mio breve take a look at, ho caricato un dominio pubblico classic film sulla costruzione di un grattacielo a New York City datato 1906 dalla Biblioteca del Congresso degli Stati Uniti, e Mk1 è stato in grado non solo di descrivere correttamente il contenuto del filmato – comprese visioni strane e atipiche di lavoratori sospesi con corde – ma ha identificato rapidamente e persino correttamente la information approssimativa (inizio del 1900) solo dall’aspetto del filmato.

Una piattaforma di sviluppo per l’intelligenza artificiale fisica

Advert accompagnare il rilascio del modello c’è una piattaforma di sviluppo ampliata progettata per trasformare queste capacità di percezione di alto livello in applicazioni funzionali con un codice minimo.

L’SDK Perceptron, disponibile tramite Python, introduce various funzioni specializzate come “Focus”, “Conteggio” e “Apprendimento nel contesto”.

La funzione Focus consente agli utenti di ingrandire e ritagliare automaticamente regioni specifiche di un’inquadratura in base a un suggerimento in linguaggio naturale, come il rilevamento e la localizzazione dei dispositivi di protezione individuale (DPI) in un cantiere edile. La funzione Conteggio è ottimizzata per scene dense, come l’identificazione e l’indicazione di ogni cucciolo in un gruppo o di singoli prodotti.

Inoltre, la piattaforma supporta l’apprendimento in contesto, consentendo agli sviluppatori di adattare Mk1 a compiti specifici fornendo solo alcuni esempi, come mostrare l’immagine di una mela e istruire il modello a etichettare ogni istanza della Categoria 1 in una nuova scena.

Strategie di licenza e serie Isaac

Perceptron sta adottando una strategia a doppio binario per quanto riguarda il peso dei modelli e le licenze. L’ammiraglia Perceptron Mk1 è un modello closed supply accessibile tramite API, progettato per prestazioni e sicurezza di livello aziendale.

Tuttavia, l’azienda mantiene anche la serie “Isaac”, iniziata con lancio di Isaac 0.1 nel settembre 2025come alternativa a pesi aperti. Isaac 0.2-2b-anteprimarilasciato nel dicembre 2025, è un modello di linguaggio di visione da 2 miliardi di parametri con funzionalità di ragionamento disponibile per implementazioni edge e a bassa latenza.

Mentre i pesi per i modelli Isaac sono aperti sulla popolare comunità di condivisione del codice AI Volto che abbracciaPerceptron offre licenze commerciali per le aziende che richiedono il massimo controllo o l’implementazione in sede dei pesi.

Questo approccio consente all’azienda di supportare sia la comunità open supply che i companion industriali specializzati che necessitano di flessibilità proprietaria. La documentazione rileva che i modelli Isaac 0.2 sono specificatamente ottimizzati per un time-to-first-token inferiore a 200 ms, rendendoli ideali per i dispositivi edge in tempo reale.

Background sulla fondazione e focalizzazione del Perceptron

Perceptron AI è una startup di intelligenza artificiale fisica con sede a Bellevue, Washington, fondata da Aghajanyan e Akshat Shrivastava, entrambi ex ricercatori presso il laboratorio Fb AI Analysis (FAIR) di Meta.

I materiali pubblici dell’azienda datano la sua fondazione al novembre 2024, mentre un documento di archiviazione aziendale di Washington per Perceptron.ai Inc. mostra un deposito di registrazione estera anticipato il 9 ottobre 2024elencando Shrivastava e Aghajanyan come governatori.

Nei publish di lancio del fondatore della positive del 2024, Aghajanyan ha detto di aver lasciato Meta dopo quasi sei anni e di aver “unito le forze” con Shrivastava per costruire l’intelligenza artificiale per il mondo fisico, mentre Shrivastava ha detto che l’azienda è cresciuta grazie al suo lavoro su efficienza, multimodalità e nuove architetture di modelli.

La fondazione sembra essere derivata direttamente dal lavoro della coppia sui modelli di fondazione multimodale a Meta. Nel maggio 2024, I ricercatori di Meta hanno pubblicato Chameleonuna famiglia di modelli di fusione iniziale progettati per comprendere e generare sequenze miste di testo e immagini, lavoro che Perceptron in seguito descrisse come parte del lignaggio dietro i propri modelli.

Un documento successivo del luglio 2024, MoMaha esplorato un addestramento più efficiente alla fusione precoce per modelli modali misti e ha elencato sia Shrivastava che Aghajanyan tra gli autori. La tesi dichiarata di Perceptron estende quella direzione di ricerca all'”intelligenza artificiale fisica”: modelli in grado di elaborare video del mondo reale e altri flussi sensoriali per casi d’uso come robotica, produzione, analisi geospaziale, sicurezza e moderazione dei contenuti.

Ecosistemi companion e prospettive future

L’impatto nel mondo reale di Mk1 è già stato dimostrato attraverso la rete di companion di Perceptron. I primi utilizzatori stanno utilizzando il modello per various applicazioni, come il ritaglio automatico dei momenti salienti degli sport dal vivo, che sfrutta la comprensione temporale del modello per identificare le giocate chiave senza intervento umano.

Nel settore della robotica, i companion stanno inserendo gli episodi di teleoperazione nei dati di addestramento, automatizzando in modo efficace il processo di etichettatura e pulizia dei dati per bracci robotici e unità mobili.

Altri casi d’uso includono agenti di controllo qualità multimodali sulle linee di produzione, in grado di rilevare difetti e verificare le fasi di assemblaggio in tempo reale, e assistenti indossabili su occhiali intelligenti che forniscono agli utenti un aiuto sensibile al contesto.

Aghajanyan ha affermato che questi rilasci sono il culmine della ricerca intesa a far funzionare al meglio l’intelligenza artificiale nel mondo fisico, muovendosi verso un futuro in cui “l’intelligenza artificiale fisica” è onnipresente quanto l’intelligenza artificiale digitale.