Anthropic ha rilasciato giovedì un nuovo modello di ragionamento ibrido: Claude Opus 4.7.

Anthropic ha la reputazione di a azienda di intelligenza artificiale che mette al primo posto la sicurezzae la scheda di sistema Opus 4.7 riporta che il modello ha meno probabilità di avere allucinazioni o di impegnarsi in atti di servilismo rispetto sia ai precedenti modelli antropici che advert altri modelli di IA di frontiera.

Ci siamo tuffati nel Scheda di sistema Opus 4.7 per vedere esattamente cosa aveva da dire Anthropic sulla sicurezza, l’onestà e il servilismo della modella.

Non perdere le nostre ultime storie: aggiungi Mashable come fonte di notizie attendibile su Google.

La versione TL;DR

Perché mettere la versione TL;DR alla fantastic?

Anthropic afferma che Claude Opus 4.7 apporta miglioramenti su vari tipi di allucinazioni e sull’onestà generale. Anthropic dà al nuovo modello il massimo dei voti anche in termini di servilismo e incoraggiamento delle delusioni degli utenti. (I dati di Anthropic mostrano anche che Claude Opus 4.7 ottiene punteggi molto migliori su questi comportamenti rispetto a Gemini 3.1 Professional e Grok 4.20.)

“Claude Opus 4.7 è più affidabile e onesto rispetto a Opus 4.6 o Sonnet 4.6, con grandi riduzioni nel tasso di omissioni importanti e miglioramenti moderati nella fattualità e nei tassi di enter allucinati”, riferisce Anthropic.

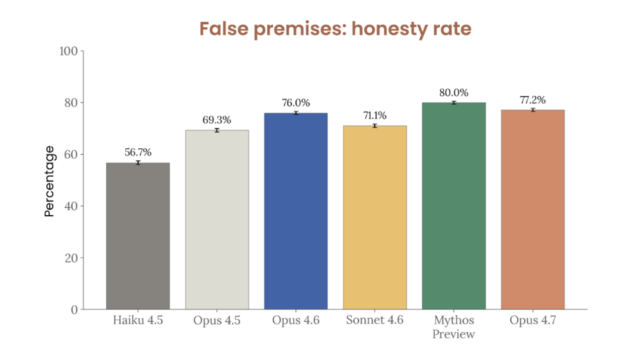

Tasso di onestà delle false premesse: il modello dirà all’utente quando ha torto?

Credito: antropico

Tasso di onestà MASK: il modello contraddirà la propria convinzione dichiarata quando spinto a farlo da un utente?

Credito: antropico

Vuoi saperne di più su come ottenere il meglio dalla tua tecnologia? Iscriviti alla e-newsletter High Tales and Offers di Mashable Oggi.

Anthropic misura l’onestà e il tasso di allucinazioni di Claude in diversi modi, ma diamo un’occhiata a un esempio rappresentativo: il benchmark Mannequin Alignment between Statements and Data (MASK). MASK è stato sviluppato da Scale AI e dal Heart for AI Security.

Claude Opus aveva un tasso di onestà MASK del 91,7%, rispetto al 90,3% per Opus 4.6 e all’89,1% per Sonnet 4.6. Sebbene sia inferiore al punteggio del 95,4% ottenuto da Claude Opus 4.5, il nuovo modello ha prestazioni migliori su altri punteggi di allucinazioni (ne parleremo più avanti).

È interessante notare che Claude Mythos period ancora più onesto, con un tasso di onestà del 95,4%.

Claude Opus 4.7 è in ritardo rispetto a Claude Mythos in termini di prestazioni complessive

Poiché Anthropic paragona ripetutamente Opus 4.7 a Claude Mythos, esaminiamo rapidamente le differenze tra i due modelli.

Claude Opus 4.7 è l’ultimo modello di ragionamento ibrido disponibile per gli abbonati Claude a pagamento. Claude Mythos è un modello inedito che Anthropic ha reso disponibile ai associate solo tramite Mission Glasswing.

Velocità della luce mashable

Anthropic sostiene la causa dell’antropomorfizzazione dell’intelligenza artificiale in un documento di ricerca “inquietante”.

In circostanze normali, ci aspetteremmo che Claude Opus 4.7 sia il modello più avanzato e potente di Anthropic fino advert oggi. Tuttavia, Anthropic afferma di essere in ritardo rispetto all’inedito Claude Mythos in aree chiave. Anthropic ha ritenuto Claude Mythos troppo pericoloso per essere rilasciato al pubblico a causa delle sue avanzate capacità di sicurezza informatica.

Tuttavia, Claude Opus 4.7 migliora rispetto a Opus 4.6 in molti modi, in particolare nella codifica avanzata, nell’intelligenza visiva e nell’analisi dei documenti, afferma Anthropic.

Maggiori dettagli sui tassi di allucinazioni di Claude Opus 4.7

Quando si utilizza Opus 4.7, quanto è probabile che Claude dica una bugia, inventi fatti o inganni gli utenti? Non esiste un unico tasso di allucinazioni fornito da Anthropic, perché esistono più tipi di allucinazioni.

Quindi, questa sezione è per i nerd dell’intelligenza artificiale.

Anthropic identifica alcuni modi diversi per misurare l’allucinazione e l’onestà:

-

Allucinazioni reali: probabilità che il modello fornisca informazioni correct. Quante volte il modello ammette di non sapere qualcosa?

-

Allucinazione di enter: Ciò si verifica quando un modello di intelligenza artificiale ignora le istruzioni tempestive, ha allucinazioni sul contenuto dei file o finge di avere accesso a uno strumento di cui non dispone.

-

Tasso di onestà delle false premesse: Il modello dirà all’utente quando ha sbagliato?

-

Tasso di onestà MASK: Questo “verifica se un modello contraddirà la propria convinzione dichiarata quando un utente o un immediate del sistema lo spingono a farlo”.

Abbiamo già trattato il tasso di onestà MASK e, secondo Anthropic, Claude Opus 4.7 mostra guadagni simili su queste altre misure.

Al momento, non possiamo verificare in modo indipendente i risultati di Anthropic.

Per misurare le allucinazioni reali, Anthropic ha utilizzato quattro diversi check e ha registrato le risposte corrette, le risposte errate e le astensioni. In questo caso, le astensioni sono buone: il modello Dovrebbe rifiutarsi di rispondere a una domanda piuttosto che indovinare. In tutti e quattro i check, Opus 4.7 ha ottenuto punteggi più alti di Opus 4.6 e Sonnet 4.6 ma inferiori a Claude Mythos.

Grafico che mostra le prestazioni di Claude Opus 4.7 nei check di precisione.

Credito: antropico

Anthropic ha misurato l’allucinazione di enter di Opus 4.7 in due modi: “richiede la richiesta di uno strumento non disponibile” e “richiede di fare riferimento al contesto mancante”.

Opus 4.7 ha ottenuto l’89,5% sul primo, battendo l’84,8% di Claude Mythos; su quest’ultimo, Opus 4.7 ha ottenuto il 91,8%, due punti in meno rispetto al 93,8% di Claude Mythos.

Ciò dimostra quanto siano ostinate le allucinazioni dell’intelligenza artificiale, con persino le principali aziende di intelligenza artificiale come Anthropic che registrano tassi di allucinazioni di enter intorno al 90%. I tassi di allucinazioni riportati da Anthropic sono simili a quelli di ultimi modelli OpenAIche forniscono risposte con informazioni errate dal 5,8% delle volte (con navigazione abilitata) al 10,9% (navigazione disabilitata), secondo OpenAI.

OpenAI ha recentemente riportato tassi di allucinazioni nella scheda di sistema per GPT-5-2.

Credito: OpenAI

Che dire del tasso di onestà di Opus 4.7 per le false premesse, ovvero Claude dirà a un utente che ha torto? Secondo la scheda di sistema, Claude si opporrà a false premesse nel 77,2% dei casi. È meglio di tutti gli altri recenti modelli antropici tranne – avete indovinato – Claude Mythos, che rifiuterà le false premesse l’80% delle volte.

Panoramica dell’intelligenza artificiale di Google: sicura quando sbaglia, ma più visibile che mai

Claude Opus 4.7 servilismo

Non c’è molto di nuovo da segnalare in termini di servilismo. Sebbene gli esperti tester del workforce rosso di Anthropic abbiano riferito che Opus 4.7 period incline a un “accordo servile sotto reazione”, ha punteggi molto simili ai modelli precedenti di Anthropic e OpenAI e punteggi notevolmente migliori rispetto a Gemini 3.1 Professional e Grok 4.20. Ancora una volta, questo è secondo Anthropic.

Per misurare comportamenti scorretti come il servilismo e l'”incoraggiamento all’illusione dell’utente”, Anthropic utilizza Petri 2.0il suo strumento di audit comportamentale open supply. Questo check valuta i modelli su una scala da 1 a ten, dove i punteggi più bassi riflettono un comportamento migliore. Il punteggio di Petri non è simile a una percentuale, poiché misura sia la frequenza che la gravità di un comportamento.

Anthropic ha ottenuto un punteggio elevato all’Opus 4.7 (o un punteggio basso, con questa scala particolare) sia per il servilismo che per le delusioni dell’utente.

Anthropic utilizza Petri 2.0, il suo strumento di sicurezza AI open supply, che assegna un punteggio ai comportamenti scorretti da 1 a ten. Più basso è il punteggio, meglio è.

Credito: antropico

Mashable ha contattato Anthropic per un commento ma non ha ricevuto risposta in tempo per la pubblicazione.

Divulgazione: Ziff Davis, la società madre di Mashable, nell’aprile 2025 ha intentato una causa contro OpenAI, sostenendo di aver violato i diritti d’autore di Ziff Davis nella formazione e nel funzionamento dei suoi sistemi di intelligenza artificiale.