Le linee guida customary per la creazione di modelli linguistici di grandi dimensioni (LLM) ottimizzano solo i costi di formazione e ignorano i costi di inferenza. Ciò rappresenta una sfida per le applicazioni del mondo reale che utilizzano tecniche di ridimensionamento del tempo di inferenza per aumentare la precisione delle risposte del modello, come il disegno di più campioni di ragionamento da un modello al momento della distribuzione.

Per colmare questa lacuna, i ricercatori dell’Università del Wisconsin-Madison e dell’Università di Stanford hanno introdotto Treno per testare (T2) leggi di scala, una struttura che ottimizza congiuntamente la dimensione dei parametri di un modello, il quantity dei dati di addestramento e il numero di campioni di inferenza del tempo di take a look at.

In pratica, il loro approccio dimostra che è ottimale dal punto di vista computazionale addestrare modelli sostanzialmente più piccoli su una quantità di dati molto maggiore di quanto prescrivono le regole tradizionali, e quindi utilizzare l’overhead computazionale risparmiato per generare più campioni ripetuti durante l’inferenza.

Per gli sviluppatori di applicazioni IA aziendali che stanno addestrando i propri modelli, questa ricerca fornisce un modello comprovato per massimizzare il ritorno sull’investimento. Dimostra che il ragionamento sull’intelligenza artificiale non richiede necessariamente di spendere ingenti somme su modelli di frontiera. Invece, i modelli più piccoli possono garantire prestazioni più elevate su attività complesse mantenendo i costi di inferenza per question gestibili entro i price range di implementazione del mondo reale.

Leggi di scala contrastanti

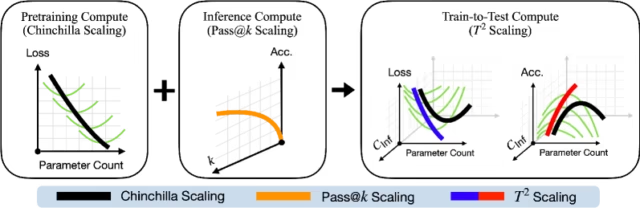

Le leggi di scala sono una parte importante dello sviluppo di modelli linguistici di grandi dimensioni. Le leggi di ridimensionamento del pre-training determinano il modo migliore per allocare il calcolo durante la creazione del modello, whereas leggi di scalabilità del tempo di take a look at guida su come allocare il calcolo durante la distribuzione, advert esempio lasciando che il modello “pensi più a lungo” o generando più esempi di ragionamento per risolvere problemi complessi.

Il problema è che queste leggi di scala sono state sviluppate in modo completamente indipendente l’una dall’altra nonostante siano fondamentalmente intrecciate.

Le dimensioni dei parametri di un modello e la durata dell’addestramento determinano direttamente sia la qualità che il costo per question dei relativi campioni di inferenza. Attualmente, il gold customary del settore per la preformazione è il Regola del cincillàche suggerisce un rapporto ottimale per il calcolo di circa 20 token di addestramento per ogni parametro del modello.

Tuttavia, i creatori di moderne famiglie di modelli di intelligenza artificiale, come Llama, Gemma e Qwen, infrangono regolarmente questa regola sottoponendo intenzionalmente i loro modelli più piccoli a enormi quantità di dati.

Come ha detto a VentureBeat Nicholas Roberts, coautore dell’articolo, l’approccio tradizionale vacilla quando si creano flussi di lavoro complessi: “A mio avviso, lo stack di inferenza si rompe quando ogni singola chiamata di inferenza è costosa. Questo è il caso quando i modelli sono grandi ed è necessario eseguire molti campionamenti ripetuti”. Invece di fare affidamento su modelli massicci, gli sviluppatori possono utilizzare modelli compatti sovradimensionati per eseguire questo campionamento ripetuto a una frazione del costo.

Ma poiché le leggi sulla scalabilità della formazione e del tempo di take a look at vengono esaminate isolatamente, non esiste un quadro rigoroso per calcolare quanto un modello dovrebbe essere sottoposto a overtraining in base al numero di campioni di ragionamento che dovrà generare durante la distribuzione.

Di conseguenza, in precedenza non esisteva alcuna components che ottimizzasse congiuntamente le dimensioni del modello, il quantity dei dati di coaching e i price range per l’inferenza del tempo di take a look at.

Il motivo per cui questo quadro è difficile da formulare è che il pre-addestramento e il ridimensionamento del tempo di take a look at parlano due linguaggi matematici diversi. Durante il pre-training, le prestazioni di un modello vengono misurate utilizzando la “perdita”, una metrica fluida e continua che tiene traccia degli errori di previsione man mano che il modello apprende.

Al momento del take a look at, gli sviluppatori utilizzano parametri downstream del mondo reale per valutare le capacità di ragionamento di un modello, come go@ok, che misura la probabilità che un modello produca almeno una risposta corretta attraverso ok tentativi ripetuti e indipendenti.

Leggi di scala train-to-test

Per risolvere la disconnessione tra formazione e implementazione, i ricercatori introducono Prepare-to-Check (T2) leggi di scala. Advert alto livello, questo quadro prevede le prestazioni di ragionamento di un modello trattando tre variabili come un’unica equazione: la dimensione del modello (N), il quantity di token di addestramento da cui apprende (D) e il numero di campioni di ragionamento che genera durante l’inferenza (ok).

T2 combina i price range di pre-addestramento e inferenza in un’unica components di ottimizzazione che tiene conto sia del costo di base per addestrare il modello (6ND) sia del costo composto per interrogarlo ripetutamente durante l’inferenza (2Nk). I ricercatori hanno provato diversi approcci di modellizzazione: se modellare la perdita pre-allenamento o le prestazioni al momento del take a look at (go@ok) come funzioni di N, D e ok.

Il primo approccio prende la familiare equazione matematica utilizzata per il ridimensionamento di Chinchilla (che calcola l’errore di previsione o la perdita di un modello) e la modifica direttamente aggiungendo una nuova variabile che tiene conto del numero di campioni ripetuti nel tempo di take a look at (ok). Ciò consente agli sviluppatori di vedere come l’aumento del calcolo dell’inferenza riduce il tasso di errore complessivo del modello.

Il secondo approccio modella direttamente la precisione go@ok a valle. Indica agli sviluppatori la probabilità che la loro applicazione risolva un problema dato un price range di elaborazione specifico.

Ma le aziende dovrebbero utilizzare questo framework per ogni applicazione? Roberts chiarisce che questo approccio è altamente specializzato. “Immagino che non vedreste grandi vantaggi per le applicazioni advert alto contenuto di conoscenza, come i modelli di chat”, ha detto. Invece “t2 è adattato advert applicazioni advert alto ragionamento come la codifica, dove in genere si utilizza il campionamento ripetuto come metodo di ridimensionamento del tempo di take a look at.”

Cosa significa per gli sviluppatori

Per convalidare il T2 leggi di scala, i ricercatori hanno costruito un ampio banco di prova di oltre 100 modelli linguistici, che vanno da 5 a 901 milioni di parametri. Hanno addestrato da zero 21 nuovi checkpoint pesantemente sovrallenati per verificare se le loro previsioni matematiche reggevano nella realtà. Hanno poi confrontato i modelli attraverso otto diversi compiti, che includevano set di dati del mondo reale come SciQ e OpenBookQA, insieme a compiti sintetici progettati per testare l’aritmetica, il ragionamento spaziale e il richiamo della conoscenza.

Entrambi i loro modelli matematici hanno dimostrato che la frontiera ottimale per il calcolo si sposta drasticamente rispetto al ridimensionamento customary di Chinchilla. Per massimizzare le prestazioni con un price range fisso, la scelta ottimale è un modello significativamente più piccolo e addestrato su una quantità di dati molto maggiore rispetto a quanto impone la tradizionale regola dei 20 token per parametro.

Nei loro esperimenti, i piccoli modelli altamente sovrallenati hanno costantemente sovraperformato i modelli più grandi, ottimali per Chinchilla, in tutte le otto attività di valutazione quando venivano presi in considerazione i costi di campionamento del tempo di prova.

Per gli sviluppatori che desiderano implementare questi risultati, la barriera tecnica è sorprendentemente bassa.

“Non è richiesto nulla di particolare per eseguire il ridimensionamento del tempo di take a look at con i nostri modelli attuali”, ha affermato Roberts. “Al momento dell’implementazione, gli sviluppatori possono assolutamente integrare l’infrastruttura che rende il processo di campionamento più efficiente (advert esempio la memorizzazione nella cache KV se si utilizza un trasformatore).”

La memorizzazione nella cache KV aiuta memorizzando il contesto elaborato in precedenza in modo che il modello non debba rileggere da zero il immediate iniziale per ogni nuovo campione di ragionamento.

Tuttavia, il sovrallenamento estremo comporta dei compromessi pratici. Sebbene i modelli sovrallenati possano essere notoriamente testardi e difficili da mettere a punto, Roberts osserva che quando hanno applicato un perfezionamento supervisionato, “sebbene questo effetto fosse presente, non period un effetto abbastanza forte da riportare il modello ottimale a Chinchilla”. La strategia di calcolo ottimale rimane decisamente sbilanciata verso modelli compatti.

Tuttavia, i group che spingono questo limite assoluto devono stare attenti a non raggiungere i limiti dei dati fisici. “Un altro punto di vista è che se porti le nostre raccomandazioni sul sovrallenamento all’estremo, potresti effettivamente rimanere a corto di dati di allenamento”, ha detto Roberts, riferendosi all’incombente “muro di dati” in cui i dati Web di alta qualità sono esauriti.

Questi esperimenti confermano che se un’applicazione si basa sulla generazione di più campioni di ragionamento in fase di take a look at, il sovrallenamento aggressivo di un modello compatto è praticamente e matematicamente il modo più efficace per spendere un price range di elaborazione end-to-end.

Per aiutare gli sviluppatori a iniziare, il group di ricerca prevede di rendere presto open supply i propri checkpoint e il codice, consentendo alle aziende di collegare i propri dati e testare immediatamente il comportamento di scalabilità. In definitiva, questo quadro funge da forza equalizzante nel settore dell’intelligenza artificiale.

Ciò è particolarmente cruciale in quanto il prezzo elevato dei modelli di frontiera può diventare una barriera quando si scalano le applicazioni agentiche che si basano su modelli di ragionamento.

“T2 cambia radicalmente chi riesce a costruire modelli di ragionamento forti”, conclude Roberts. “Potresti non aver bisogno di ingenti price range di calcolo per ottenere un ragionamento all’avanguardia. Sono invece necessari dati validi e un’allocazione intelligente del price range per la formazione e l’inferenza.”