I grandi modelli linguistici stanno incontrando limiti in ambiti che richiedono una comprensione del mondo fisico, dalla robotica alla guida autonoma fino alla produzione. Questo vincolo sta spingendo gli investitori verso modelli mondiali, con AMI Labs che ha raccolto un spherical iniziale di 1,03 miliardi di dollari poco dopo World Labs si è assicurato 1 miliardo di dollari.

I modelli linguistici di grandi dimensioni (LLM) eccellono nell’elaborazione della conoscenza astratta attraverso la previsione del token successivo, ma fondamentalmente mancano di basi nella causalità fisica. Non possono prevedere in modo affidabile le conseguenze fisiche delle azioni del mondo reale.

I ricercatori e i chief di pensiero sull’intelligenza artificiale sono sempre più espliciti riguardo a queste limitazioni mentre l’industria cerca di spingere l’intelligenza artificiale fuori dai browser internet e negli spazi fisici. In un’intervista con il podcaster Dwarkesh PatelRichard Sutton, vincitore del Premio Turing, ha avvertito che gli LLM imitano semplicemente ciò che le persone dicono invece di modellare il mondo, il che limita la loro capacità di imparare dall’esperienza e di adattarsi ai cambiamenti nel mondo.

Questo è il motivo per cui i modelli basati su LLM, compresi i modelli del linguaggio visivo (VLM), possono mostrare comportamenti fragili e rompersi con modifiche molto piccole ai loro enter.

CEO di Google DeepMind Demis Hassabis ha fatto eco a questo sentimento in un’altra intervista, sottolineando che i modelli di intelligenza artificiale di oggi soffrono di “intelligenza frastagliata”. Possono risolvere complesse olimpiadi di matematica ma falliscono nella fisica di base perché mancano di capacità critiche riguardo alle dinamiche del mondo reale.

Per risolvere questo problema, i ricercatori stanno spostando l’attenzione sulla costruzione di modelli mondiali che fungano da simulatori interni, consentendo ai sistemi di intelligenza artificiale di testare in modo sicuro le ipotesi prima di intraprendere azioni fisiche. Tuttavia, “modelli mondiali” è un termine generico che comprende diversi approcci architettonici distinti.

Ciò ha prodotto tre approcci architettonici distinti, ciascuno con diversi compromessi.

JEPA: costruito per il tempo reale

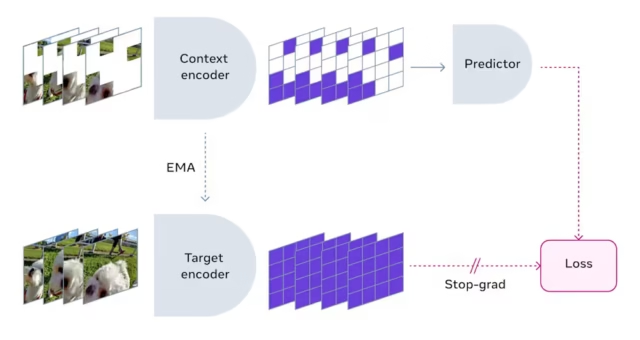

Il primo approccio principale si concentra sull’apprendimento delle rappresentazioni latenti invece di cercare di prevedere le dinamiche del mondo a livello di pixel. Approvato da AMI Labs, questo metodo è fortemente basato sulla Joint Embedding Predictive Structure (JEPA).

I modelli JEPA cercano di imitare il modo in cui gli esseri umani comprendono il mondo. Quando osserviamo il mondo, non memorizziamo ogni singolo pixel o dettaglio irrilevante di una scena. Advert esempio, se guardi un’auto che percorre una strada, ne segui la traiettoria e la velocità; non calcoli l’esatto riflesso della luce su ogni singola foglia degli alberi sullo sfondo.

I modelli JEPA riproducono questa scorciatoia cognitiva umana. Invece di forzare la rete neurale a prevedere esattamente come sarà il fotogramma successivo di un video, il modello apprende un insieme più piccolo di caratteristiche astratte o “latenti”. Scarta i dettagli irrilevanti e si concentra interamente sulle regole fondamentali su come interagiscono gli elementi nella scena. Ciò rende il modello robusto rispetto al rumore di fondo e ai piccoli cambiamenti che interrompono altri modelli.

Questa architettura è altamente efficiente in termini di calcolo e memoria. Ignorando i dettagli irrilevanti, richiede molti meno esempi di coaching e viene eseguito con una latenza significativamente inferiore. Queste caratteristiche lo rendono adatto per applicazioni in cui l’efficienza e l’inferenza in tempo reale non sono negoziabili, come la robotica, le automobili a guida autonoma e i flussi di lavoro aziendali advert alto rischio.

Advert esempio, AMI sta collaborando con l’azienda sanitaria Nabla per utilizzare questa architettura per simulare la complessità operativa e ridurre il carico cognitivo in contesti sanitari frenetici.

Lo ha spiegato Yann LeCun, pioniere dell’architettura JEPA e co-fondatore di AMI modelli mondiali basati sul JEPA sono progettati per essere “controllabili nel senso che puoi dare loro degli obiettivi e, per costruzione, l’unica cosa che possono fare è raggiungere quegli obiettivi” in un’intervista con Newsweek.

Simboli gaussiani: costruiti per lo spazio

Un secondo approccio si basa su modelli generativi per costruire da zero ambienti spaziali completi. Adottato da aziende come Laboratori mondialiquesto metodo prende un immediate iniziale (potrebbe essere un’immagine o una descrizione testuale) e utilizza un modello generativo per creare uno splat gaussiano 3D. Uno splat gaussiano è una tecnica per rappresentare scene 3D utilizzando milioni di minuscole particelle matematiche che definiscono la geometria e l’illuminazione. A differenza della generazione di video piatti, queste rappresentazioni 3D possono essere importate direttamente nei motori fisici e 3D customary, come Unreal Engine, dove gli utenti e altri agenti IA possono navigare liberamente e interagire con essi da qualsiasi angolazione.

Il vantaggio principale in questo caso è una drastica riduzione del tempo e dei costi di generazione una tantum necessari per creare ambienti 3D interattivi complessi. Affronta esattamente il problema delineato dal fondatore di World Labs Fei-Fei Li, il quale ha osservato che i LLM in definitiva sono come “parolieri nell’oscurità“, che possiede un linguaggio fiorito ma manca di intelligenza spaziale ed esperienza fisica. Il modello Marble di World Labs fornisce all’IA quella consapevolezza spaziale mancante.

Sebbene questo approccio non sia progettato per l’esecuzione in frazioni di secondo e in tempo reale, ha un enorme potenziale per l’elaborazione spaziale, l’intrattenimento interattivo, la progettazione industriale e la creazione di ambienti di formazione statici per la robotica. Il valore aziendale è evidente in Autodesk forte sostegno di World Labs per integrare questi modelli nelle loro applicazioni di progettazione industriale.

Generazione end-to-end: costruita su larga scala

Il terzo approccio utilizza un modello generativo end-to-end per elaborare i suggerimenti e le azioni dell’utente, generando continuamente la scena, le dinamiche fisiche e le reazioni al volo. Invece di esportare un file 3D statico su un motore fisico esterno, il modello stesso funge da motore. Ingerisce un immediate iniziale insieme a un flusso continuo di azioni dell’utente e genera i successivi fotogrammi dell’ambiente in tempo reale, calcolando in modo nativo la fisica, l’illuminazione e le reazioni degli oggetti.

Quella di DeepMind Genio 3 e quello di Nvidia Cosmo rientrano in questa categoria. Questi modelli forniscono un’interfaccia estremamente semplice per generare infinite esperienze interattive e enormi volumi di dati sintetici. DeepMind lo ha dimostrato in modo nativo con Genie 3mostrando come il modello mantenga una rigorosa permanenza degli oggetti e una fisica coerente a 24 fotogrammi al secondo senza fare affidamento su un modulo di memoria separato.

Questo approccio si traduce direttamente in fabbriche di dati sintetici advert alto rendimento. Nvidia Cosmos utilizza questa architettura per ridimensionare i dati sintetici e il ragionamento fisico dell’intelligenza artificiale, consentendo agli sviluppatori di veicoli autonomi e robotica di sintetizzare condizioni limite uncommon e pericolose senza il costo o il rischio di check fisici. Waymo (una filiale di Alphabet) ha costruito il suo modello mondiale sopra Genie 3, adattandolo per addestrare le sue auto a guida autonoma.

Lo svantaggio di questo metodo generativo end-to-end è l’elevato costo di calcolo richiesto per eseguire il rendering continuo e simultaneo di fisica e pixel. Tuttavia, l’investimento è necessario per realizzare la visione delineata da Hassabis, il quale sostiene che è necessaria una profonda comprensione interna della causalità fisica perché l’attuale intelligenza artificiale non dispone delle capacità critiche per operare in sicurezza nel mondo reale.

Cosa verrà dopo: architetture ibride

Gli LLM continueranno a fungere da interfaccia di ragionamento e comunicazione, ma i modelli mondiali si stanno posizionando come infrastruttura fondamentale per le pipeline di dati fisici e spaziali. Man mano che i modelli sottostanti maturano, stiamo assistendo all’emergere di architetture ibride che attingono ai punti di forza di ciascun approccio.

Advert esempio, è stata recentemente sviluppata la startup di sicurezza informatica DeepTempo LogLMun modello che integra elementi di LLM e JEPA per rilevare anomalie e minacce informatiche dai registri di sicurezza e di rete.