I sistemi di intelligenza artificiale sono stati a lungo trattati come scatole nere sigillate, soprattutto in settori come il riconoscimento facciale e la guida autonoma. Nuova ricerca suggerisce che la protezione non è così solida come si pensava.

Un group guidato da KAIST mostra che i sistemi di intelligenza artificiale possono essere decodificati da remoto utilizzando le emissioni che fuoriescono durante il normale funzionamento, senza intrusioni dirette. Invece, l’approccio ascolta.

Utilizzando una piccola antenna, i ricercatori hanno catturato deboli tracce elettromagnetiche dalle GPU e hanno ricostruito il modo in cui period stato progettato il sistema. Sembra un trucco da rapina, ma i risultati reggono e le implicazioni sulla sicurezza sono fast.

Come funziona il canale laterale

Il sistema, chiamato ModelSpy, raccoglie l’output elettromagnetico prodotto mentre le GPU gestiscono i carichi di lavoro dell’intelligenza artificiale. Queste tracce sono sottili, ma seguono schemi legati al modo in cui è organizzata l’architettura.

Analizzando questi modelli, il group ha dedotto i dettagli chiave, comprese le configurazioni dei livelli e le scelte dei parametri. I check hanno dimostrato che le strutture centrali possono essere identificate con una precisione fino al 97,6%.

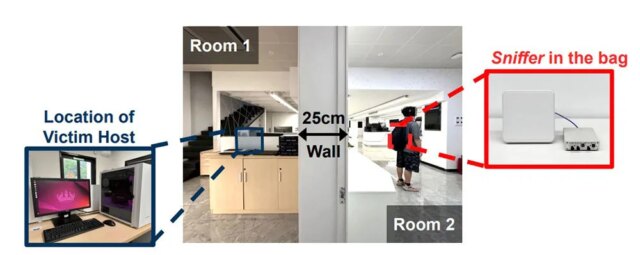

L’impostazione è ciò che rende questo inquietante. L’antenna può essere inserita in una borsa e non necessita di accesso fisico. Ha funzionato fino a sei metri di distanza, anche attraverso i muri, su più tipi di GPU. Il calcolo stesso diventa un canale laterale, esponendo il design del sistema senza una violazione tradizionale.

Perché questo cambia la sicurezza dell’IA

Ciò spinge la sicurezza dell’intelligenza artificiale in un territorio meno familiare. La maggior parte delle difese si concentra sugli exploit software program o sull’accesso alla rete. ModelSpy prende invece di mira i sottoprodotti fisici del calcolo.

Anche i sistemi isolati potrebbero divulgare informazioni sensibili se le emissioni {hardware} non vengono controllate. Per le aziende, story architettura è spesso una proprietà intellettuale fondamentale, il che la trasforma in un rischio aziendale diretto.

Il lavoro inquadra tutto questo come una sfida cyber-fisica, in cui la difesa dell’IA ora coinvolge sia la salvaguardia digitale che l’ambiente circostante, il che alza il livello di cosa significhi effettivamente protezione.

Come sono le difese adesso

Il group ha anche delineato modi per ridurre il rischio, tra cui l’aggiunta di rumore elettromagnetico e la regolazione del modo in cui vengono eseguiti i calcoli in modo che i modelli diventino più difficili da interpretare.

Queste correzioni suggeriscono un cambiamento più ampio. Proteggere l’intelligenza artificiale potrebbe richiedere aggiustamenti a livello {hardware}, non solo aggiornamenti software program, il che complica l’implementazione per le industrie già vincolate ai sistemi esistenti.

La ricerca ha ottenuto il riconoscimento in un’importante conferenza sulla sicurezza, segnalando quanto seriamente venga presa questa minaccia. La prossima esposizione potrebbe non comportare affatto l’irruzione, ma semplicemente l’osservazione di ciò che i sistemi rivelano involontariamente.