Quattro keynote separate dell’RSAC 2026 sono arrivate alla stessa conclusione senza coordinarsi. Vasu Jakkal di Microsoft ha detto ai partecipanti che la fiducia zero deve estendersi all’intelligenza artificiale. Jeetu Patel di Cisco ha chiesto il passaggio dal controllo degli accessi al controllo delle azioni, affermando in un’intervista esclusiva con VentureBeat che gli agenti si comportano “più come adolescenti, estremamente intelligenti, ma senza paura delle conseguenze”. George Kurtz di CrowdStrike ha identificato la governance dell’intelligenza artificiale come la più grande lacuna nella tecnologia aziendale. John Morgan di Splunk ha chiesto un modello di fiducia e governance basato sugli agenti. Quattro aziende. Quattro fasi. Un problema.

Matt Caulfield, vicepresidente del prodotto per Identification e Duo presso Cisco, lo ha detto senza mezzi termini in un’intervista esclusiva a VentureBeat presso RSAC. “Sebbene il concetto di Zero Belief sia valido, dobbiamo fare un ulteriore passo avanti”, ha affermato Caulfield. “Non si tratta solo di autenticarsi una volta e poi lasciare che l’agente si scateni. Si tratta di verificare e analizzare continuamente ogni singola azione che l’agente sta tentando di intraprendere, perché in qualsiasi momento quell’agente può diventare un canaglia.”

Secondo il 79% delle organizzazioni utilizza già agenti AI Sondaggio sugli agenti AI 2025 di PwC. Secondo il rapporto, solo il 14,4% ha dichiarato di avere la piena approvazione della sicurezza per l’intera flotta di agenti Rapporto Gravitee sullo stato della sicurezza degli agenti AI 2026 di 919 organizzazioni nel febbraio 2026. A Indagine CSA presentati all’RSAC hanno rilevato che solo il 26% ha politiche di governance dell’IA. Agentic Trust Framework di CSA descrive il divario risultante tra la velocità di implementazione e la disponibilità della sicurezza come un’emergenza di governance.

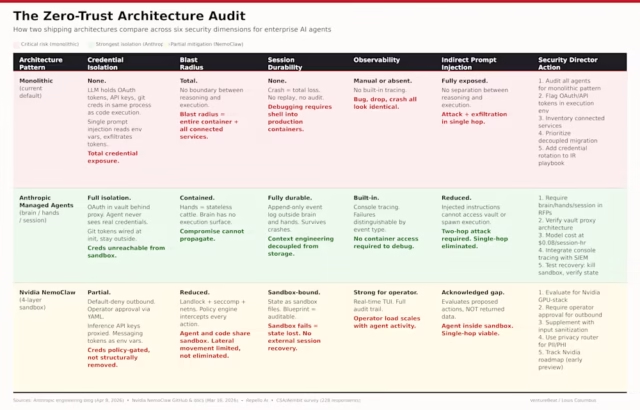

I chief della sicurezza informatica e i dirigenti del settore dell’RSAC hanno concordato sul problema. Quindi due aziende hanno fornito architetture che rispondono alla domanda in modo diverso. Il divario tra i loro progetti rivela dove si trova il rischio reale.

Il problema dell’agente monolitico che i crew di sicurezza stanno ereditando

Il modello di agente aziendale predefinito è un contenitore monolitico. Il modello ragiona, chiama strumenti, esegue il codice generato e conserva le credenziali in un unico processo. Ogni componente si fida di ogni altro componente. I token OAuth, le chiavi API e le credenziali git si trovano nello stesso ambiente in cui l’agente esegue il codice scritto pochi secondi fa.

Una pronta iniezione dà tutto all’aggressore. I token sono esfiltrabili. È possibile generare sessioni. Il raggio dell’esplosione non è l’agente. È l’intero contenitore e ogni servizio connesso.

IL Indagine CSA e Aembit di 228 professionisti IT e della sicurezza quantifica quanto questo sia ancora comune: il 43% utilizza account di servizio condiviso per gli agenti, il 52% si affida alle identità del carico di lavoro anziché alle credenziali specifiche dell’agente e il 68% non riesce a distinguere l’attività dell’agente dall’attività umana nei propri registri. Nessuna singola funzione rivendicava la proprietà dell’accesso dell’agente AI. La sicurezza ha detto che period responsabilità dello sviluppatore. Gli sviluppatori hanno affermato che period una responsabilità di sicurezza. Nessuno lo possedeva.

Il CTO di CrowdStrike Elia Zaitsev, in un’intervista esclusiva a VentureBeat, ha affermato che lo schema dovrebbe sembrare familiare. “Molto dell’aspetto degli agenti di sicurezza sarebbe molto simile a quello che sembra proteggere gli utenti altamente privilegiati. Hanno identità, hanno accesso ai sistemi sottostanti, ragionano, agiscono”, ha detto Zaitsev. “Raramente ci sarà un’unica soluzione che sia la soluzione miracolosa. È una strategia di difesa approfondita.”

Il CEO di CrowdStrike, George Kurtz, ha evidenziato ClawHavoc (una campagna sulla catena di fornitura mirata al framework degli agenti OpenClaw) all’RSAC durante il suo intervento. Sicurezza delle Koi ha nominato la campagna il 1° febbraio 2026. Antiy CERT ha confermato 1.184 competenze dannose legate a 12 account di editori, secondo multiplo analisi indipendenti della campagna. La ricerca ToxicSkills di Snyk ha rilevato che il 36,8% delle 3.984 competenze ClawHub analizzate contengono difetti di sicurezza a qualsiasi livello di gravità, con il 13,4% classificato come critico. Il tempo medio di breakout è sceso a 29 minuti. Più veloce osservato: 27 secondi. (Rapporto CrowdStrike 2026 sulle minacce globali)

Antropico separa il cervello dalle mani

Agenti gestiti di Anthropiclanciato l’8 aprile in beta pubblica, divide ogni agente in tre componenti che non si fidano l’uno dell’altro: un cervello (Claude e il cablaggio che instradano le sue decisioni), mani (contenitori Linux usa e getta in cui viene eseguito il codice) e una sessione (un registro eventi di sola aggiunta all’esterno di entrambi).

Separare le istruzioni dall’esecuzione è uno dei modelli più antichi del software program. Microservizi, funzioni serverless e code di messaggi.

Le credenziali non entrano mai nella sandbox. Anthropic archivia i token OAuth in un deposito esterno. Quando l’agente deve chiamare uno strumento MCP, invia un token associato alla sessione a un proxy dedicato. Il proxy recupera le credenziali reali dal vault, effettua la chiamata esterna e restituisce il risultato. L’agente non vede mai il token effettivo. I token Git vengono collegati al telecomando locale durante l’inizializzazione del sandbox. Lavoro push e pull senza che l’agente tocchi le credenziali. Per i direttori della sicurezza, ciò significa che una sandbox compromessa non produce nulla che un utente malintenzionato possa riutilizzare.

Il miglioramento della sicurezza è arrivato come effetto collaterale di una correzione delle prestazioni. Anthropic ha disaccoppiato il cervello dalle mani in modo che l’inferenza potesse iniziare prima dell’avvio del contenitore. Tempo medio per il primo token è sceso di circa il 60%. Il design Zero Belief è anche il design più veloce. Ciò elimina l’obiezione aziendale secondo cui la sicurezza aggiunge latenza.

La durata della sessione è il terzo vantaggio strutturale. Un crash del container nel modello monolitico significa la perdita totale dello stato. Negli agenti gestiti, il registro della sessione persiste al di fuori sia del cervello che delle mani. Se il cablaggio si blocca, ne viene avviato uno nuovo, legge il registro eventi e riprende. Nessuna perdita statale si trasforma nel tempo in un aumento di produttività. Gli agenti gestiti includono la traccia delle sessioni integrata tramite Claudio Console.

Prezzo: 0,08 USD per ora di sessione di runtime attivo, tempi di inattività esclusi, più i costi dei token API customary. I direttori della sicurezza possono ora modellare il costo di compromesso degli agenti per sessione-ora rispetto al costo dei controlli dell’architettura.

Nvidia blocca il sandbox e monitora tutto al suo interno

NemoClaw di Nvidiapubblicato il 16 marzo in anteprima, adotta l’approccio opposto. Non separa l’agente dal suo ambiente di esecuzione. Avvolge l’intero agente in quattro livelli di sicurezza sovrapposti e controlla ogni mossa. Anthropic e Nvidia sono gli unici due fornitori advert aver distribuito pubblicamente architetture di agenti zero-trust al momento della stesura di questo articolo; altri sono in fase di sviluppo.

NemoClaw raggruppa cinque livelli di applicazione tra l’agente e l’host. L’esecuzione in modalità sandbox utilizza Landlock, seccomp e l’isolamento dello spazio dei nomi di rete a livello di kernel. La rete in uscita con rifiuto predefinito impone ogni connessione esterna tramite l’approvazione esplicita dell’operatore tramite Politica basata su YAML. L’accesso viene eseguito con privilegi minimi. Un router per la privateness indirizza le question sensibili ai modelli Nemotron eseguiti localmente, riducendo a zero il costo dei token e la perdita di dati. Il livello più importante per i crew di sicurezza è la verifica degli intenti: il motore delle coverage di OpenShell intercetta ogni azione dell’agente prima che tocchi l’host. Il compromesso per le organizzazioni che valutano NemoClaw è semplice. Una maggiore visibilità in fase di esecuzione costa più personale da parte dell’operatore.

L’agente non sa di essere all’interno di NemoClaw. Le azioni all’interno della coverage ritornano normalmente. Le azioni fuori coverage ricevono un rifiuto configurabile.

L’osservabilità è lo strato più forte. Un’interfaccia utente terminale in tempo reale registra ogni azione, ogni richiesta di rete, ogni connessione bloccata. La traccia di controllo è completa. Il problema è il costo: il carico dell’operatore scala linearmente con l’attività dell’agente. Ogni nuovo endpoint richiede l’approvazione manuale. La qualità dell’osservazione è alta. L’autonomia è bassa. Questo rapporto diventa rapidamente costoso negli ambienti di produzione che eseguono dozzine di agenti.

La durabilità è il divario di cui nessuno parla. Lo stato dell’agente persiste come file all’interno della sandbox. Se la sandbox fallisce, lo stato se ne va. Non esiste alcun meccanismo di ripristino della sessione esterna. Le attività dell’agente a lungo termine comportano un rischio di durabilità che i crew di sicurezza devono valutare nella pianificazione della distribuzione prima che entrino in produzione.

Il divario di prossimità delle credenziali

Entrambe le architetture rappresentano un reale passo avanti rispetto all’impostazione predefinita monolitica. Il punto in cui divergono è la domanda che conta di più per i crew di sicurezza: quanto sono vicine le credenziali all’ambiente di esecuzione?

Anthropic rimuove completamente le credenziali dal raggio dell’esplosione. Se un utente malintenzionato compromette la sandbox tramite una pronta iniezione, ottiene un contenitore usa e getta senza token e senza stato persistente. L’esfiltrazione delle credenziali richiede un attacco a due passi: influenzare il ragionamento del cervello, quindi convincerlo advert agire attraverso un contenitore che non contiene nulla che valga la pena rubare. L’esfiltrazione single-hop è strutturalmente eliminata.

NemoClaw limita il raggio dell’esplosione e monitora ogni azione al suo interno. Quattro strati di sicurezza limitano il movimento laterale. La rete negata per impostazione predefinita blocca le connessioni non autorizzate. Ma l’agente e il codice generato condividono la stessa sandbox. Il router per la privateness di Nvidia mantiene le credenziali di inferenza sull’host, al di fuori della sandbox. Ma i token di messaggistica e integrazione (Telegram, Slack, Discord) vengono inseriti nella sandbox come variabili di ambiente runtime. Le chiavi API di inferenza vengono proxy tramite il router di privateness e non vengono passate direttamente nella sandbox. L’esposizione varia in base al tipo di credenziale. Le credenziali sono vincolate alle coverage e non rimosse strutturalmente.

Questa distinzione è particolarmente importante per il immediate injection indiretto, in cui un avversario incorpora istruzioni nel contenuto interrogato dall’agente come parte del lavoro legittimo. Una pagina net avvelenata. Una risposta API manipolata. Il livello di verifica dell’intento valuta ciò che l’agente propone di fare, non il contenuto dei dati restituiti da strumenti esterni. Le istruzioni inserite entrano nella catena di ragionamento come contesto attendibile. In prossimità dell’esecuzione.

Nell’architettura antropica, l’iniezione indiretta può influenzare il ragionamento ma non può raggiungere il caveau delle credenziali. Nell’architettura NemoClaw, il contesto inserito si trova accanto sia al ragionamento che all’esecuzione all’interno del sandbox condiviso. Questo è il divario più ampio tra i due progetti.

David Brauchler di NCC Group, direttore tecnico e responsabile della sicurezza AI/ML, sostenitori delle architetture ad agenti controllati costruito su principi di segmentazione della fiducia dove i sistemi di intelligenza artificiale ereditano il livello di fiducia dei dati che elaborano. Enter non attendibile, funzionalità limitate. Sia Anthropic che Nvidia si muovono in questa direzione. Nessuno dei due arriva completamente.

L’audit dell’architettura Zero Belief per gli agenti IA

La griglia di controllo copre tre modelli di fornitori in sei dimensioni di sicurezza, cinque azioni per riga. Si distilla in cinque priorità:

-

Controlla ogni agente distribuito per il modello monolitico. Contrassegna qualsiasi agente che detiene token OAuth nel suo ambiente di esecuzione. IL Dati CSA mostra che il 43% utilizza account di servizi condivisi. Questi sono i primi obiettivi.

-

Richiedere l’isolamento delle credenziali nelle RFP di distribuzione dell’agente. Specificare se il fornitore rimuove le credenziali strutturalmente o le blocca tramite coverage. Entrambi riducono il rischio. Lo riducono di quantità numerous con numerous modalità di guasto.

-

Testare il recupero della sessione prima della produzione. Uccidi un sandbox durante un’attività. Verificare che lo stato sopravviva. In caso contrario, il lavoro a lungo termine comporta un rischio di perdita di dati che aumenta con la durata dell’attività.

-

Employees per il modello di osservabilità. Il tracciamento della console di Anthropic si integra con i flussi di lavoro di osservabilità esistenti. La TUI di NemoClaw richiede un operatore in-the-loop. I calcoli relativi al personale sono diversi.

-

Tieni traccia delle roadmap di iniezione tempestiva indiretta. Nessuna delle due architetture risolve completamente questo vettore. Antropico limita il raggio di esplosione di un’iniezione riuscita. NemoClaw rileva le azioni proposte dannose ma non i dati restituiti dannosi. Richiedere impegni nella roadmap dei fornitori su questo divario specifico.

La Zero Belief per gli agenti IA ha smesso di essere un argomento di ricerca nel momento in cui sono state spedite due architetture. Il default monolitico è una passività. Il divario di 65 punti tra la velocità di implementazione e l’approvazione della sicurezza è il punto in cui avrà inizio la prossima classe di violazioni.