I sistemi multi-agente, progettati per gestire attività a lungo orizzonte come l’ingegneria del software program o il triaging della sicurezza informatica, possono generare fino a 15 volte il quantity di token delle chat commonplace, mettendo a rischio la loro redditività nella gestione delle attività aziendali.

Ma oggi Nvidia ha cercato di aiutare a risolvere questo problema l’uscita di Nemotron 3 Superun modello ibrido da 120 miliardi di parametri, con i pesi pubblicati Volto che abbraccia.

Unendo filosofie architettoniche disparate – modelli stato-spazio, trasformatori e un nuovo design “latente” con una miscela di esperti – Nvidia sta tentando di fornire la profondità specializzata richiesta per flussi di lavoro agenti senza l’ingombro tipico dei modelli di ragionamento denso, e il tutto disponibile per l’uso commerciale con pesi per lo più aperti.

Tripla architettura ibrida

Al centro di Nemotron 3 Tremendous c’è una sofisticata triade architettonica che bilancia l’efficienza della memoria con il ragionamento preciso. Il modello utilizza a Dorsale ibrida Mamba-Transformerche intercala gli strati di Mamba-2 con gli strati strategici di attenzione del Transformer.

Per comprendere le implicazioni per la produzione aziendale, si consideri il problema dell’“in the past nel pagliaio”. Gli strati Mamba-2 agiscono come un sistema autostradale a “viaggio veloce”, gestendo la stragrande maggioranza dell’elaborazione delle sequenze con complessità temporale lineare. Ciò consente al modello di mantenere un’enorme finestra di contesto da 1 milione di token senza che l’impronta di memoria della cache KV esploda. Tuttavia, i modelli puri dello spazio degli stati spesso hanno difficoltà con il richiamo associativo.

Per risolvere questo problema, Nvidia inserisce strategicamente i livelli di attenzione di Transformer come “ancoraggi globali”, garantendo che il modello possa recuperare con precisione fatti specifici sepolti in profondità all’interno di una base di codice o di una pila di report finanziari.

Al di là della spina dorsale, il modello introduce Miscela latente di esperti (LatentMoE). I tradizionali progetti Combination-of-Specialists (MoE) instradano i token agli esperti nella loro dimensione completamente nascosta, il che crea un collo di bottiglia computazionale man mano che i modelli si ridimensionano. LatentMoE risolve questo problema proiettando i token in uno spazio compresso prima di indirizzarli agli specialisti.

Questa “compressione degli esperti” consente al modello di consultare un numero quattro volte superiore di specialisti per lo stesso identico costo computazionale. Questa granularità è vitale per gli agenti che devono passare dalla sintassi Python, alla logica SQL e al ragionamento conversazionale in un unico turno.

Advert accelerare ulteriormente il modello è il Multi-Token Prediction (MTP). Mentre i modelli commonplace prevedono un singolo token successivo, MTP prevede diversi token futuri contemporaneamente. Questo funge da “modello di bozza integrato”, consentendo la decodifica speculativa nativa in grado di fornire velocità fino a 3 volte superiori per attività di generazione strutturata come chiamate di codice o strumenti.

Il vantaggio Blackwell

Per le aziende, il salto tecnico più significativo in Nemotron 3 Tremendous è l’ottimizzazione per la piattaforma GPU Nvidia Blackwell. Grazie al pre-addestramento nativo in NVFP4 (virgola cell a 4 bit), Nvidia ha ottenuto una svolta nell’efficienza produttiva.

Su Blackwell, il modello offre un’inferenza 4 volte più veloce rispetto ai modelli a 8 bit eseguiti sulla precedente architettura Hopper, senza perdita di precisione.

Nelle prestazioni pratiche, Nemotron 3 Tremendous è uno strumento specializzato per il ragionamento agente.

Attualmente detiene la posizione n. 1 nel DeepResearch Bench, un punto di riferimento che misura la capacità di un’intelligenza artificiale di condurre ricerche approfondite in più fasi su grandi quantità di documenti.

|

Segno di riferimento |

Nemotron 3Super |

Qwen3.5-122B-A10B |

GPT-OSS-120B |

|

Conoscenza generale |

|||

|

MMLU-Professional |

83,73 |

86,70 |

81,00 |

|

Ragionamento |

|||

|

AIME25 (nessuno strumento) |

90.21 |

90.36 |

92,50 |

|

HMMT Feb25 (nessuno strumento) |

93,67 |

91,40 |

90,00 |

|

HMMT Feb25 (con strumenti) |

94,73 |

89,55 |

— |

|

GPQA (nessuno strumento) |

79.23 |

86,60 |

80.10 |

|

GPQA (con strumenti) |

82,70 |

— |

80.09 |

|

LiveCodeBench (v5 2024-07↔2024-12) |

81.19 |

78,93 |

88,00 |

|

SciCode (attività secondaria) |

42.05 |

42.00 |

39,00 |

|

HLE (senza strumenti) |

18.26 |

25.30 |

14.90 |

|

HLE (con strumenti) |

22.82 |

— |

19.0 |

|

Agente |

|||

|

Terminal Bench (sottoinsieme rigido) |

25.78 |

26.80 |

24.00 |

|

Terminale Bench Core 2.0 |

31.00 |

37,50 |

18.70 |

|

Panca SWE (OpenHands) |

60.47 |

66,40 |

41.9 |

|

Banco SWE (OpenCode) |

59.20 |

67,40 |

— |

|

Panca SWE (Codice) |

53.73 |

61.20 |

— |

|

SWE-Bench multilingue (OpenHands) |

45.78 |

— |

30,80 |

|

TauBench V2 |

|||

|

Compagnia aerea |

56.25 |

66.0 |

49.2 |

|

Vedere al dettaglio |

62.83 |

62.6 |

67,80 |

|

Telecomunicazioni |

64.36 |

95,00 |

66,00 |

|

Media |

61.15 |

74.53 |

61.0 |

|

SfogliaComp con la ricerca |

31.28 |

— |

33,89 |

|

Panchina UCCELLO |

41,80 |

— |

38.25 |

|

Chat e istruzioni seguenti |

|||

|

IFBench (richiesta) |

72.56 |

73,77 |

68.32 |

|

Scala la sfida multipla dell’IA |

55.23 |

61,50 |

58.29 |

|

Area-Onerous-V2 |

73,88 |

75.15 |

90.26 |

|

Contesto lungo |

|||

|

AA-LCR |

58.31 |

66,90 |

51,00 |

|

RIGHELLO @ 256k |

96.30 |

96,74 |

52.30 |

|

RIGHELLO @ 512k |

95,67 |

95,95 |

46,70 |

|

RIGHELLO @ 1M |

91,75 |

91.33 |

22.30 |

|

Multilingue |

|||

|

MMLU-ProX (media sulla lingua) |

79.36 |

85.06 |

76,59 |

|

WMT24++ (it→xx) |

86,67 |

87,84 |

88,89 |

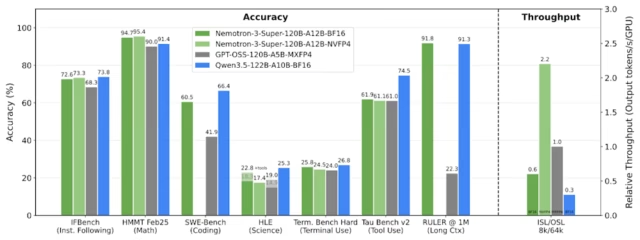

Dimostra inoltre vantaggi significativi in termini di throughput, ottenendo un throughput fino a 2,2 volte superiore rispetto a gpt-oss-120B e 7,5 volte superiore a Qwen3.5-122B in impostazioni di quantity elevato.

Licenza “aperta” personalizzata: uso commerciale ma con importanti avvertenze

Il rilascio di Nemotron 3 Tremendous sotto il Contratto di licenza Nvidia Open Model (aggiornato nell’ottobre 2025) fornisce un quadro permissivo per l’adozione aziendale, sebbene contenga clausole di “salvaguardia” distinte che la differenziano dalle licenze open supply pure come MIT o Apache 2.0.

Disposizioni chiave per gli utenti aziendali:

-

Usabilità commerciale: La licenza afferma esplicitamente che i modelli sono “utilizzabili commercialmente” e garantisce una licenza perpetua, mondiale ed esente da royalty per vendere e distribuire prodotti basati sul modello.

-

Proprietà dell’output: Nvidia non avanza alcuna pretesa sugli output generati dal modello; la responsabilità di tali output e la loro proprietà spetta interamente all’utente.

-

Opere derivate: Le imprese sono libere di creare e possedere “modelli derivati” (versioni perfezionate), a condizione che includano l’avviso di attribuzione richiesto: “Concesso in licenza da Nvidia Company ai sensi della licenza Nvidia Open Mannequin.”

Le “Linee Rosse”:

La licenza embrace due fattori critici di risoluzione che i workforce di produzione devono monitorare:

-

Guardie di sicurezza: La licenza termina automaticamente se un utente bypassa o elude i “guardrail” del modello (limitazioni tecniche o iperparametri di sicurezza) senza implementare una sostituzione “sostanzialmente simile” adeguata al caso d’uso.

-

Fattore scatenante del contenzioso: Se un utente avvia una controversia sul copyright o sui brevetti contro Nvidia sostenendo che il modello viola il suo IP, la sua licenza per utilizzare il modello termina immediatamente.

Questa struttura consente a Nvidia di promuovere un ecosistema commerciale proteggendosi al tempo stesso dall'”IP trolling” e garantendo che il modello non venga privato delle sue funzionalità di sicurezza per usi dannosi.

“La squadra ha davvero cucinato”

Il rilascio ha generato un notevole interesse all’interno della comunità degli sviluppatori. Chris Alexiuk, Senior Product Analysis Enginner presso Nvidia, ha annunciato il lancio di X sotto la sua guida @llm_wizard come un “SUPER DAY”, sottolineando la velocità e la trasparenza del modello. “Il modello è: VELOCE. Il modello è: INTELLIGENTE. Il modello è: IL MODELLO PIÙ APERTO CHE ABBIAMO REALIZZATO ANCORA,” Chris ha pubblicato un publish evidenziando il rilascio non solo di pesi, ma di 10 trilioni di token di dati e ricette di allenamento.

L’adozione da parte del settore riflette questo entusiasmo:

-

Cloud e {hardware}: Il modello viene distribuito come file Microservizio NIM di Nvidiaconsentendone l’esecuzione in locale tramite il file Fabbrica di intelligenza artificiale Dell O HPEnonché su Google Cloud, Oracle e, a breve, AWS e Azure.

-

Agenti di produzione: Alle aziende piace CodeRabbit (sviluppo software program) e Greptile stanno integrando il modello per gestire l’analisi della base di codice su larga scala, mentre i chief industriali apprezzano Siemens E Palantir lo stanno implementando per automatizzare flussi di lavoro complessi nella produzione e nella sicurezza informatica.

Come ha osservato Kari Briski, vicepresidente di Nvidia di AI Software program: “Mentre le aziende vanno oltre i chatbot e si orientano verso applicazioni multi-agente, incontrano… un’esplosione del contesto.”

Nemotron 3 Tremendous è la risposta di Nvidia a quell’esplosione: un modello che fornisce la “potenza intellettuale” di un sistema di parametri 120B con l’efficienza operativa di uno specialista molto più piccolo. Per le imprese il messaggio è chiaro: la “tassa sulla riflessione” sta finalmente per essere ridotta.