Negli ultimi anni, startup cinese di intelligenza artificiale MiniMax è diventato uno dei più entusiasmanti nell’affollato mercato globale dell’intelligenza artificiale, ritagliandosi una reputazione per la fornitura di modelli linguistici di grandi dimensioni (LLM) a livello di frontiera con licenze open supply e, prima ancora, di modelli di generazione video AI di alta qualità (Hailuo).

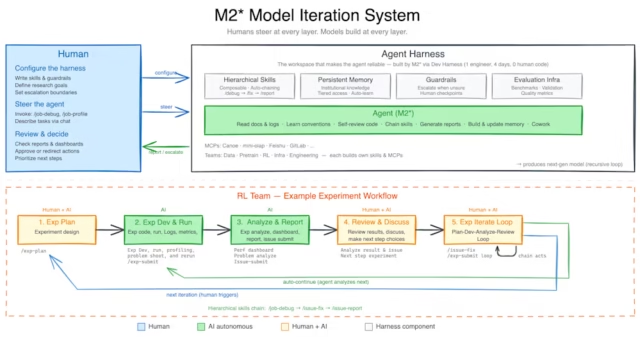

Il rilascio di MiniMax M2.7 oggi – un nuovo LLM proprietario progettato per eseguire agenti IA potenti e come backend per cablaggi e strumenti di terze parti come Claude Code, Kilo Code e OpenClaw – segna ancora una nuova pietra miliare: anziché fare affidamento esclusivamente sulla messa a punto guidata dall’uomo, MiniMax ha sfruttato M2.7 per costruire, monitorare e ottimizzare i propri cablaggi di apprendimento per rinforzo.

Questo movimento verso l’auto-miglioramento ricorsivo segnala un cambiamento nel settore: un futuro in cui i modelli che utilizziamo sono tanto gli architetti del loro progresso quanto i prodotti della ricerca umana. Il modello è classificato come modello testuale di solo ragionamento che fornisce informazioni paragonabili advert altri sistemi chief pur mantenendo un’efficienza in termini di costi significativamente più elevata.

Tuttavia, il fatto che per ora M2.7 sia proprietario, è un segno ancora una volta che le startup cinesi basate sull’intelligenza artificiale – per gran parte dell’ultimo anno, portabandiera nel mondo della frontiera dell’AI open sourcerendendoli attraenti per le imprese a livello globale grazie ai costi bassi (o nulli) e alla personalizzazione, stanno cambiando strategia e perseguendo modelli di frontiera più proprietari, come fanno da anni chief statunitensi come OpenAI, Google e Anthropic.

MiniMax diventa la seconda startup cinese a rilasciare un LLM proprietario all’avanguardia negli ultimi mesi, dopo z.ai con il suo GLM-5 Turbo, e le voci secondo cui anche il group Qwen di Alibaba si sta spostando verso lo sviluppo proprietario sulla scia della partenza della management senior e di altri ricercatori.

Risultati tecnici: il ciclo di autoevoluzione

La caratteristica distintiva del MiniMax M2.7 è il suo ruolo nella sua stessa creazione. Secondo la documentazione aziendalele versioni precedenti del modello sono state utilizzate per creare un sistema di agenti di ricerca in grado di gestire pipeline di dati, ambienti di formazione e infrastrutture di valutazione.

Attivando in modo autonomo la lettura dei log, il debug e l’analisi delle metriche, M2.7 gestiva tra il 30% e il 50% del proprio flusso di lavoro di sviluppo.

Non si tratta semplicemente di un’automazione dei compiti meccanici; il modello ha ottimizzato le proprie prestazioni di programmazione analizzando le traiettorie di errore e pianificando modifiche al codice su cicli iterativi di 100 o più cicli.

“Abbiamo intenzionalmente addestrato il modello per essere migliore nella pianificazione e nel chiarire i requisiti con l’utente”, ha spiegato Skyler Miao, responsabile tecnico di MiniMax sul social network X. “Il prossimo passo è un simulatore utente più complesso per spingerci ancora oltre.”

Questa funzionalità si estende advert ambienti complessi tramite MLE Panca Lite, una serie di gare di machine studying progettate per testare le capacità di ricerca autonoma.

In queste show, M2.7 ha ottenuto una percentuale di medaglie del 66,6%, a livello di prestazioni che si lega al nuovo Gemini 3.1 di Google e si avvicina agli attuali benchmark all’avanguardia stabiliti da Claude Opus 4.6 di Anthropic.

L’obiettivo, secondo MiniMax, è una transizione verso la piena autonomia nell’addestramento dei modelli e nell’architettura di inferenza senza il coinvolgimento umano.

Evoluzione delle prestazioni: MiniMax m2.7 contro m2.5

Rispetto al suo predecessore, M2.5, rilasciato nel febbraio 2026, il modello M2.7 dimostra vantaggi significativi nell’ingegneria del software program advert alto rischio e nelle attività di ufficio professionale.

Mentre M2.5 è stato celebrato per la padronanza del codice poliglotta, M2.7 è progettato per attività di ingegneria del mondo reale che richiedono ragionamento causale all’interno di sistemi di produzione reside.

I parametri chiave delle prestazioni includono:

-

Ingegneria del software program: M2.7 ha ottenuto il 56,22% sul benchmark SWE-Professional, eguagliando i livelli più alti di concorrenti globali come GPT-5.3-Codex.

-

Consegna in ufficio professionale: Nell’elaborazione dei documenti, M2.7 ha ottenuto un punteggio Elo di 1495 su GDPval-AA, che secondo l’azienda è il più alto tra i modelli accessibili open supply.

-

Riduzione delle allucinazioni: Il modello ottiene un punteggio più uno nell’indice AA-Omniscience, un enorme balzo in avanti rispetto al punteggio negativo di 40 detenuto da M2.5.

-

Tasso di allucinazioni: M2.7 raggiunge un tasso di allucinazioni del 34%, inferiore al tasso del 46% di Claude Sonnet 4.6 e del 50% di Gemini 3.1 Professional Preview.

-

Comprensione del sistema: Sul Terminal Bench 2, il modello ha ottenuto un punteggio del 57,0%, dimostrando una profonda comprensione della logica operativa complessa piuttosto che della semplice generazione di codice.

-

Aderenza alle competenze: Nella valutazione MM Claw, che mette alla prova 40 abilità complesse che superano i 2.000 token ciascuna, M2.7 ha mantenuto un tasso di adesione del 97%, un miglioramento sostanziale rispetto alla linea di base M2.5.

-

Parità di intelligenza: Le capacità di ragionamento del modello sono thoughtful equivalenti a GLM-5, ma utilizza il 20% in meno di token di output per ottenere risultati simili.

L’evoluzione del modello è ulteriormente evidenziata dalla sua punteggio di 50 sull’Indice di Intelligenza Analisi Artificialeche rappresenta un miglioramento di 8 punti rispetto al suo predecessore in un solo mese, e occupa anche l’ottavo posto assoluto a livello globale in termini di intelligenza complessiva nelle attività di benchmarking in vari settori.

Non tutti i benchmark indipendenti di terze parti mostrano un miglioramento per M2.7 rispetto a M2.5: Sì BridgeBenchuna serie di attività progettate dalla startup di codifica di intelligenza artificiale BridgeMind per testare le prestazioni di un modello per la “codificazione delle vibrazioni” o la trasformazione del linguaggio naturale in codice funzionante, M2.5 ha ottenuto il 12° posto mentre M2.7 ha ottenuto il 19° posto.

Accesso, prezzi e integrazione

MiniMax M2.7 è un modello proprietario disponibile tramite le piattaforme di creazione MiniMax API e MiniMax Agent. Sebbene i pesi del modello principale per M2.7 rimangano chiusi, l’azienda continua a contribuire all’ecosistema attraverso il progetto interattivo open supply OpenRoom.

Per l’integrazione API diretta e tramite supplier di terze parti OpenRouterMiniMax M2.7 mantiene un prezzo chief in termini di costi di 0,30 dollari per 1 milione di token di enter e 1,20 dollari per 1 milione di token di output, che è invariato rispetto al prezzo di M2.5.

Per supportare various scale e modalità di utilizzo, MiniMax offre un piano token strutturato con vari livelli di abbonamento. Questi piani consentono agli utenti di accedere a modelli di testo, parlato, video, immagini e musica con un’unica quota unificata.

Per promuovere ulteriormente l’adozione, MiniMax ha lanciato un programma di riferimento Invita e guadagna, fornendo uno sconto del 10% ai nuovi invitati e un buono sconto del 10% all’invitante.

Prezzi del piano token normal mensile: I livelli mensili normal sono progettati per gli sviluppatori entry-level e gli utenti abituali.

-

Antipasto: $ 10 al mese per 1.500 richieste ogni 5 ore.

-

Più: $ 20 al mese per 4.500 richieste ogni 5 ore.

-

Massimo: $ 50 al mese per 15.000 richieste ogni 5 ore.

Prezzi mensili del piano token advert alta velocità: Per i carichi di lavoro su scala di produzione che richiedono la variante M2.7 advert alta velocità, sono disponibili i seguenti livelli:

-

Plus-Alta velocità: $ 40 al mese per 4.500 richieste ogni 5 ore.

-

Velocità massima: $80 al mese per 15.000 richieste ogni 5 ore.

-

Ultravelocità: $ 150 al mese per 30.000 richieste ogni 5 ore.

Prezzi del piano token annuale: Gli abbonamenti annuali offrono sconti significativi per un impegno a lungo termine:

-

Antipasto normal: $ 100 all’anno (risparmia 20 dollari).

-

Customary Più: $ 200 all’anno (risparmia 40 dollari).

-

Customary massimo: $ 500 all’anno (risparmia 100 dollari).

-

Alta velocità Plus: $ 400 all’anno (risparmia 80 dollari).

-

Massima advert alta velocità: $ 800 all’anno (risparmia 160 dollari).

-

Extremely advert alta velocità: $ 1.500 all’anno (risparmia 300 dollari).

Una richiesta in questi piani equivale all’incirca a una chiamata al MiniMax M2.7, sebbene altri modelli della suite, come video o voce advert alta definizione, consumino le richieste a un ritmo più elevato.

Integrazioni di strumenti ufficiali

Per garantire un’adozione senza intoppi, MiniMax ha fornito la documentazione ufficiale per l’integrazione di M2.7 in oltre 11 principali strumenti di sviluppo e cablaggi di agenti.

Ciò embrace piattaforme ampiamente utilizzate come Claude Code, Cursor, Trae e Zed. Altri strumenti ufficialmente supportati includono OpenCode, Kilo Code, Cline, Roo Code, Droid, Grok CLI e Codex CLI.

Inoltre, il modello supporta il Mannequin Context Protocol, che gli consente di utilizzare in modo nativo strumenti come Ricerca Internet e Comprendere immagini per il ragionamento multimodale. Gli sviluppatori che utilizzano Anthropic SDK possono facilmente integrare M2.7 modificando ANTHROPIC_BASE_URL in modo che punti all’endpoint MiniMax.

Quando si utilizza MiniMax come fornitore in strumenti come OpenClaw, le funzionalità di comprensione delle immagini vengono configurate automaticamente tramite l’endpoint API VLM del modello, senza richiedere alcuna configurazione aggiuntiva da parte dell’utente.

Con la sua profonda gamma di integrazioni e il suo approccio pionieristico all’autoevoluzione ricorsiva, MiniMax M2.7 rappresenta un passo significativo verso un futuro nativo dell’intelligenza artificiale in cui i modelli sono coinvolti nel proprio progresso tanto quanto gli esseri umani che li guidano.

Implicazioni strategiche per i decisori aziendali

I decisori tecnici dovrebbero interpretare la versione M2.7 come una prova del fatto che l’intelligenza artificiale è passata dalla prototipazione teorica all’utilità pronta per la produzione.

La capacità del modello di ridurre i tempi di ripristino per gli incidenti di produzione reside a meno di tre minuti correlando in modo autonomo i parametri di monitoraggio con i repository di codice suggerisce un cambiamento di paradigma per i group SRE e DevOps.

Le aziende che attualmente si trovano sotto pressione per adottare efficienze basate sull’intelligenza artificiale devono decidere se accontentarsi dell’intelligenza artificiale come assistente sofisticato o se sono pronte a integrare group di agenti nativi in grado di fornire progetti completi end-to-end.

Da un punto di vista finanziario, M2.7 rappresenta un significativo passo avanti in termini di efficienza dei costi per il ragionamento di alto livello. L’analisi indica che M2.7 costa meno di un terzo rispetto a GLM-5 a livelli di intelligenza equivalenti.

Advert esempio, l’esecuzione di un indice di intelligence normal costa 176 dollari su M2.7 rispetto a 547 dollari per GLM-5 e 371 dollari per Kimi K2.5. Questa strategia di prezzo aggressiva colloca M2.7 sulla frontiera di Pareto del grafico intelligenza/costo, offrendo un ragionamento a livello aziendale a una frazione del tasso di mercato.

Il mercato attuale è saturo di modelli advert alte prestazioni, molti dei quali mantengono ancora lievi vantaggi nei punteggi del ragionamento generale. Ma l’ottimizzazione specifica di M2.7 per la fedeltà della suite Workplace in Excel, PPT e Phrase e le sue elevate prestazioni nel benchmark GDPval-AA lo rendono un candidato primario per le organizzazioni focalizzate su flussi di lavoro di documenti professionali e modelli finanziari.

I decisori devono valutare i vantaggi di un modello di frontiera generico rispetto a un motore specializzato come M2.7, costruito per interagire con scaffold e strumenti interni complessi.

In definitiva, il fatto che sia messo in campo da una società cinese (con sede a Shanghai) e soggetto alle leggi di quel paese oltre a quelle del paese dell’utente, e non sia ancora disponibile per l’utilizzo offline o locale, potrebbe renderlo difficile da vendere per le imprese che operano negli Stati Uniti e in Occidente, specialmente quelle in settori altamente regolamentati o rivolti al governo.

Tuttavia, lo spostamento verso modelli in autoevoluzione suggerisce che il ROI degli investimenti nell’intelligenza artificiale sarà sempre più legato ai guadagni ricorsivi del sistema stesso.

Le organizzazioni che adottano modelli in grado di migliorare i propri strumenti potrebbero trovarsi su una curva di iterazione più rapida rispetto a quelle che si affidano a un perfezionamento statico e esclusivamente umano. Grazie all’aggressiva integrazione di MiniMax nel moderno stack degli sviluppatori, la barriera nel testare questi flussi di lavoro autonomi è diminuita in modo significativo, esercitando pressione sui concorrenti affinché forniscano funzionalità native simili per agenti.