Segui ZDNET: Aggiungici come fonte preferita su Google.

I principali punti salienti di ZDNET

- Nvidia ha rilasciato nuovi modelli per robotic autonomi, automobili e altro ancora.

- Uber aggiungerà robotaxi alimentati da Nvidia nelle città già nel 2027.

- Una robotica più realistica potrebbe significare personaggi robotici a Disney World.

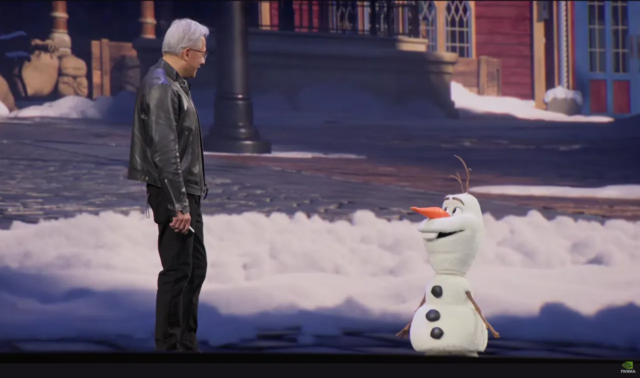

Per chiudere il suo keynote su Nvidia GTC lunedì, il CEO Jensen Huang ha presentato un ospite inaspettato: una versione robotic che cammina e parla di Olaf, il pupazzo di neve animato del movie Frozen della Disney. Huang ha spiegato a Robo-Olaf di aver utilizzato la piattaforma Jetson di Nvidia e di aver imparato a camminare all’interno del simulatore Omniverse dell’azienda

Le risposte di Olaf non sempre avevano senso: la conversazione period imbarazzante, ma l’concept period chiara: in futuro, i personaggi robotici avrebbero potuto vagare per Disneyland utilizzando la tecnologia di Nvidia.

Inoltre: Nvidia vuole possedere il tuo information middle AI da un capo all’altro

L’intelligenza artificiale fisica – i sistemi di intelligenza artificiale incorporati in macchine come robotic o automobili che navigano in ambienti del mondo reale, al contrario dei modelli bloccati nel cloud o sul telefono – ha guadagnato terreno nell’ultimo anno ed è stata presente in tutto il CES lo scorso gennaio. Al GTC, Nvidia ha fatto diversi investimenti nella tecnologia, dai nuovi modelli al supporto per i dati che creano o distruggono i sistemi fisici di intelligenza artificiale.

Ecco le novità.

Nuovi modelli per l’intelligenza artificiale fisica

Nvidia ha rilasciato diversi nuovi modelli di base volti a migliorare il funzionamento di robotic e veicoli nel mondo reale. Includono Cosmos 3, che genera mondi sintetici per aiutare l’intelligenza artificiale fisica a navigare in ambienti complessi; Isaac GR00T N1.7, un “modello VLA (Imaginative and prescient Language Motion) con ragionamento aperto” costruito per robotic umanoidi, che secondo la società è “commercialmente fattibile per l’implementazione nel mondo reale”; e Alpamayo 1.5, un altro modello VLA ragionato che offre ai veicoli a guida autonoma una migliore guida alla navigazione e specifiche tempestive.

Inoltre: Nvidia scommette su OpenClaw, ma aggiunge un livello di sicurezza: come funziona NemoClaw

Nvidia ha definito Alpamayo 1.5 “un importante aggiornamento” all’interno della sua famiglia di modelli di veicoli autonomi esistente, sottolineando che “utilizza come enter video di guida, cronologia dei movimenti dell’ego, guida alla navigazione e istruzioni in linguaggio naturale”. Trasforma questi enter in traiettorie di guida che consentono agli sviluppatori di monitorare da vicino il comportamento di un veicolo e creare barriere di sicurezza tramite suggerimenti. Nvidia ha affermato che Alpamayo 1.5 può aiutare a portare la guida autonoma a un livello superiore rendendo più semplice l’apprendimento da eventi stradali imprevedibili, condizioni meteorologiche o attività pedonale.

Attualmente, ha affermato Nvidia, i suoi clienti utilizzano Cosmos 3 per addestrare i sistemi fisici di intelligenza artificiale e GR00T N1.7 per “dimensionare l’implementazione di robotic umanoidi”.

Veicoli autonomi

Con l’immagine di 110 robotic diversi alle spalle, il CEO di Nvidia Jensen Huang ha descritto il nostro presente, dicendo che “il momento ChatGPT delle auto a guida autonoma è arrivato”.

Nvidia sta ampliando la sua partnership con Uber, affermando che “lancerà una flotta di veicoli autonomi” alimentati interamente dal software program Drive AV di Nvidia in 28 città di quattro continenti entro il 2028, con Los Angeles e San Francisco che inizieranno all’inizio del 2027. Presumibilmente, ciò significa che gli utenti saranno in grado di prenotare auto a guida autonoma nell’app Uber su una scala molto più ampia.

Inoltre: perché i backup crittografati potrebbero fallire nell’period dei ransomware guidati dall’intelligenza artificiale

“Questa flotta basata su DRIVE Hyperion attingerà ai modelli aperti NVIDIA Alpamayo e al sistema operativo NVIDIA Halos per accelerare lo sviluppo e l’implementazione di servizi robotaxi sicuri e scalabili in tutto il mondo”, ha affermato la società nel comunicato stampa. pubblicazione.

L’azienda sta inoltre aggiungendo numerous case automobilistiche, tra cui BYD, Hyundai, Nissan e Geely, alla sua iniziativa sui robotaxi, che comprende già GM, Mercedes e Toyota. Molte di queste nuove società continuano a utilizzare la piattaforma Drive Hyperion di Nvidia, insieme ai suoi modelli Alpamayo, per scalare l’addestramento sui veicoli di “livello 4”, o il livello più alto di guida automatizzata (un’auto a guida autonoma completamente funzionale che essenzialmente non ha indicazioni da parte dei passeggeri umani).

Edge AI e calcolo spaziale

Nvidia sta inoltre collaborando con T-Cell e Nokia per accelerare l’intelligenza artificiale fisica utilizzando la rete di accesso radio AI (AI-RAN) infrastrutture in località distant. L’azienda afferma che ciò potrebbe aiutare la raccolta di dati nel mondo reale per l’intelligenza artificiale fisica advert attraversare zone non connesse, isolate o sovraffollate utilizzando (ma senza interrompere) la connettività 5G.

“Trasformando la rete 5G in un laptop AI distribuito con T-Cell e Nokia, stiamo creando un progetto scalabile per l’infrastruttura AI all’avanguardia nel mondo”, ha affermato Huang nell’annuncio.

Il vantaggio dell’intelligenza artificiale edge è la bassa latenza: gli hub locali consentono alle informazioni di spostarsi più rapidamente rispetto a quando devono attraversare l’intera Web. La partnership di Nvidia utilizza l’infrastruttura esistente di T-Cell per supportarla per lo sviluppo dell’intelligenza artificiale fisica. La società ha affermato che le società di servizi pubblici e operative stanno già utilizzando agenti, sistemi e gemelli digitali di intelligenza artificiale fisica in questa infrastruttura per casi d’uso come l’ottimizzazione dei tempi dei semafori o la riparazione delle linee di trasmissione.

In un altro annuncioNvidia ha anche fatto un cenno allo house computing. La società ha affermato che le sue nuove piattaforme, tra cui Vera Rubin, stanno “aprendo una nuova period di innovazione spaziale, portando il calcolo dell’intelligenza artificiale nei information middle orbitali (ODC), nell’intelligenza geospaziale e nelle operazioni spaziali autonome”.

Inoltre: qual è il problema con l’intelligenza artificiale fisica? Perché la prossima frontiera della tecnologia è già intorno a te

Cosa significa in pratica: Nvidia è sulla buona strada per applicazioni AI in grado di operare tra la Terra e lo spazio, nonché tra spazio e spazio. Nvidia ha affermato che le sue piattaforme IGX ThorTM e Jetson OrinTM offrono l’inferenza advert alta efficienza energetica e l’elaborazione dei dati necessarie per fare qualsiasi cosa in orbita, ovvero l’intelligenza artificiale edge, che funziona come un hub locale nello spazio, al di fuori del cloud.

“Mentre dispieghiamo costellazioni di satelliti ed esploriamo più in profondità nello spazio, l’intelligenza deve vivere ovunque vengano generati i dati”, ha affermato Huang nel comunicato.

Ma i information middle orbitali sono ancora teorici: non impossibili, ma non ancora una realtà completa. Mentre le piattaforme IGX Thor e Jetson Orin di Nvidia sono disponibili oggi, il componente Vera Rubin Area-1 dell’iniziativa spaziale dell’azienda, annunciato oggi, sarà “disponibile in un secondo momento”.

Una nuova “fabbrica” per i dati fisici dell’intelligenza artificiale

L’intelligenza artificiale fisica risiede nella robotica, nei veicoli autonomi e in altre applicazioni del mondo reale, il che può comportare una posta in gioco più elevata se qualcosa va storto dal punto di vista meccanico o computazionale. È meglio evitare questo problema con dati di addestramento di alta qualità che preparino i sistemi fisici di intelligenza artificiale per quante più situazioni possibili per garantire che intraprendano azioni più sicure, più prevedibili e più efficaci.

Per accompagnare la sua attenzione all’intelligenza artificiale fisica, Nvidia ha anche annunciato il suo Bodily AI Knowledge Manufacturing unit Blueprint, una “architettura di riferimento aperta che unifica e automatizza il modo in cui i dati di addestramento vengono generati, aumentati e valutati, riducendo i costi, i tempi e la complessità dell’addestramento dei sistemi di intelligenza artificiale fisica su larga scala”.

Inoltre: perché acquistare Moltbook e OpenClaw potrebbe essere la scommessa più pericolosa di Massive Tech

Previsto per essere disponibile il prossimo mese su GitHub, Blueprint consente alle aziende di utilizzare la famiglia di modelli di base mondiale Cosmos di Nvidia per elaborare dati del mondo reale e generare dati sintetici su larga scala per addestrare sistemi di intelligenza artificiale fisici. Supporta inoltre processi di apprendimento e check per rinforzo per veicoli autonomi e altri sistemi fisici di intelligenza artificiale. Secondo Nvidia, Blueprint garantisce che i set di dati siano diversi includendo esempi sintetici di casi limite e altri scenari poco frequenti che sono più difficili o costosi da documentare nel mondo reale.

Anche se non sarà ampiamente disponibile fino advert aprile, Nvidia ha affermato che Uber sta già utilizzando Blueprint per sviluppare veicoli autonomi e Skild AI lo sta utilizzando per la robotica generica.

Il quadro generale

I progressi nell’intelligenza artificiale fisica hanno applicazioni di consumo, come le auto Waymo e i robotic virali per le faccende domestiche che probabilmente hai incontrato, ma sono immediatamente rilevanti per l’ingegneria industriale. Robotic più capaci e autonomi avranno il maggiore impatto sui nostri paesaggi pubblici e industriali: sulle strade, nelle fabbriche e, evidentemente, camminando nei parchi a tema.