Un sussurro. Qualche parola confusa. Per chi soffre di disartria, un disturbo del linguaggio motorio, la comunicazione di base rappresenta una sfida, che influenza indelebilmente sia la vita professionale che quella personale. Ma ora una nuova innovazione basata sull’intelligenza artificiale (AI) e sviluppata in India potrebbe cambiare la vita.

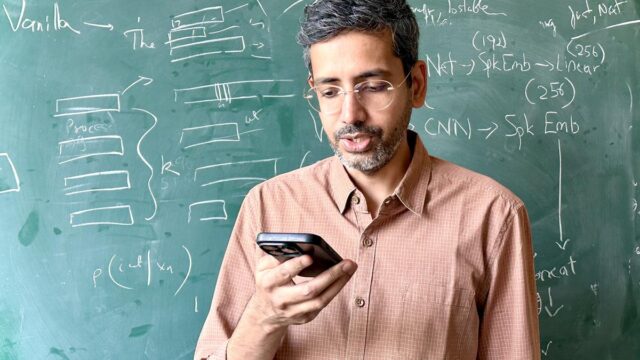

Guidato dal professore associato Vineet Gandhi dell’Istituto internazionale di tecnologia dell’informazione (IIIT), Hyderabad, un staff ha sviluppato una semplice app che può aiutare le persone a parlare mentre una traduzione audio converte la voce di chi parla quasi in tempo reale. L’app può convertire il parlato biascicato in un parlato chiaro e dal suono naturale oppure utilizzare una fotocamera per analizzare i movimenti delle labbra e le sottili vibrazioni della gola per generare un parlato intelligibile.

Sebbene l’attuale progetto sia in inglese, il prossimo obiettivo del staff è portare queste tecnologie nelle lingue regionali, tra cui hindi, telugu e tamil, poiché molte in tutto il paese non hanno i mezzi per beneficiare di modelli di intelligenza artificiale incentrati sull’accessibilità. Per questo lavoro, Gandhi ha vinto il premio Anusandhan Nationwide Analysis Basis (ANRF) nel 2026.

Estratti da un’intervista:

Cosa ti ha ispirato a iniziare a lavorare su questo progetto di intelligenza artificiale umanitaria?

La mia ricerca è sempre stata guidata da una semplice domanda: quale problema reale può aiutare a risolvere la tecnologia?

Sebbene la mia formazione accademica riguardi principalmente la visione artificiale, circa quattro anni fa ho iniziato a vedere emergere interessanti possibilità nella ricerca sul linguaggio e ho deciso di esplorare il campo più a fondo. Sono diventato sempre più consapevole delle sfide affrontate da molte persone che perdono la capacità di parlare a causa di condizioni mediche: l’impatto di questa perdita si estende ben oltre la comunicazione: influenza l’indipendenza, l’identità e la connessione.

Il riconoscimento di questa esigenza mi ha ispirato a concentrare il mio lavoro su tecnologie orientate all’accessibilità progettate per ripristinare o abilitare la parola, con l’obiettivo di aiutare le persone a ritrovare la propria voce.

Potresti descrivere come funziona l’app per le persone con problemi di linguaggio?

L’app è progettata per convertire il parlato compromesso o distorto in un parlato chiaro e dal suono naturale con solo poche centinaia di millisecondi di ritardo. Un utente parla semplicemente con la propria voce e il sistema la elabora per produrre un discorso comprensibile per l’ascoltatore.

Stiamo anche sviluppando una funzionalità complementare di sintesi vocale, in cui una persona può muovere silenziosamente le labbra e il sistema genera il discorso corrispondente.

Un aspetto chiave su cui ci stiamo concentrando è la personalizzazione, in cui gli utenti possono calibrare e perfezionare l’applicazione in base alla propria voce leggendo pochi minuti di testo sull’app.

Il nostro obiettivo è che queste tecnologie siano combine nelle piattaforme di comunicazione comuni, come le applicazioni di chiamata basate sul net, rendendo la comunicazione quotidiana più semplice per le persone con problemi di linguaggio.

Il tuo obiettivo è anche quello di espandere questa tecnologia alle lingue regionali indiane. Come speri di raggiungere questo obiettivo?

Al momento, gran parte dell’ecosistema globale della tecnologia vocale è progettato prevalentemente per l’inglese e i nostri esperimenti iniziali hanno naturalmente seguito la stessa traiettoria. Tuttavia, uno degli obiettivi principali della nostra ricerca è estendere queste capacità alle lingue regionali indiane, dove le tecnologie vocali accessibili sono altrettanto importanti.

Per raggiungere questo obiettivo, prevediamo di raccogliere dati vocali nelle lingue indiane e di sviluppare modelli efficienti in termini di dati adatti a scenari con risorse limitate. Il nostro approccio embrace l’aumento dei dati e un’efficiente messa a punto di modelli pre-addestrati.

Abbiamo già condotto esperimenti preliminari in hindi con risultati promettenti e, con il supporto della Anusandhan Nationwide Analysis Basis, miriamo a migliorare ed espandere ulteriormente questo lavoro advert altre lingue indiane.

Lei ritiene che “l’accessibilità e la diversità linguistica” siano cruciali per la ricerca sull’intelligenza artificiale in India. Potresti approfondire?

L’accessibilità e la diversità linguistica sono considerazioni fondamentali per la ricerca sull’intelligenza artificiale in India. Avendo trascorso diversi anni in Europa, ho osservato che lì l’accessibilità è integrata in modo molto più sistematico nelle infrastrutture pubbliche e nei servizi digitali.

Al contrario, l’India presenta ancora lacune significative, anche negli spazi pubblici come le stazioni ferroviarie, dove le disposizioni di base sull’accessibilità sono spesso limitate. Ciò evidenzia la più ampia necessità di progettare tecnologie che includano consapevolmente le persone con disabilità.

Allo stesso tempo, la diversità linguistica dell’India presenta un’altra dimensione importante. In molte parti del Paese, in particolare nelle regioni rurali, la parola rimane la modalità di interazione più naturale e primaria. Le interfacce ricche di testo o basate sulla digitazione potrebbero non essere sempre pratiche o inclusive in tali contesti. Pertanto, i sistemi di intelligenza artificiale progettati per l’India devono dare priorità all’interazione basata sul parlato e supportare più lingue regionali.

Nel loro insieme, un’accessibilità significativa e un forte sostegno alla diversità linguistica sono essenziali se si vuole che le tecnologie digitali siano veramente inclusive e ampiamente utilizzabili in tutto il Paese.

L’OMS ha affermato che “il futuro dell’assistenza sanitaria è digitale”…

L’Organizzazione Mondiale della Sanità ha sottolineato che il futuro dell’assistenza sanitaria sarà sempre più digitale. In un paese come l’India, la telemedicina può svolgere un ruolo trasformativo, in particolare se supportata da un’infrastruttura diagnostica di base a livello locale, che consente consultazioni distant più correct.

Un’altra direzione importante è la diagnostica assistita dall’intelligenza artificiale, in cui i sistemi di apprendimento automatico analizzano immagini mediche, discorsi o cartelle cliniche per supportare il rilevamento e la previsione precoce delle malattie.

Le soluzioni pratiche stanno già emergendo. Advert esempio, “Shishu Maapan” sviluppato da Wadhwani AI aiuta a misurare il peso e le dimensioni dei neonati semplicemente dalle foto del cellulare e viene adottato da operatori sanitari in prima linea come gli operatori ASHA.

Gli strumenti digitali stanno inoltre abilitando tecnologie sanitarie di assistenza, compresi sistemi di ripristino della parola per persone che hanno perso la capacità di parlare e dispositivi indossabili che monitorano continuamente i parametri sanitari e avvisano i medici di potenziali anomalie. Questi sviluppi illustrano come l’innovazione digitale può rendere l’assistenza sanitaria più accessibile e scalabile.

Una critica comune al parlato generato dall’intelligenza artificiale è che, sebbene sia intelligibile, spesso non riesce a catturare la cadenza unica di chi parla. Quando si restituisce la voce a qualcuno affetto da disartria, come si bilancia la necessità di una comunicazione chiara con la necessità di preservare l’essenza umana individuale dell’utente?

Questa è una preoccupazione importante. Se sono disponibili registrazioni della voce originale di chi parla prima dell’inizio della disartria, le moderne tecniche di clonazione vocale possono ricreare quella voce con soli 10 secondi di discorso. Quindi preservare l’identità vocale di un individuo è oggi tecnicamente fattibile, ed esistono ricerche sostanziali che dimostrano questa capacità. La nostra attuale app, invece, si concentra principalmente sul ripristino dell’intelligibilità dei contenuti, garantendo che ciò che l’utente intende dire venga trasmesso in modo chiaro. Per ora, il discorso generato utilizza una voce comune piuttosto che personalizzata.

Detto questo, i sistemi di sintesi vocale stanno diventando sempre più naturali, al punto che vengono ora integrati in robotic conversazionali che sostituiscono molte tradizionali applicazioni di servizio clienti. La sfumatura emotiva rimane più impegnativa, come abbiamo discusso nel nostro precedente lavoro sulla generazione del linguaggio empatico, ma i progressi sono rapidi.

In che modo il modello distingue tra disturbi del linguaggio e uno sfondo rumoroso mentre l’utente percorre, advert esempio, una trafficata strada indiana?

Questa è davvero una sfida significativa in India, dove gli ambienti del mondo reale possono essere estremamente caotici. Chiunque abbia pensato di implementare qui auto a guida autonoma si rende presto conto di quanto possano essere imprevedibili le nostre strade: schemi di traffico, suoni del clacson, pedoni e veicoli interagiscono tutti in modi altamente dinamici. La tecnologia vocale deve affrontare un livello simile di complessità.

Nei nostri esperimenti, miglioriamo la robustezza utilizzando l’aumento del rumore, in cui simuliamo diversi ambienti rumorosi durante l’addestramento in modo che il modello impari a gestire i suoni di sottofondo. In definitiva, la soluzione più efficace è raccogliere ed eseguire l’addestramento su più dati reali provenienti da ambienti rumorosi. Anche in questo caso, un certo degrado delle prestazioni è inevitabile perché separare il parlato compromesso dal forte rumore di fondo è fondamentalmente un problema difficile.

divya.gandhi@thehindu.co.in