Negli ultimi due anni, le aziende che valutano modelli open-weight si sono trovate advert affrontare un difficile compromesso. La linea Gemma di Google ha costantemente fornito ottime prestazioni, ma la sua licenza personalizzata – con restrizioni di utilizzo e termini che Google poteva aggiornare a piacimento – ha spinto molti group verso Mistral o Qwen di Alibaba. La revisione legale ha aggiunto attrito. I group di conformità hanno segnalato i casi limite. E per quanto capace fosse Gemma 3, “aperto” con gli asterischi non è la stessa cosa di aperto.

Gemma 4 elimina completamente quell’attrito. La nuova famiglia di modelli aperti di Google DeepMind viene fornita secondo uno normal Licenza Apache 2.0 – gli stessi termini permissivi usati da Qwen, Mistral, Arcee e dalla maggior parte dell’ecosistema a peso aperto.

Nessuna clausola personalizzata, nessuna clausola di “Uso Dannoso” che richieda un’interpretazione legale, nessuna restrizione sulla ridistribuzione o sull’implementazione commerciale. Per i group aziendali che aspettavano che Google giocasse con gli stessi termini di licenza del resto del settore, l’attesa è finita.

Il tempismo è notevole. Mentre alcuni laboratori cinesi di intelligenza artificiale (in particolare gli ultimi modelli Qwen di Alibaba, Qwen3.5 Omni e Qwen 3.6 Plus) hanno iniziato a ritirarsi dalle versioni completamente aperte per i loro ultimi modelli, Google si sta muovendo nella direzione opposta, aprendo la sua versione Gemma più potente di sempre, affermando esplicitamente che l’architettura trae spunto dalla sua versione commerciale. Gemelli 3 ricerca.

Quattro modelli, due livelli: da Edge a workstation in un’unica famiglia

Gemma 4 arriva come quattro modelli distinti organizzati in due livelli di distribuzione. Il livello “workstation” embrace a Modello denso con parametri 31B e un 26B A4B Modello misto di esperti – supportano sia l’enter di testo che di immagini con finestre di contesto di token da 256K. Il livello “edge” è costituito da E2B E E4Bmodelli compatti progettati per telefoni, dispositivi incorporati e laptop computer, che supportano testo, immagini e audio con finestre di contesto token da 128K.

La convenzione di denominazione richiede un po’ di disimballaggio. Il prefisso “E” denota “parametri effettivi”: l’E2B ha 2,3 miliardi di parametri effettivi ma 5,1 miliardi in totale, perché ogni livello di decodificazione trasporta la propria piccola tabella di incorporamento attraverso una tecnica chiamata Google Incorporamenti per livello (PLE). Queste tabelle sono grandi su disco ma economiche da calcolare, motivo per cui il modello funziona come un 2B pur pesando tecnicamente di più.

La “A” in 26B A4B sta per “parametri attivi”: solo 3,8 miliardi dei 25,2 miliardi di parametri totali del modello MoE si attivano durante l’inferenza, il che significa che fornisce circa intelligenza di classe 26B con costi di calcolo paragonabili a un modello 4B.

Per i chief IT che dimensionano i requisiti GPU, ciò si traduce direttamente in flessibilità di implementazione. Il modello MoE può essere eseguito su GPU di livello client e dovrebbe apparire rapidamente in strumenti come Ollama e LM Studio. Il modello denso 31B richiede più margine (si pensi a una NVIDIA H100 o RTX 6000 Professional per inferenza non quantizzata), ma anche Google sta distribuendo Punti di controllo della formazione consapevole della quantizzazione (QAT). per mantenere la qualità con una precisione inferiore. Su Google Cloud, entrambi i modelli di workstation possono ora essere eseguiti in una configurazione completamente serverless tramite Corsa sulle nuvole con GPU NVIDIA RTX Professional 6000, che scende a zero quando è inattivo.

La scommessa del Ministero: 128 piccoli esperti per risparmiare sui costi di inferenza

Le scelte architetturali all’interno del modello 26B A4B meritano particolare attenzione da parte dei group che valutano l’economia dell’inferenza. Invece di seguire il modello dei recenti modelli del MoE che utilizzano una manciata di grandi esperti, Google ha optato per questo 128 piccoli espertiattivandone otto per token più un esperto sempre attivo condiviso. Il risultato è un modello che confronta in modo competitivo con modelli densi nell’intervallo 27B-31B mentre funziona all’incirca alla velocità di un modello 4B durante l’inferenza.

Questa non è solo una curiosità di riferimento: influisce direttamente sui costi di servizio. Un modello che fornisce un ragionamento di classe 27B con un throughput di classe 4B significa meno GPU, minore latenza e inferenza per token più economica in produzione. Per le organizzazioni che utilizzano assistenti di codifica, pipeline di elaborazione dei documenti o flussi di lavoro con agenti multi-turno, la variante MoE potrebbe essere la scelta più pratica della famiglia.

Entrambi i modelli di workstation utilizzano a Meccanismo di attenzione ibrida che intercala l’attenzione locale della finestra scorrevole con l’attenzione globale completa, con lo strato finale sempre globale. Questo design abilita la finestra di contesto da 256 KB mantenendo gestibile il consumo di memoria: una considerazione importante per i group che elaborano documenti lunghi, basi di codice o conversazioni con agenti a più turni.

Multimodalità nativa: visione, audio e chiamate di funzioni combine da zero

Le generazioni precedenti di modelli aperti in genere trattavano la multimodalità come un componente aggiuntivo. I codificatori di visione sono stati imbullonati alle dorsali del testo. L’audio richiedeva una pipeline ASR esterna come Whisper. La chiamata di funzione si basava su una progettazione tempestiva e sulla speranza che il modello cooperasse. Gemma 4 integra tutte queste funzionalità a livello di architettura.

Tutti e quattro i modelli gestiscono enter di immagine con proporzioni variabili con funds di token visivi configurabili: un miglioramento significativo rispetto al vecchio codificatore di visione di Gemma 3n, che aveva difficoltà con l’OCR e la comprensione dei documenti. Il nuovo codificatore supporta funds da 70 a 1.120 token per immagine, consentendo agli sviluppatori di bilanciare i dettagli con il calcolo a seconda dell’attività.

Funds inferiori funzionano per la classificazione e i sottotitoli; funds più elevati gestiscono l’OCR, l’analisi dei documenti e l’analisi visiva dettagliata. L’enter multiimmagine e video (elaborati come sequenze di fotogrammi) è supportato in modo nativo, consentendo il ragionamento visivo su più documenti o schermate.

I due modelli edge si aggiungono elaborazione audio nativa – riconoscimento vocale automatico e conversione della voce in testo tradotto, tutto sul dispositivo. Il codificatore audio è stato compresso a 305 milioni di parametri, rispetto ai 681 milioni di Gemma 3n, mentre la durata del body è scesa da 160 ms a 40 ms per una trascrizione più reattiva. Per i group che creano applicazioni voice-first che devono mantenere i dati locali (si pensi all’assistenza sanitaria, all’assistenza sul campo o all’interazione multilingue con i clienti), eseguire ASR, traduzione, ragionamento e chiamate di funzioni in un unico modello su un telefono o dispositivo edge rappresenta una vera semplificazione dell’architettura.

Chiamata di funzione è anche nativo in tutti e quattro i modelli, attingendo alla ricerca di Google FunzioneGemma rilasciato alla effective dello scorso anno. A differenza degli approcci precedenti che si basavano sul seguire le istruzioni per convincere i modelli a utilizzare strumenti strutturati, la chiamata di funzioni di Gemma 4 è stata addestrata nel modello da zero, ottimizzata per flussi di agenti multi-turno con più strumenti. Ciò emerge dai benchmark degli agenti ma, cosa ancora più importante, riduce il sovraccarico di progettazione tempestiva che i group aziendali in genere investono quando creano agenti che utilizzano strumenti.

Benchmark nel contesto: dove Gemma 4 atterra in un campo affollato

I numeri di riferimento raccontano una chiara storia di miglioramento generazionale. Il modello denso 31B ottiene punteggi 89,2% su AIME 2026 (un rigoroso take a look at di ragionamento matematico), 80,0% su LiveCodeBench v6e colpisce a Codeforce ELO di 2.150 – numeri che non molto tempo fa sarebbero stati di prima classe rispetto ai modelli proprietari. Sulla visione, MMMU Professional raggiunge il 76,9% e MATH-Imaginative and prescient raggiunge l’85,6%.

Per fare un confronto, Gemma 3 27B ha ottenuto il 20,8% su AIME e il 29,1% su LiveCodeBench senza modalità di pensiero.

Il modello MoE segue da vicino: 88,3% su AIME 2026, 77,1% su LiveCodeBench e 82,3% su GPQA Diamond, un punto di riferimento per il ragionamento scientifico a livello di laurea. Il divario prestazionale tra il MoE e le varianti dense è modesto, dato il significativo vantaggio in termini di costi di inferenza dell’architettura MoE.

I modelli edge superano la loro classe di peso. L’E4B raggiunge il 42,5% su AIME 2026 e il 52,0% su LiveCodeBench: un valore elevato per un modello che funziona su una GPU T4. L’E2B, ancora più piccola, gestisce rispettivamente il 37,5% e il 44,0%. Entrambi superano significativamente il Gemma 3 27B (senza pensarci) sulla maggior parte dei benchmark nonostante siano una frazione delle dimensioni, grazie alla capacità di ragionamento integrata.

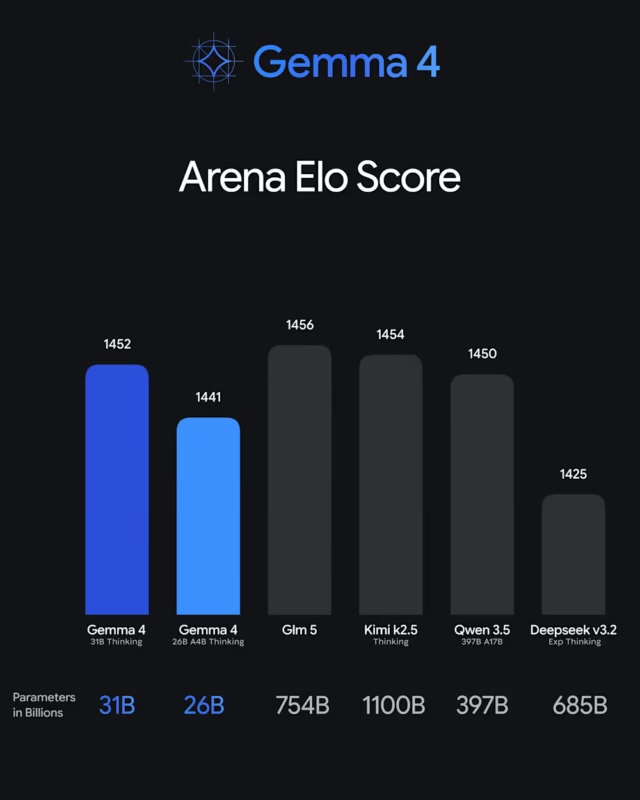

Questi numeri devono essere letti nel contesto di un panorama a peso aperto sempre più competitivo. Qwen 3.5, GLM-5 e Kimi K2.5 competono tutti in modo aggressivo in questo intervallo di parametri e il campo si muove velocemente. Ciò che distingue Gemma 4 non è tanto un singolo benchmark quanto più la combinazione: ragionamento forte, multimodalità nativa tra testo, visione e audio, chiamata di funzioni, contesto 256K e una licenza veramente permissiva, il tutto in un’unica famiglia di modelli con opzioni di implementazione da dispositivi edge al cloud serverless.

A cosa dovrebbero prestare attenzione i group aziendali in seguito

Google sta rilasciando sia modelli base pre-addestrati che varianti ottimizzate per le istruzioni, il che è importante per le organizzazioni che intendono perfezionarle per domini specifici. I modelli base Gemma sono stati storicamente solide basi per la formazione personalizzata e la licenza Apache 2.0 ora rimuove qualsiasi ambiguità sulla possibilità di distribuire commercialmente i derivati ottimizzati.

Vale la pena considerare l’opzione di distribuzione serverless tramite Cloud Run con supporto GPU per i group che necessitano di una capacità di inferenza scalabile fino a zero. Pagare solo per il calcolo effettivo durante l’inferenza, anziché mantenere le istanze GPU sempre attive, potrebbe cambiare in modo significativo l’economia dell’implementazione di modelli aperti in produzione, in particolare per strumenti interni e applicazioni a traffico ridotto.

Google ha lasciato intendere che questa potrebbe non essere la famiglia Gemma 4 completa, con ulteriori dimensioni di modelli che probabilmente seguiranno. Ma la combinazione oggi disponibile (modelli di ragionamento di classe workstation e modelli multimodali di classe edge, tutti sotto Apache 2.0, tutti ricavati dalla ricerca Gemini 3) rappresenta la versione di modello aperto più completa che Google abbia fornito. Per i group aziendali che aspettavano che i modelli aperti di Google competessero sui termini di licenza e sulle prestazioni, la valutazione può finalmente iniziare senza prima rivolgersi all’ufficio legale.