L’uomo antropico non può manipolare Claude, il suo modello di intelligenza artificiale generativa una volta che l’esercito americano lo avrà messo in funzione, ha scritto venerdì un dirigente in una dichiarazione in tribunale. La dichiarazione è stata fatta in risposta alle accuse dell’amministrazione Trump secondo cui la società avrebbe potenzialmente manomesso i suoi strumenti di intelligenza artificiale durante la guerra.

“Anthropic non ha mai avuto la capacità di far sì che Claude smettesse di funzionare, alterasse la sua funzionalità, bloccasse l’accesso o influenzasse in altro modo o mettesse in pericolo le operazioni militari”, Thiyagu Ramasamy, capo del settore pubblico di Anthropic, ha scritto. “Anthropic non ha l’accesso necessario per disabilitare la tecnologia o alterare il comportamento del modello prima o durante le operazioni in corso.”

Il Pentagono ha discusso per mesi con il principale laboratorio di intelligenza artificiale su come la sua tecnologia possa essere utilizzata per la sicurezza nazionale e quali dovrebbero essere i limiti a story utilizzo. Questo mese, il segretario alla Difesa Pete Hegseth ha etichettato Anthropic come un rischio per la catena di fornitura, una designazione che impedirà al Dipartimento della Difesa di utilizzare il software program dell’azienda, anche tramite appaltatori, nei prossimi mesi. Anche altre agenzie federali stanno abbandonando Claude.

Anthropic ha intentato due azioni legali contestando la costituzionalità del divieto e sta cercando un ordine di emergenza per annullarlo. Tuttavia, i clienti hanno già iniziato advert annullare le offerte. L’udienza su uno dei casi è prevista per il 24 marzo presso il tribunale distrettuale federale di San Francisco. Subito dopo il giudice potrebbe decidere per un temporaneo ribaltamento.

In un documento presentato all’inizio di questa settimana, gli avvocati del governo hanno scritto che il Dipartimento della Difesa “non è tenuto a tollerare il rischio che i sistemi militari critici vengano messi a repentaglio in momenti cruciali per la difesa nazionale e le operazioni militari attive”.

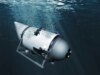

Il Pentagono ha utilizzato Claude per analizzare dati, scrivere promemoria e aiutare a generare piani di battaglia, ha riferito WIRED. La tesi del governo è che Anthropic potrebbe interrompere le operazioni militari attive disattivando l’accesso a Claude o pubblicando aggiornamenti dannosi se l’azienda disapprova determinati usi.

Ramasamy ha rifiutato questa possibilità. “Anthropic non mantiene alcuna backdoor o ‘kill swap’ remoto”, ha scritto. “Il personale antropico non può, advert esempio, accedere a un sistema DoW per modificare o disabilitare i modelli durante un’operazione; la tecnologia semplicemente non funziona in questo modo”.

Ha continuato dicendo che Anthropic sarebbe in grado di fornire aggiornamenti solo con l’approvazione del governo e del suo fornitore di servizi cloud, in questo caso Amazon Net Companies, anche se non ne ha specificato il nome. Ramasamy ha aggiunto che Anthropic non può accedere ai immediate o advert altri dati che gli utenti militari inseriscono in Claude.

I dirigenti di Anthropic sostengono in tribunale che la società non vuole il potere di veto sulle decisioni tattiche militari. Sarah Heck, responsabile delle politiche, ha scritto venerdì, in una dichiarazione del tribunale, si affermava che Anthropic period disposta a garantire altrettanto in un contratto proposto il 4 marzo. “A scanso di equivoci, [Anthropic] comprende che questa licenza non garantisce né conferisce alcun diritto di controllo o di veto sul legittimo processo decisionale operativo del Dipartimento della Guerra”, afferma la proposta, secondo il documento, che fa riferimento a un nome alternativo per il Pentagono.

L’azienda period anche pronta advert accettare un linguaggio che rispondesse alle sue preoccupazioni riguardo all’utilizzo di Claude per contribuire a effettuare attacchi mortali senza supervisione umana, ha affermato Heck. Ma le trattative alla high-quality si sono interrotte.

Per ora, il Dipartimento della Difesa ha detto nelle dichiarazioni in tribunale si afferma che “sta adottando misure aggiuntive per mitigare il rischio della catena di fornitura” posto dall’azienda “collaborando con fornitori di servizi cloud di terze parti per garantire che la management di Anthropic non possa apportare modifiche unilaterali” ai sistemi Claude attualmente in uso.