Il produttore cinese di elettronica e automobili Xiaomi ha sorpreso oggi la comunità globale dell’intelligenza artificiale il rilascio di MiMo-V2-Proun nuovo modello di base da mille miliardi di parametri con parametri di riferimento che si avvicinano a quelli dei giganti statunitensi dell’intelligenza artificiale OpenAI e Anthropic, ma a circa un settimo o un sesto del costo in caso di accesso tramite API proprietaria e, cosa importante, con l’invio di informazioni per un valore inferiore a 256.000 token avanti e indietro.

Guidato da Fuli Luo, un veterano del dirompente progetto DeepSeek R1, il rilascio rappresenta ciò che Luo definisce un “tranquillo agguato” alla frontiera globale. Inoltre, Luo ha dichiarato in un X posta che l’azienda prevede di rendere open supply una variante del modello da quest’ultima versione, “quando i modelli saranno abbastanza stabili da meritarselo”.

Concentrandosi sullo “spazio d’azione” dell’intelligenza, passando dalla generazione di codice al funzionamento autonomo degli “artigli” digitali, Xiaomi sta tentando di scavalcare completamente il paradigma conversazionale.

Prima di questa incursione nell’intelligenza artificiale di frontiera, Xiaomi, con sede a Pechino, si period affermata come un titano dell'”Web delle cose” e dell'{hardware} di consumo.

Riconosciuto a livello globale come il terzo produttore di smartphone al mondo, Xiaomi ha trascorso i primi anni del 2020 effettuando un ingresso advert alto rischio nel settore automobilistico. I suoi veicoli elettrici (EV), come il SU7 e il SUV YU7 lanciato di recente, hanno trasformato l’azienda in una centrale elettrica integrata verticalmente in grado di unire {hardware}, software program e, ora, ragionamenti avanzati.

Questo pedigree nell’ingegneria del mondo fisico informa l’architettura di MiMo-V2-Professional; è costruito per essere il “cervello” di sistemi complessi, indipendentemente dal fatto che tali sistemi gestiscano catene di approvvigionamento globali o si muovano tra le intricate impalcature di un agente di codifica autonomo.

Tecnologia: l’architettura dell’agenzia

La sfida principale dell'”period degli agenti” è mantenere un ragionamento advert alta fedeltà su enormi quantità di dati senza incorrere in una proibitiva “tassa di intelligence” in termini di latenza o costi. MiMo-V2-Professional risolve questo problema attraverso un’architettura sparsa: mentre ospita 1T parametri totali, solo 42B sono attivi durante ogni singolo passaggio in avanti, rendendolo circa tre volte più grande del suo predecessore, MiMo-V2-Flash.

L’efficienza del modello è radicata in un meccanismo evoluto di attenzione ibrida. I trasformatori normal in genere devono affrontare un aumento quadratico dei requisiti di elaborazione man mano che il contesto cresce; MiMo-V2-Professional utilizza un rapporto ibrido 7:1 (aumentato da 5:1 nella versione Flash) per gestire la sua enorme finestra di contesto di token da 1 milione. Questa scelta architetturale consente al modello di mantenere una profonda “memoria” delle attività di lunga durata senza il degrado delle prestazioni solitamente riscontrato nei modelli di frontiera.

L’analogia: pensa al modello non come uno studente che legge un libro pagina per pagina, ma come un ricercatore esperto in una vasta biblioteca. Il rapporto 7:1 consente al modello di “scremare” l’85% dei dati per contestualizzarli, applicando al contempo un’attenzione advert alta densità al 15% più rilevante per l’attività da svolgere.

Questo è abbinato a un leggero livello Multi-Token Prediction (MTP), che consente al modello di anticipare e generare più token contemporaneamente, riducendo drasticamente la latenza richiesta per le fasi di “pensiero” dei flussi di lavoro degli agenti. Secondo Luo, queste decisioni strutturali sono state prese con mesi di anticipo, specificamente per fornire un “vantaggio strutturale” per la velocità inaspettata con cui il settore si è spostato verso gli agenti.

Prodotto e benchmarking: un controllo della realtà da parte di terzi

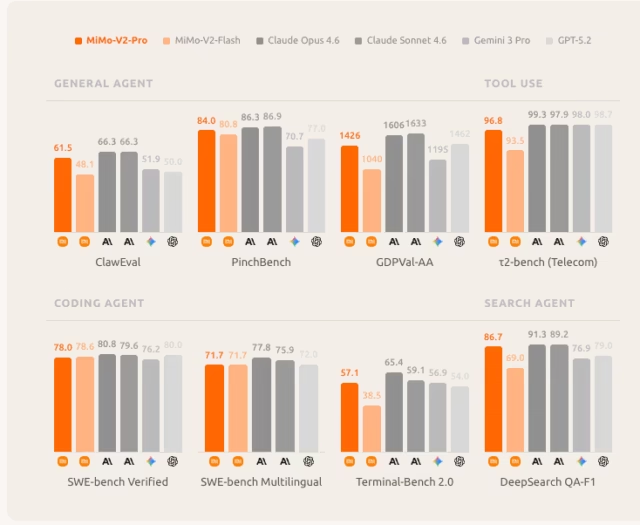

I dati interni di Xiaomi dipingono l’immagine di un modello che eccelle nelle attività del “mondo reale” rispetto ai benchmark sintetici. Su GDPval-AA, un benchmark che misura le prestazioni nelle attività lavorative degli agenti nel mondo reale, MiMo-V2-Professional ha ottenuto un Elo di 1426, posizionandolo davanti a importanti concorrenti cinesi come GLM-5 (1406) e Kimi K2.5 (1283).

Sebbene sia ancora dietro ai modelli occidentali “maxeffort” come Claude Sonnet 4.6 (1633) in Elo grezzo, rappresenta la prestazione più alta registrata per un modello di origine cinese in questa categoria.

L’organizzazione di benchmarking di terze parti L’analisi artificiale ha verificato queste affermazioniposizionando MiMo-V2-Professional al 10° posto nel suo indice di intelligence globale con un punteggio di 49. Questo lo colloca allo stesso livello del Codex GPT-5.2 e davanti a Grok 4.20 Beta. Questi risultati suggeriscono che Xiaomi ha costruito con successo un modello capace del ragionamento di alto livello richiesto per le attività di ingegneria e produzione.

I parametri chiave di Synthetic Evaluation evidenziano un salto significativo rispetto alla precedente versione a pesi aperti, MiMo-V2-Flash (che ha ottenuto 41):

-

Tasso di allucinazioni: Il modello Professional ha ridotto i tassi di allucinazioni al 30%, un netto miglioramento rispetto al 48% del modello Flash.

-

Indice di onniscienza: Ha segnato un +5, piazzandosi davanti a GLM-5 (+2) e Kimi K2.5 (-8).

-

Efficienza dei token: Per eseguire l’intero Intelligence Index, MiMo-V2-Professional ha richiesto solo 77 milioni di token di output, significativamente meno di GLM-5 (109 milioni) o Kimi K2.5 (89 milioni), indicando un processo di ragionamento più conciso ed efficiente.

I grafici di Xiaomi sottolineano ulteriormente le sue capacità di “Agente generale” e “Agente di codifica”. Su ClawEval, un punto di riferimento per gli scaffold advert agenti, il modello ha ottenuto 61,5, avvicinandosi alle prestazioni di Claude Opus 4.6 (66,3) e superando significativamente GPT-5.2 (50,0). In ambienti specifici di codifica come Terminal-Bench 2.0, ha raggiunto un 86,7, suggerendo un’elevata affidabilità durante l’esecuzione di comandi in un ambiente terminale stay.

Come le aziende dovrebbero valutare l’utilizzo di MiMo-V2-Professional

Per i personaggi delineati nelle organizzazioni contemporanee di intelligenza artificiale, dall’infrastruttura alla sicurezza, MiMo-V2-Professional rappresenta un cambio di paradigma nella curva “Prezzo-Qualità”.

I decisori delle infrastrutture troveranno MiMo-V2-Professional un candidato interessante per la frontiera paretiana di intelligenza e costo. Synthetic Evaluation ha riferito che l’esecuzione del proprio indice costa solo $ 348 per MiMo-V2-Professional, rispetto a $ 2.304 per GPT-5.2 e $ 2.486 per Claude Opus 4.6.

Per le organizzazioni che gestiscono cluster GPU o approvvigionamento, la possibilità di accedere alle prime 10 informazioni globali a circa 1/7 del costo degli operatori storici occidentali è un potente incentivo per i take a look at su scala di produzione.

I decisori relativi ai dati possono sfruttare la finestra di contesto 1M per architetture predisposte per RAG, consentendo loro di alimentare intere basi di codici aziendali o set di documentazione in un unico immediate senza la frammentazione richiesta da modelli di contesto più piccoli.

Un decisore di sistemi/orchestrazione dovrebbe valutare MiMo-V2-Professional come un “cervello” primario per il coordinamento multi-agente. Poiché il modello è ottimizzato per OpenClaw e Claude Code, può gestire la pianificazione a lungo orizzonte e l’uso preciso degli strumenti senza il costante intervento umano che affligge i modelli precedenti.

Il suo alto posizionamento in GDPval-AA suggerisce che è particolarmente adatto per il flusso di lavoro e il livello di orchestrazione necessari per scalare l’intelligenza artificiale in tutta l’azienda. Consente la creazione di sistemi in grado di andare oltre la semplice automazione verso la risoluzione di problemi complessi e in più fasi.

Tuttavia, i decisori in materia di sicurezza devono prestare attenzione. La natura stessa “agente” che rende il modello potente – la sua capacità di utilizzare terminali e manipolare file – aumenta la superficie per l’inserimento tempestivo e l’accesso non autorizzato al modello.

Sebbene il suo basso tasso di allucinazioni (30%) sia un vantaggio difensivo, la mancanza di pesi pubblici (a differenza della versione Flash) significa che i staff di sicurezza interni non possono eseguire i controlli approfonditi “a livello di modello” talvolta richiesti per implementazioni altamente sensibili. Qualsiasi implementazione aziendale deve essere accompagnata da robusti protocolli di monitoraggio e verificabilità.

Prezzi, disponibilità e percorso da seguire

Xiaomi ha fissato il prezzo del MiMo-V2-Professional per dominare il mercato degli sviluppatori. Il prezzo è suddiviso in livelli in base all’utilizzo del contesto, con tariffe aggressive per la memorizzazione nella cache per supportare attività di ragionamento advert alta frequenza.

-

MiMo-V2-Professional (fino a 256K): $ 1 per 1 milione di token di enter e $ 3 per 1 milione di token di output

-

MiMo-V2-Professional (256K-1M): $ 2 per 1 milione di token di enter e $ 6 per 1 milione di token di output

-

Lettura della cache: $ 0,20 per 1 milione di token per il livello inferiore e $ 0,40 per il livello superiore

-

Scrittura cache: Temporaneamente gratuito ($ 0)

Ecco come si confronta con gli altri principali modelli di frontiera in tutto il mondo:

Questo posizionamento aggressivo è progettato per incoraggiare i flussi applicativi advert alta intensità che definiscono la prossima generazione di software program. Il modello è attualmente disponibile solo tramite l’API proprietaria di Xiaomi, senza supporto attuale per immagini o enter multimodale, un’omissione notevole in un’period di modelli “Omni”, sebbene Xiaomi abbia preso in giro un MiMo-V2-Omni separato per tali esigenze.

Il periodo “Hunter Alpha” su OpenRouter ha dimostrato che il mercato ha un grande appetito per questa specifica combinazione di efficienza e ragionamento. La filosofia di Fuli Luo – secondo cui la velocità della ricerca è alimentata da un “genuino amore per il mondo per cui si sta costruendo” – ha prodotto un modello che si colloca al 2° posto in Cina e all’8° a livello mondiale secondo indici di intelligence consolidati.

Se rimarrà un’imboscata “tranquilla” o diventerà la base per un riallineamento globale del potere dell’IA dipende dalla rapidità con cui gli sviluppatori adotteranno lo “spazio di azione” rispetto alla “finestra di chat”. Per ora Xiaomi ha spostato i paletti: la domanda non è più solo “può parlare?” ma “può agire?”