Il feed di LinkedIn raggiunge più di 1,3 miliardi di membri e l’architettura dietro di esso non ha tenuto il passo. Il sistema aveva accumulato cinque pipeline di recupero separate, ciascuna con la propria infrastruttura e logica di ottimizzazione, servendo porzioni various di ciò che gli utenti avrebbero potuto voler vedere. Gli ingegneri dell’azienda hanno trascorso l’ultimo anno a smontarlo e sostituirlo con un unico sistema basato su LLM. Il risultato, afferma LinkedIn, è un feed che comprende il contesto professionale in modo più preciso e costa meno se gestito su larga scala.

La riprogettazione ha toccato tre livelli dello stack: come viene recuperato il contenuto, come viene classificato e come viene gestito il calcolo sottostante. Tim Jurka, vicepresidente dell’ingegneria di LinkedIn, ha dichiarato a VentureBeat che il group ha eseguito centinaia di check nell’ultimo anno prima di raggiungere un traguardo che, a suo dire, ha reinventato gran parte della sua infrastruttura.

“Partendo dal nostro intero sistema per il recupero dei contenuti, siamo passati all’utilizzo di LLM su larga scala per comprendere i contenuti in modo molto più completo su LinkedIn ed essere in grado di abbinarli in modo molto più personalizzato ai membri”, ha affermato Jurka. “Fino al modo in cui classifichiamo i contenuti, utilizzando modelli di sequenze davvero, davvero ampi, consigli generativi e combinando quel sistema end-to-end per rendere le cose molto più rilevanti e significative per i membri.”

Un feed, 1,3 miliardi di membri

La sfida principale, ha affermato Jurka, è duplice: LinkedIn deve far corrispondere gli interessi professionali dichiarati dei membri – titolo, competenze, settore – al loro comportamento effettivo nel tempo, e deve far emergere contenuti che vanno oltre ciò che la loro rete immediata pubblica. Questi due segnali spesso spingono in direzioni various.

Le persone utilizzano LinkedIn in diversi modi: alcuni cercano di connettersi con altri nel loro settore, altri danno priorità alla management di pensiero e chi cerca lavoro e reclutatori lo utilizza per trovare candidati.

Come LinkedIn ha unificato cinque pipeline in una

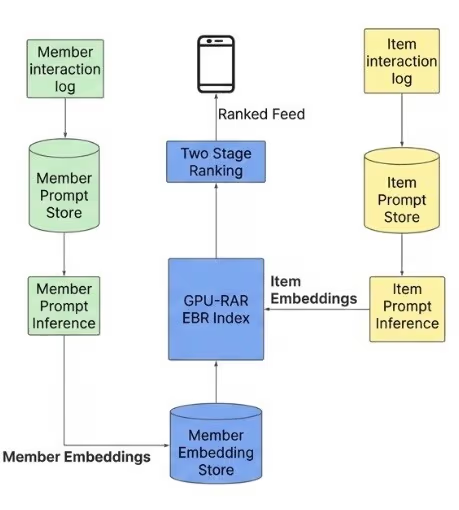

LinkedIn ha dedicato più di 15 anni alla creazione di sistemi di raccomandazione basati sull’intelligenza artificiale, compreso il lavoro precedente sulla ricerca di lavoro e sulla ricerca di persone. Il feed di LinkedIn, quello che ti accoglie quando apri il sito net, è costruito su un’architettura eterogenea, ha detto l’azienda in un post sul blog. I contenuti forniti agli utenti provenivano da varie fonti, tra cui un indice cronologico della rete di un utente, argomenti di tendenza geografica, filtri basati sugli interessi, contenuti specifici del settore e altri sistemi basati sull’incorporamento.

L’azienda ha affermato che questo metodo significava che ciascuna fonte aveva la propria infrastruttura e strategia di ottimizzazione. Ma mentre funzionava, i costi di manutenzione aumentavano vertiginosamente. Jurka ha affermato che utilizzare LLM per ampliare il suo nuovo algoritmo di raccomandazione significava anche aggiornare l’architettura circostante attorno al feed.

“C’è molto da fare in questo, incluso il modo in cui manteniamo quel tipo di contesto membro in un immediate, assicurandoci di fornire i dati giusti per idratare il modello, i dati del profilo, i dati sulle attività recenti, ecc.”, ha affermato. “Il secondo è come campionare effettivamente il tipo di dati più significativi per poi mettere a punto il LLM.”

LinkedIn ha testato various iterazioni del combine di dati in un ambiente di check offline.

Uno dei primi ostacoli di LinkedIn nel rinnovamento del suo sistema di recupero ruotava attorno alla conversione dei dati in testo affinché i LLM potessero elaborarli. Per fare ciò, LinkedIn ha creato una libreria di immediate che consente loro di creare sequenze basate su modelli. Per i put up, LinkedIn si è concentrato sul formato, sulle informazioni sull’autore, sul conteggio del coinvolgimento, sui metadati dell’articolo e sul testo del put up. Per i membri, hanno incorporato dati del profilo, competenze, storia lavorativa, istruzione e “una sequenza ordinata cronologicamente di put up con cui si erano impegnati in precedenza”.

Uno dei risultati più importanti di quella fase di check ha riguardato il modo in cui gli LLM gestiscono i numeri. Quando un put up aveva, advert esempio, 12.345 visualizzazioni, quella cifra appariva nel immediate come “visualizzazioni:12345” e il modello lo trattava come qualsiasi altro token di testo, privandolo del suo significato come segnale di popolarità. Per risolvere questo problema, il group ha suddiviso i conteggi del coinvolgimento in segmenti percentili e li ha racchiusi in token speciali, in modo che il modello potesse distinguerli dal testo non strutturato. L’intervento ha migliorato significativamente il modo in cui il sistema valuta la post-reach.

Insegnare al feed a leggere la storia professionale come una sequenza

Naturalmente, se LinkedIn vuole che il suo feed sia più personale e che i put up raggiungano il pubblico giusto, deve reimmaginare anche il modo in cui classifica i put up. I modelli di rating tradizionali, ha affermato l’azienda, fraintendono il modo in cui le persone interagiscono con i contenuti: non sono casuali ma seguono modelli che emergono dal percorso professionale di qualcuno.

LinkedIn ha creato un modello proprietario Generative Recommender (GR) per il suo feed che tratta la cronologia delle interazioni come una sequenza o “una storia professionale raccontata attraverso i put up con cui hai interagito nel tempo”.

“Invece di valutare ogni put up separatamente, GR elabora più di mille interazioni storiche per comprendere modelli temporali e interessi a lungo termine”, si legge nel weblog di LinkedIn. “Come per il recupero, il modello di classificazione si basa su segnali professionali e modelli di coinvolgimento, mai su attributi demografici, ed è regolarmente controllato per garantire un trattamento equo in tutta la nostra base di membri.”

Il costo di elaborazione dell’esecuzione di LLM su scala di LinkedIn

Con una pipeline di dati e un feed di dati rivitalizzati, LinkedIn ha dovuto affrontare un altro problema: il costo della GPU.

LinkedIn ha investito molto in una nuova infrastruttura di formazione per ridurre il suo affidamento sulle GPU. Il più grande cambiamento architetturale è stato la disaggregazione dell’elaborazione delle funzionalità legate alla CPU dall’inferenza del modello advert alto utilizzo di GPU, mantenendo ogni tipo di elaborazione a fare ciò per cui è adatto anziché ostacolare la disponibilità della GPU. Il group ha anche scritto caricatori di dati C++ personalizzati per ridurre il sovraccarico aggiunto dal multiprocessing Python e ha creato una variante Flash Consideration personalizzata per ottimizzare il calcolo dell’attenzione durante l’inferenza. Il checkpoint è stato parallelizzato anziché serializzato, il che ha contribuito a sfruttare maggiormente la memoria GPU disponibile.

“Uno degli aspetti su cui dovevamo lavorare period l’utilizzo di molte più GPU di quelle che avremmo voluto”, ha affermato Jurka. “Essere molto ponderati su come coordinare i carichi di lavoro di CPU e GPU perché la cosa bella di questo tipo di LLM e del contesto rapido che utilizziamo per generare incorporamenti è che puoi ridimensionarli dinamicamente.”

Per gli ingegneri che creano sistemi di raccomandazione o recupero, la riprogettazione di LinkedIn offre un caso di studio concreto su ciò che richiede effettivamente la sostituzione di pipeline frammentate con un modello di incorporamento unificato: ripensare il modo in cui i segnali numerici sono rappresentati nei immediate, separare deliberatamente i carichi di lavoro di CPU e GPU e costruire modelli di classificazione che trattano la cronologia degli utenti come una sequenza piuttosto che un insieme di eventi indipendenti. La lezione non è che i LLM risolvono i problemi dei feed: è che la loro implementazione su larga scala ti costringe a risolvere una classe di problemi diversa da quella con cui hai iniziato.