La startup cinese di intelligenza artificiale Z.ai, nota per la sua potente famiglia GLM open supply di modelli linguistici di grandi dimensioni (LLM), ha introdotto GLM-5-Turbo, una nuova variante proprietaria del suo modello GLM-5 open supply mirato a flussi di lavoro guidati da agenti, con l’azienda che lo posiziona come un modello più veloce ottimizzato per attività in stile OpenClaw come l’uso di strumenti, l’esecuzione a catena lunga e l’automazione persistente.

È ora disponibile tramite l’interfaccia di programmazione dell’applicazione (API) di Z.ai su supplier di terze parti OpenRouter con una finestra di contesto di circa 202,8.000 token, output massimo di 131.1.000 e un prezzo indicato di 0,96 dollari per milione di token di enter e 3,20 dollari per milione di token di output. Ciò lo rende circa 0,04 dollari più economico per costo totale di enter e output (a 1 milione di token) rispetto al suo predecessore, secondo i nostri calcoli.

|

Modello |

Ingresso |

Produzione |

Costo totale |

Fonte |

|

Grok 4.1 Veloce |

$ 0,20 |

$ 0,50 |

$ 0,70 |

|

|

Gemelli 3Flash |

$ 0,50 |

$ 3,00 |

$ 3,50 |

|

|

Kimi-K2.5 |

$ 0,60 |

$ 3,00 |

$ 3,60 |

|

|

GLM-5-Turbo |

$ 0,96 |

$ 3,20 |

$ 4,16 |

|

|

GLM-5 |

$ 1,00 |

$ 3,20 |

$ 4,20 |

|

|

ClaudeHaiku4.5 |

$ 1,00 |

$ 5,00 |

$ 6,00 |

|

|

Qwen3-Max |

$ 1,20 |

$ 6,00 |

$ 7,20 |

|

|

Gemelli 3 Professional |

$ 2,00 |

$ 12,00 |

$ 14,00 |

|

|

GPT-5.2 |

$ 1,75 |

$ 14,00 |

$ 15,75 |

|

|

GPT-5.4 |

$ 2,50 |

$ 15,00 |

$ 17,50 |

|

|

Claude Sonetto 4.5 |

$ 3,00 |

$ 15,00 |

$ 18,00 |

|

|

Claude Opus 4.6 |

$ 5,00 |

$ 25,00 |

$ 30,00 |

|

|

GPT-5.4Pro |

$ 30,00 |

$ 180,00 |

$ 210,00 |

In secondo luogo, Z.ai sta anche aggiungendo il modello al suo prodotto in abbonamento GLM Coding, che è il suo servizio di assistenza alla codifica in pacchetto. Questo servizio ha tre livelli: Lite a $ 27 al trimestre, Professional a $ 81 al trimestre e Max a $ 216 al trimestre.

La nota di lancio di Z.ai del 15 marzo afferma che gli abbonati Professional riceveranno GLM-5-Turbo a marzo, mentre gli abbonati Lite riceveranno il GLM-5 base a marzo e dovranno attendere fino advert aprile per GLM-5-Turbo. Anche l’azienda sta prendendo applicazioni ad accesso anticipato per le imprese tramite un modulo Googleil che suggerisce che alcuni utenti potrebbero ottenere l’accesso prima di story programma a seconda della capacità.

z.ai descrive GLM-5-Turbo come progettato per “inferenza rapida” e “profondamente ottimizzato per flussi di lavoro di agenti del mondo reale che coinvolgono lunghe catene di esecuzione”, con miglioramenti nella scomposizione di istruzioni complesse, nell’uso degli strumenti, nell’esecuzione pianificata e persistente e nella stabilità tra attività estese.

La versione offre agli sviluppatori una nuova opzione per creare agenti IA autonomi in stile OpenClaw e funge da segnale su dove i fornitori di modelli ritengono che si stia dirigendo la domanda aziendale: lontano dalle interfacce di chat e verso sistemi in grado di eseguire in modo affidabile lavoro in più fasi.

È qui che ora si sta muovendo gran parte della concorrenza, soprattutto tra i fornitori che cercano di conquistare sviluppatori e crew aziendali che creano assistenti interni, orchestratori di flussi di lavoro e agenti di codifica.

Costruito per l’esecuzione, non solo per la conversazione

I materiali di Z.ai inquadrano GLM-5-Turbo come un modello per il comportamento dell’agente simile alla produzione piuttosto che per l’uso statico a risposta rapida.

La presentazione è incentrata sull’affidabilità nei flussi di attività pratici: migliore esecuzione dei comandi, invocazione più efficace degli strumenti, migliore gestione delle attività pianificate e persistenti ed esecuzione più rapida attraverso catene logiche più lunghe. Questo posizionamento colloca il modello direttamente nel mercato degli agenti che fanno di più che rispondere alle domande.

È rivolto a sistemi in grado di raccogliere informazioni, richiamare strumenti, scomporre istruzioni e continuare a lavorare attraverso sequenze di attività complesse con minore supervisione.

Piuttosto che un diretto successore di GLM-5, GLM-5-Turbo sembra essere una variante più incentrata sull’esecuzione: ottimizzata per velocità, utilizzo degli strumenti e stabilità dell’agente a catena lunga, mentre il GLM-5 base rimane il più ampio fiore all’occhiello open supply di Z.ai.

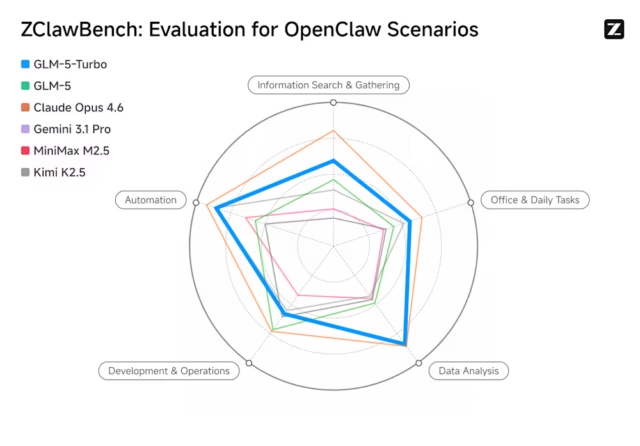

GLM-5-Turbo appare particolarmente competitivo negli scenari OpenClaw come ricerca e raccolta di informazioni, attività d’ufficio e quotidiane, analisi dei dati, sviluppo e operazioni e automazione. Si tratta di materiali forniti dall’azienda, non di validazioni indipendenti, ma rendono chiaro il posizionamento previsto del prodotto.

Background: z.ai e GLM-5 preparano il terreno per Turbo

Fondata nel 2019 come spin-off della Tsinghua College a Pechino, Z.ai – precedentemente Zhipu AI – è ora una delle società modello di fondazione più be aware della Cina. La società rimane con sede a Pechino ed è guidata dal CEO Zhang Peng

Z.ai è quotato alla Borsa di Hong Kong l’8 gennaio 2026, con azioni al prezzo di HK $ 116,20 e apertura a HK $ 120, per una capitalizzazione di mercato dichiarata di HK $ 52,83 miliardi, rendendolo il più grande sviluppatore indipendente di modelli linguistici di grandi dimensioni della Cina.

Secondo quanto riferito, al 30 settembre 2025 i suoi modelli erano stati utilizzati da oltre 12.000 clienti aziendali, più di 80 milioni di dispositivi per utenti finali e più di 45 milioni di sviluppatori in tutto il mondo.

L’ultima main launch di Z.ai, GLM-5, che ha debuttato nel febbraio 2026, fornisce un contesto utile per ciò che l’azienda sta ora cercando di fare con GLM-5-Turbo.

GLM-5 è un modello di punta open supply con licenza MIT, che registra un punteggio file per le allucinazioni sull’indice AA-Omniscience e ha debuttato con una “modalità agente” nativa che potrebbe trasformare suggerimenti o materiali di origine in file .docx, .pdf e .xlsx pronti all’uso.

Quella versione precedente è stata anche considerata un importante passo avanti tecnico per l’azienda. GLM-5 è arrivato a 744 miliardi di parametri con 40 miliardi attivi per token in un’architettura mista di esperti, ha utilizzato 28,5 trilioni di token di pre-addestramento e si è affidato a una nuova infrastruttura di apprendimento per rinforzo asincrono chiamata “slime” per ridurre i colli di bottiglia nella formazione e supportare comportamenti degli agenti più complessi.

In questa luce, GLM-5-Turbo assomiglia meno a un sostituto di GLM-5 che a una propaggine commerciale più ristretta: una variante che mantiene l’orientamento advert lungo contesto e agente della linea di punta, ma enfatizza la velocità, la stabilità e l’esecuzione nelle catene di agenti del mondo reale.

Funzionalità dello sviluppatore e packaging del modello

Dal punto di vista tecnico, Z.ai ha confezionato la famiglia GLM-5 con il tipo di funzionalità che gli sviluppatori ora si aspettano da modelli seri rivolti agli agenti, tra cui gestione di contesti lunghi, strumenti, supporto del ragionamento e integrazioni strutturate.

La pagina GLM-5-Turbo di OpenRouter elenca il supporto per gli strumenti, la scelta degli strumenti e la formattazione della risposta, oltre a far emergere dati sulle prestazioni in tempo reale, inclusi throughput medio e latenza.

La telemetria del supplier di OpenRouter aggiunge un utile confronto a livello di distribuzione tra GLM-5 e GLM-5-Turbo, sebbene i dati non siano perfettamente comparabili perché GLM-5 appare su diversi supplier mentre GLM-5-Turbo viene mostrato solo tramite Z.ai.

In termini di throughput, GLM-5-Turbo ha una media di 48 token al secondo su OpenRouter, il che lo colloca al di sotto degli endpoint GLM-5 più veloci mostrati negli screenshot, inclusi Fireworks a 70 tok/s e Friendli a 58 tok/s, ma sopra i 40 tok/s di Collectively.

Sulla latenza grezza del primo token, GLM-5-Turbo è più lento nei dati disponibili, registrando 2,92 secondi contro 0,41 secondi per l’endpoint GLM-5 di Friendli, 1,00 secondi per Parasail e 1,08 secondi per DeepInfra.

Ma il quadro migliora per quanto riguarda il tempo di completamento end-to-end: GLM-5-Turbo viene mostrato in 8,16 secondi, più veloce degli endpoint GLM-5, che vanno da 9,34 secondi su Fireworks a 11,23 secondi su DeepInfra.

Il vantaggio operativo più notevole risiede nell’affidabilità dello strumento. GLM-5-Turbo mostra un tasso di errore nelle chiamate allo strumento dello 0,67%, sostanzialmente inferiore a quello mostrato dai supplier GLM-5, dove i tassi di errore vanno dal 2,33% al 6,41%.

Per i crew aziendali, ciò suggerisce un modello che potrebbe non vincere in termini di reattività iniziale nel suo attuale routing OpenRouter, ma potrebbe comunque essere più adatto a esecuzioni più lunghe dell’agente in cui la stabilità del completamento e il minor numero di errori dello strumento contano più del primo token più veloce.

Benchmarking e prezzi

Un grafico radar ZClawBench pubblicato da z.ai mostra che GLM-5-Turbo è particolarmente competitivo negli scenari OpenClaw come ricerca e raccolta di informazioni, attività quotidiane e d’ufficio, analisi dei dati, sviluppo e operazioni e automazione.

Si tratta di elementi visivi di benchmark forniti dall’azienda, non di validazione indipendente, ma aiutano a spiegare come Z.ai vuole che i due modelli vengano interpretati: GLM-5 come codifica più ampia e fiore all’occhiello aperto, e Turbo come variante di esecuzione dell’agente più mirata.

Un segnale di licenza più sfumato

Un avvertimento notevole riguarda la licenza. Z.ai afferma che GLM-5-Turbo è attualmente closed-source, ma afferma anche che le capacità e i risultati del modello verranno integrati nella prossima versione del modello open-source. Questa è una distinzione importante. La società non promette chiaramente di rendere open supply il GLM-5-Turbo.

Si sta invece affermando che le lezioni, le tecniche e i miglioramenti di questa versione daranno forma a un futuro modello aperto. Ciò rende il lancio più sfumato di una rottura netta con l’apertura.

La precedente strategia GLM di Z.ai si basava fortemente su versioni aperte e distribuzione a peso aperto, che l’hanno aiutata a creare visibilità tra gli sviluppatori.

Il mercato cinese dell’intelligenza artificiale potrebbe riequilibrarsi allontanandosi dall’open supply

La posizione di licenza di GLM-5-Turbo si colloca anche in un contesto di mercato cinese più ampio che rende il lancio più degno di nota di un semplice aggiornamento del prodotto.

Nelle ultime settimane, le notizie sull’unità Qwen di Alibaba hanno sollevato nuove domande su come i principali laboratori cinesi di intelligenza artificiale riusciranno a bilanciare i rilasci aperti con la pressione commerciale.

All’inizio di questo mese, il capo della divisione Qwen, Lin Junyang, si è dimesso, diventando il terzo dirigente senior di Qwen a lasciare nel 2026, anche se la famiglia Qwen di Alibaba rimane uno degli sforzi di modello aperto più prolifici al mondo, con più di 400 modelli open supply rilasciati dal 2023 e più di 1 miliardo di obtain.

Lo ha riferito poi la Reuters il 16 marzo il CEO di Alibaba, Eddie Wu, avrebbe assunto il controllo diretto di un nuovo gruppo imprenditoriale focalizzato sull’intelligenza artificiale che consolida Qwen e altre unità, in mezzo al controllo sulla strategia, sulla redditività e sulla brutale concorrenza sui prezzi che circonda le offerte di modelli aperti in Cina.

Anche senza sopravvalutare questi sviluppi, essi aiutano a inquadrare la questione più ampia che incombe sul settore: se gli aspetti economici dell’intelligenza artificiale di frontiera stanno iniziando a spingere anche i laboratori cinesi storicamente aperti verso una strategia più segmentata.

Ciò non significa che i laboratori cinesi stiano abbandonando l’open supply. Ma il modello sta diventando sempre più difficile da ignorare: i modelli aperti aiutano a promuovere l’adozione, la buona volontà degli sviluppatori e la portata dell’ecosistema, mentre alcune varianti di alto valore rivolte agli agenti aziendali, ai flussi di lavoro di codifica e advert altri casi d’uso commercialmente attraenti potrebbero sempre più arrivare prima come prodotti proprietari.

In questo senso, GLM-5-Turbo si adatta a un cambiamento più ampio possibile nel mercato cinese dell’intelligenza artificiale, che sembra sempre più simile al playbook utilizzato da OpenAI, Anthropic e Google negli Stati Uniti: apertura come distribuzione, sistemi proprietari come enterprise.

Visto sotto questa luce, GLM-5-Turbo sembra più di un aggiornamento del prodotto incentrato sulla velocità. Potrebbe essere un altro segnale che parti del settore dell’intelligenza artificiale cinese si stanno muovendo verso lo stesso modello ibrido già comune negli Stati Uniti: apertura come distribuzione, sistemi proprietari come enterprise.

Ciò non segnerebbe la advantageous dell’intelligenza artificiale open supply dei laboratori cinesi, ma potrebbe significare che le loro offerte incentrate sugli agenti strategicamente più importanti appariranno per prime dietro accesso chiuso, anche se alcuni dei loro progressi sottostanti successivamente si faranno strada nelle versioni aperte.

Per gli sviluppatori che valutano le piattaforme agente, ciò rende GLM-5-Turbo sia un lancio di prodotto che un segnale utile. Z.ai parla ancora il linguaggio dei modelli aperti. Ma con questa versione, viene anche dimostrato che parte del suo lavoro più rilevante dal punto di vista commerciale potrebbe arrivare prima come infrastruttura proprietaria per sistemi di agenti di livello aziendale.