Segui ZDNET: Aggiungici come fonte preferita su Google.

I principali punti salienti di ZDNET

- Nvidia ha mostrato cinque rack di apparecchiature che coprono tutti gli aspetti dell’infrastruttura AI.

- Nvidia sostiene che l’economia dell’IA è migliore quando tutte le parti provengono da Nvidia.

- L’ambizione di ampliamento di Nvidia embrace la robotica e persino l’intelligenza artificiale nello spazio.

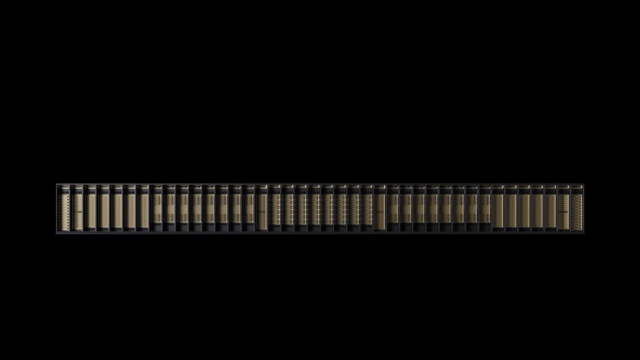

L’immagine che Nvidia ha suggerito ai media per la sua conferenza GTC a San Jose, in California, questa settimana è una linea di 40 rettangoli che rappresentano rack di server di knowledge middle di vario tipo. Nessuna etichetta, solo scaffali che sembrano uno scaffale con l’opera completa di Shakespeare o, cosa più sinistramente, una falange di soldati.

Il messaggio implicito dell’imponente muro di rack è che Nvidia, se non lo ha già fatto, alla fantastic sarà proprietaria di tutta l’elaborazione nel knowledge middle, da un’estremità all’altra.

Inoltre: questo sistema operativo alimenta silenziosamente tutta l’intelligenza artificiale e anche la maggior parte dei futuri lavori IT

Sul palco dello present, il CEO di Nvidia Jensen Huang ha utilizzato il discorso di apertura di lunedì per annunciare un ampliamento dell’offerta di chip e sistemi dell’azienda. Le linee di prodotti esistenti includono il chip CPU Vera, il chip GPU Rubin e, ora, un nuovo tipo di rack di apparecchiature si unisce a loro, per l’inferenza ultraveloce, chiamato LPX.

Un nuovo rack solo per l’inferenza dell’intelligenza artificiale

Il rack LPX, che sarà disponibile entro la fantastic dell’anno, è costituito da chip che Nvidia ha progettato utilizzando la proprietà intellettuale concessa in licenza a dicembre dalla startup AI Groq per 20 miliardi di dollari.

L’approccio Groq trasformato, implementato nella LPU Nvidia Groq 3, verrà utilizzato nell’LPX in combinazione con le GPU Rubin per raggiungere un equilibrio ottimale tra velocità di inferenza e quantità totale di dati che possono essere gestiti.

Il Groq 3 LPU “può combinare i FLOPS estremi [floating-point operations per second] di GPU e la larghezza di banda delle LPU in uno solo”, ha affermato Ian Buck, responsabile dell’hyper-scale e dell’elaborazione advert alte prestazioni di Nvidia, in un pre-briefing con i media.

Inoltre: gli attacchi cloud stanno diventando sempre più rapidi e letali: ecco il tuo miglior piano di difesa

L’originale Groq LPU, che sta per “unità di elaborazione del linguaggio”, ha 500 megabyte di SRAM su chip, una forma di memoria veloce molto più grande di una normale cache di memoria del chip. La SRAM può contenere i pesi, ovvero i parametri neurali, di grandi modelli linguistici, nonché la “cache KV”, i risultati intermedi dei calcoli che accelerano l’inferenza.

Utilizzando la LPU in un rack insieme alle GPU, la SRAM della LPU può recuperare i dati più necessari, riducendo la necessità di richiedere dati dalla DRAM off-chip, cosa che devono fare le GPU. La cache SRAM locale riduce drasticamente la latenza, il tempo di andata e ritorno per recuperare e fornire una risposta a una question, ha affermato Buck.

“Le cose che richiedevano interrogazioni di un giorno verranno prodotte in meno di un’ora”, ha affermato Buck.

Cambiare l’economia dell’intelligenza artificiale

La LPU può anche eseguire l’elaborazione delle question in modo molto più efficiente, afferma Nvidia. La società di ricerche di mercato TechInsights ha riferito, sulla base del silicio Groq esistente prima dell’accordo con Nvidia, che “l’energia per bit” della LPU per l’accesso alla memoria è un terzo di un picojoule, o 20 volte inferiore ai 6 picojoule di una GPU per accedere alla DRAM.

Per la stessa quantità di denaro per token, le LPU Groq nel rack LPX forniranno 35 volte più token al secondo per megawatt di potenza, ha affermato Buck, utilizzando l’esempio di 500.000 token elaborati al secondo per un prezzo di 45 dollari per milione di token.

Anche: Perché pagherai di più per l’intelligenza artificiale nel 2026 e 3 suggerimenti per risparmiare denaro da provare

Questa drastica accelerazione nel recupero e nella consegna dei token porta anche a un aumento di 10 volte delle entrate in dollari che un fornitore di intelligenza artificiale può realizzare al secondo per megawatt, ha affermato Buck.

Anche se non menzionato esplicitamente, ridurre l’uso delle DRAM off-chip è sempre più importante dato che i prezzi delle DRAM sono in forte aumento in questo momento.

Meglio quando acquisti tutto da noi

Il rack LPX fa parte della proposta generale di Huang al mondo dell’intelligenza artificiale: l’azienda offre una migliore economia vendendo tutte le parti dell’equazione: non solo i chip Vera, Rubin e LPU, ma anche il software program che gira su di essi.

“Dalla torta a cinque strati composta da energia, chip, infrastruttura stessa, modelli e applicazioni, questa infrastruttura multistrato sta guidando le entrate e la creazione di posti di lavoro”, ha detto Buck di Nvidia ai giornalisti.

L’LPX si trova in quella fila di 40 rettangoli accanto advert altri quattro rack di cui ha parlato Huang, che costituiscono la proposta della sua azienda per un’infrastruttura AI completa.

C’è il Vera-Rubin NVL72, un rack composto da 72 CPU Rubin e 36 CPU Vera; un nuovo rack solo CPU, il rack Vera CPU, composto da 256 CPU Vera e 400 terabyte di DRAM; un nuovo tipo di rack di archiviazione dati, il Bluefield 4 STX che funge da sorta di repository per la cache KV su tutte le GPU; e l’ultima versione del rack per apparecchiature di rete Ethernet di Nvidia, lo Spectrum-6 SPX.

Inoltre: i modelli fisici di intelligenza artificiale di Nvidia aprono la strada ai robotic di nuova generazione: ecco le novità

Buck ha spiegato che i rack CPU Veru accelerano tutti i compiti dell’intelligenza artificiale degli agenti che sarebbero eccessivi per una CPU x86 convenzionale basata su Intel o AMD.

“Le GPU oggi in realtà si rivolgono alle CPU per eseguire chiamate di strumenti, question SQL e compilazione di codice”, ha affermato Buck. “Questa esecuzione sandbox è una parte fondamentale sia della formazione che dell’implementazione degli agenti nei knowledge middle e tali CPU devono essere veloci.”

Ha affermato che il rack CPU Vera può essere una volta e mezza più veloce nelle attività CPU a thread singolo rispetto alle CPU x86 esistenti. Di conseguenza, i rack STX quadruplicheranno le prestazioni per watt, raddoppieranno le pagine al secondo per i dati aziendali e forniranno cinque volte i token al secondo di memoria di contesto richiesta per le fabbriche di intelligenza artificiale che eseguono flussi di lavoro GenTech.

“I risultati sono sorprendenti”, ha detto Buck.

Il nuovo rack di archiviazione dati, ha spiegato Buck, è “uno strato condiviso a larghezza di banda elevata ottimizzato per archiviare e recuperare gli enormi dati della cache di valori-chiave generati dai flussi di lavoro LLM e GenTech”. Sebbene il rack sia costituito da Nvidia Bluefield DPU (unità di elaborazione dati, affini alle CPU), l’STX è solo una “architettura di riferimento”, ha affermato Buck, il che significa che i rack effettivi saranno progettati e costruiti dai associate Nvidia.

Ampliare le ambizioni

La portata e l’ampiezza delle ambizioni mostrate nel keynote di Huang sono notevoli. Come spiega dettagliatamente la mia collega Radhika Rajkumar nel suo articolo, Huang ha anche parlato della propria offerta di IA agente, NemoClaw e di molteplici offerte per la cosiddetta IA fisica, principalmente la robotica. Huang ha anche parlato di intelligenza artificiale nello spazio, anche se i dettagli sull’implementazione dei server basati su satellite tv for pc rimangono vaghi, secondo Radhika.

Buck ha definito il muro di diversi server come “un co-design end-to-end estremo per fornire il massimo valore dalla fabbrica dell’intelligenza artificiale per tutti i carichi di lavoro dell’intelligenza artificiale e di tutti i settori”.

Anche: Nvidia scommette su OpenClaw, ma aggiunge un livello di sicurezza: come funziona NemoClaw

È anche un modo astuto per Nvidia di rendere evidente la sua proposta di valore a chiunque voglia prendere in considerazione l’utilizzo di CPU e GPU della concorrenza AMD o l’utilizzo di apparecchiature AI esotiche di sfidanti startup come Cerebras Techniques. Con un portafoglio di cinque rack di apparecchiature, che coprono tutte le funzioni del knowledge middle, Huang sta dicendo ai clienti che tutto funzionerà in modo più efficiente e genererà più entrate dall’IA, quando tutto sarà fornito da Nvidia.

Per Huang, è anche il culmine di una ricerca decennale per rilevare parti dell’informatica dagli operatori storici. In passato, ha tentato di prendere d’assalto il mercato delle CPU per server con robuste CPU per server come Denver. Ma Huang ha dovuto ritirarsi quando la potenza radicata della CPU Xeon di Intel è diventata troppo forte da superare.

Con uno scaffale ora pieno di parti full per un knowledge middle, l’azienda di Huang è pronta a definire l’period dell’informatica e a sopraffare le aziende che hanno definito l’period precedente.