Tre gruppi di difesa lo hanno fatto ha intentato una causa contro OpenAI per conto della famiglia di un diciannovenne morto per overdose nel maggio 2025. La causa sostiene che il chatbot ChatGPT dell’azienda ha informato Samuel Nelson dell’uso di droga per 18 mesi fino alla sua morte per overdose dopo aver mescolato Xanax e il farmaco in gran parte non regolamentato kratom.

La causa civile per omicidio colposo è stata intentata martedì presso la Corte Superiore della contea di San Francisco da Tech Justice Regulation, Social Media Victims Regulation Middle e Tech Accountability & Competitors Venture della Yale Regulation College per conto dei genitori di Nelson, Leila Turner-Scott e Angus Scott.

La causa sostiene che il design del modello di intelligenza artificiale per essere accomodante e servile nei confronti dell’utente ha portato Nelson advert avere interazioni che avrebbero dovuto essere interrotte da progetti di sicurezza responsabili. “ChatGPT ha sistematicamente spinto Sam sempre più lontano da quella che avrebbe dovuto essere la sua realtà: cautela e paura per le quantità e le combinazioni di farmaci che stava prendendo in considerazione”, si legge nella denuncia. “ChatGPT ha fatto vivere Sam in uno stato di irrealtà: lo ha sistematicamente normalizzato e attirato ingannevolmente in un falso senso di sicurezza attraverso i suoi messaggi servili, convalidando Sam in ogni momento.”

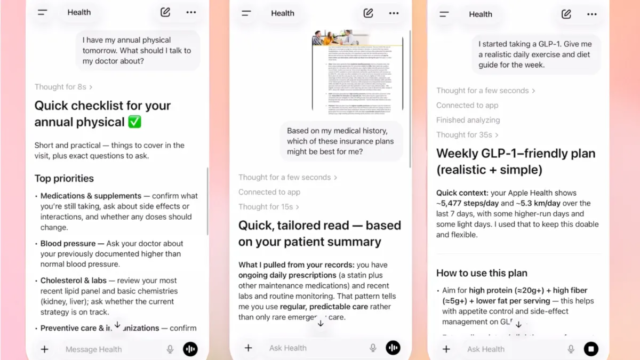

La causa non chiede solo danni monetari, ma richiede anche che OpenAI “distrugga permanentemente” il suo modello GPT-4o, che period la versione con cui Nelson ha interagito, che OpenAI implementi misure di salvaguardia per interrompere le conversazioni sui metodi di droga illeciti e che la società sospenda il suo servizio ChatGPT Well being “fino a quando e a meno che terze parti non stabiliscano che il prodotto è sicuro attraverso controlli di sicurezza completi.

Diversi gruppi di difesa hanno intentato una causa contro OpenAI per conto della famiglia di Sam Nelson, morto per overdose di droga all’età di 19 anni nel 2025. La causa sostiene che i consigli sulla droga di ChatGPT hanno portato alla morte di Nelson.

Un rappresentante di OpenAI ha dichiarato a CNET in una dichiarazione: “Questa è una situazione straziante e i nostri pensieri sono rivolti alla famiglia. Queste interazioni hanno avuto luogo su una versione precedente di ChatGPT che non è più disponibile. ChatGPT non è un sostituto dell’assistenza medica o di salute mentale e abbiamo continuato a rafforzare il modo in cui risponde in situazioni delicate e acute con il contributo di esperti di salute mentale. Le protezioni in ChatGPT oggi sono progettate per identificare il disagio, gestire in sicurezza richieste dannose e guidare gli utenti verso l’aiuto nel mondo reale. Questo lavoro è in corso e continuiamo a migliorarlo in stretta collaborazione con i medici.”

(Divulgazione: Ziff Davis, la società madre di CNET, nel 2025 ha intentato una causa contro OpenAI, sostenendo di aver violato i diritti d’autore di Ziff Davis nella formazione e nel funzionamento dei suoi sistemi di intelligenza artificiale.)

La società ha affermato che la risposta iniziale di ChatGPT alle richieste di Nelson è stata quella di dire che il servizio non fornisce informazioni o indicazioni sull’abuso di droghe, ma è noto che i guardrail nei chatbot con intelligenza artificiale si rompono dopo ripetute richieste di informazioni da parte degli utenti.

OpenAI in passato ha annunciato miglioramenti ai suoi modelli di intelligenza artificiale in risposta a trigger legali, proposte di regolamenti e proteste pubbliche per morti e suicidi legati alle conversazioni di chatbot. Esso ha delineato alcuni di questi cambiamenti in un post sul blog lo scorso ottobre.

La causa Nelson è uno dei casi più importanti contro OpenAI che coinvolge i pericoli che i chatbot possono rappresentare per gli utenti con problemi di salute mentale, bambini, coloro che potrebbero commettere violenza su scala di massa o persone alle prese con l’abuso di sostanze. IL Il New York Times ha pubblicato una lunga storia sull’archiviazione, descrivendo in dettaglio ciò che è accaduto nel contesto di oltre due dozzine di casi contro società di intelligenza artificiale, inclusa OpenAI.

Anche SFGate ha pubblicato un pezzo investigativo su Nelson e la sua famiglia a gennaio.

Guardrail cercati per l’intelligenza artificiale

Le trigger legali, nel complesso, hanno messo in luce i pericoli che i modelli di intelligenza artificiale in rapida evoluzione rappresentano una nuova tecnologia, in gran parte non testata, creata da un settore resistente alla regolamentazione.

L’amministrazione Trump si è battuta apertamente per impedire agli stati di attuare leggi che limiterebbero ciò che le società di intelligenza artificiale possono fare, ma lo ha fatto di recente ha cambiato tonocon il presidente Donald Trump che ha accettato di dialogare con la Cina su argomenti che includono misure di sicurezza, in particolare per modelli di intelligenza artificiale più potenti come I miti dell’antropologia.

L’intelligenza artificiale è anche sotto accusa per i suoi contributi al proliferazione dei information heartche sono grandi consumatori di energia e acqua.

Ma con trigger legali come quella intentata dai gruppi di difesa e dalla famiglia di Samuel Nelson, i dettagli spesso rivelano i modi in cui i chatbot basati sull’intelligenza artificiale possono abilitare, e persino incoraggiare, comportamenti dannosi tra coloro che fanno affidamento sull’intelligenza artificiale per il loro processo decisionale.

In un comunicato sulla causa, la madre di Nelson ha detto: “Sam si è fidato di ChatGPT, ma non solo gli ha fornito false informazioni. Ha ignorato il rischio crescente che ha dovuto affrontare e non lo ha incoraggiato attivamente a cercare aiuto”.

“ChatGPT è stato progettato per incoraggiare il coinvolgimento degli utenti a tutti i costi, che nel caso di Sam period la sua vita”, ha affermato Turner-Scott.