Per più di due decenni, le aziende digitali si sono basate su un semplice presupposto: quando qualcuno interagisce con un sito net, quell’attività riflette una scelta consapevole da parte di un essere umano. I clic vengono trattati come segnali di interesse. Si presuppone che il tempo trascorso sulla pagina indichi il coinvolgimento. Il movimento attraverso un imbuto viene interpretato come intento. Intere strategie di crescita, price range di advertising and marketing e decisioni sui prodotti sono stati costruiti su questa premessa.

Oggi, story presupposto sta silenziosamente cominciando a erodersi.

Poiché gli strumenti basati sull’intelligenza artificiale interagiscono sempre più con il Internet per conto degli utenti, molti dei segnali da cui dipendono le organizzazioni stanno diventando sempre più difficili da interpretare. I dati in sé sono ancora accurati (le pagine vengono visualizzate, i pulsanti vengono cliccati, le azioni vengono registrate), ma il significato dietro tali azioni sta cambiando. Questo cambiamento non è teorico o limitato ai casi limite. Sta già influenzando il modo in cui i chief leggono i dashboard, prevedono la domanda e valutano le prestazioni.

La sfida futura non è fermare le interazioni guidate dall’intelligenza artificiale. Significa imparare a interpretare il comportamento digitale in un mondo in cui l’attività umana e quella automatizzata si sovrappongono sempre più.

Un’ipotesi mutevole sul traffico net

Per decenni, le fondamenta di Web si sono basate su un modello tranquillo, incentrato sull’uomo. Dietro ogni pergamena, invio di moduli o flusso di acquisto c’period una persona che agisce per curiosità, necessità o intenzione. Le piattaforme di analisi si sono evolute per catturare questi comportamenti. I sistemi di sicurezza si concentrano sulla separazione degli “utenti legittimi” dall’automazione chiaramente programmata. Anche l’economia della pubblicità digitale presupponeva che il coinvolgimento equivalesse all’attenzione umana.

Negli ultimi anni, quel modello ha iniziato a cambiare. I progressi nei modelli linguistici di grandi dimensioni (LLM), nell’automazione dei browser e negli agenti basati sull’intelligenza artificiale hanno consentito ai sistemi software program di navigare sul Internet in modi fluidi e consapevoli del contesto. Le pagine vengono esplorate, le opzioni confrontate, i flussi di lavoro vengono completati, spesso senza evidenti segni di automazione.

Ciò non significa che il net stia diventando meno umano. Invece, sta diventando più ibrido. I sistemi di intelligenza artificiale sono sempre più integrati nei flussi di lavoro quotidiani, fungendo da assistenti di ricerca, strumenti di confronto o completatori di attività per conto delle persone. Di conseguenza, il confine tra un essere umano che interagisce direttamente con un sito e un software program che agisce per suo conto sta diventando meno netto.

La sfida non è l’automazione in sé. È l’ambiguità che questa sovrapposizione introduce nei segnali su cui fanno affidamento le aziende.

Cosa intendiamo per traffico generato dall’intelligenza artificiale?

Quando le persone sentono parlare di “traffico automatizzato”, spesso pensano ai bot del passato: script rigidi che seguivano percorsi predefiniti e si rompevano nel momento in cui cambiava un’interfaccia. Tali sistemi erano ripetitivi, prevedibili e relativamente facili da identificare.

Il traffico generato dall’intelligenza artificiale è diverso.

I moderni agenti IA combinano l’apprendimento automatico (ML) con funzionalità di navigazione automatizzata. Possono interpretare i structure di pagina, adattarsi ai cambiamenti dell’interfaccia e completare attività in più passaggi. In molti casi, i modelli linguistici guidano il processo decisionale, consentendo a questi sistemi di adattare il comportamento in base al contesto piuttosto che a regole fisse. Il risultato è un’interazione che appare molto più naturale rispetto all’automazione precedente.

È importante sottolineare che questo tipo di traffico non è intrinsecamente problematico. L’automazione ha svolto a lungo un ruolo produttivo sul net, dall’indicizzazione della ricerca e dagli strumenti di accessibilità ai check di framework e integrazioni. Gli agenti AI più recenti semplicemente estendono questa evoluzione, aiutando gli utenti a riassumere i contenuti, confrontare prodotti o raccogliere informazioni su più siti.

Il problema non è l’intento, ma l’interpretazione. Quando gli agenti AI interagiscono con successo con un sito per conto degli utenti, le metriche di coinvolgimento tradizionali potrebbero non riflettere più lo stesso significato di una volta.

Perché il traffico generato dall’intelligenza artificiale sta diventando sempre più difficile da distinguere

Storicamente, il rilevamento di attività automatizzate si basava sull’individuazione di irregolarità tecniche. I sistemi segnalavano comportamenti che si muovevano troppo velocemente, seguivano percorsi perfettamente coerenti o mancavano di funzionalità del browser customary. L’automazione ha rivelato “raccontamenti” che hanno reso semplice la classificazione.

I sistemi basati sull’intelligenza artificiale cambiano questa dinamica. Operano tramite browser customary. Fanno pausa, scorrono e navigano in modo non lineare. Variano i tempi e le sequenze di interazione. Poiché questi agenti sono progettati per interagire con il net così come è stato costruito – per gli esseri umani – il loro comportamento si fonde sempre più con i normali modelli di utilizzo.

Di conseguenza, la sfida si sposta dall’identificazione degli errori all’interpretazione del comportamento. La questione diventa meno rilevante se un’interazione è automatizzata e altro ancora Come si svolge nel tempo. Molti dei segnali che un tempo separavano gli esseri umani dal software program stanno convergendo, rendendo la classificazione binaria meno efficace.

Quando il coinvolgimento smette di significare ciò che pensiamo

Considera uno state of affairs comune di e-commerce.

Un group di vendita al dettaglio nota un aumento sostenuto delle visualizzazioni dei prodotti e delle azioni “aggiungi al carrello”. Storicamente, questo sarebbe un chiaro segnale di crescita della domanda, che spingerebbe advert un aumento della spesa pubblicitaria o all’espansione dell’inventario.

Immaginiamo ora che una parte di questa attività sia generata da agenti IA che eseguono il monitoraggio dei prezzi o il confronto dei prodotti per conto degli utenti. Le interazioni si sono verificate. Le metriche sono correct. Ma l’intento di fondo è diverso. Il funnel non rappresenta più un percorso diretto verso l’acquisto.

Non c’è nulla di “sbagliato” nei dati, ma il significato è cambiato.

Modelli simili si stanno manifestando in tutti i settori:

-

Gli editori digitali riscontrano picchi nel coinvolgimento degli articoli senza corrispondenti entrate pubblicitarie.

-

Le aziende SaaS osservano un’intensa esplorazione delle funzionalità con una conversione limitata.

-

Le piattaforme di viaggio registrano un aumento dell’attività di ricerca che non si traduce in prenotazioni.

In ogni caso, le organizzazioni rischiano di ottimizzare l’attività piuttosto che il valore.

Perché questo è un problema di dati e analisi

Fondamentalmente, il traffico generato dall’intelligenza artificiale introduce ambiguità nei presupposti alla base dell’analisi e della modellazione. Molti sistemi presuppongono che il comportamento osservato corrisponda chiaramente alle intenzioni umane. Quando le interazioni automatizzate vengono mescolate nei set di dati, story presupposto si indebolisce.

I dati comportamentali possono ora includere:

-

Esplorazione senza intenzione di acquisto

-

Navigazione orientata alla ricerca

-

Completamento dell’attività senza conversione

-

Modelli ripetuti guidati da obiettivi di automazione

Per i group di analisi, ciò introduce rumore nelle etichette, indebolisce le metriche proxy e aumenta il rischio di cicli di suggestions. I modelli addestrati su segnali misti possono imparare a ottimizzare per il quantity piuttosto che per i risultati importanti per l’azienda.

Ciò non invalida l’analisi. Alza il livello dell’interpretazione.

Integrità dei dati in un mondo machine-to-machine

Poiché i dati comportamentali alimentano sempre più i sistemi ML che modellano l’esperienza dell’utente, la composizione di tali dati è importante. Se una quota crescente di interazioni proviene da agenti automatizzati, le piattaforme potrebbero iniziare a ottimizzare per la navigazione automatica piuttosto che per l’esperienza umana.

Nel tempo, questo può rimodellare sottilmente il net. Le interfacce possono diventare efficienti per l’estrazione e il riepilogo perdendo le irregolarità che le rendono intuitive o coinvolgenti per le persone. Per preservare un segnale umano significativo è necessario andare oltre il quantity grezzo e concentrarsi sul contesto dell’interazione.

Dall’esclusione all’interpretazione

Per anni, la risposta predefinita all’automazione è stata l’esclusione. CAPTCHA, limiti di velocità e soglie statiche funzionavano bene quando il comportamento automatizzato period chiaramente distinto.

Questo approccio sta diventando sempre meno efficace. Gli agenti basati sull’intelligenza artificiale spesso forniscono un valore reale agli utenti e il blocco generalizzato può peggiorare l’esperienza dell’utente senza migliorare i risultati. Di conseguenza, molte organizzazioni stanno passando dall’esclusione all’interpretazione.

Invece di chiedersi come tenere fuori l’automazione, i group si chiedono come comprendere i diversi tipi di traffico e rispondere in modo appropriato, offrendo esperienze allineate allo scopo senza assumere un’unica definizione di legittimità.

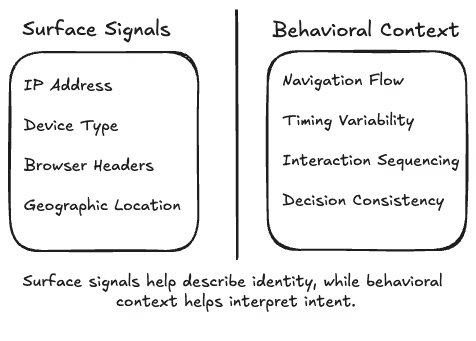

Il contesto comportamentale come segnale complementare

Un approccio promettente si concentra sul contesto comportamentale. Invece di incentrare l’analisi sull’identità, i sistemi esaminano come si svolgono le interazioni nel tempo.

Il comportamento umano è incoerente e inefficiente. Le persone esitano, fanno marcia indietro ed esplorano in modo imprevedibile. Gli agenti automatizzati, anche quando adattivi, tendono a mostrare una logica interna più strutturata. Osservando il flusso di navigazione, la variabilità temporale e la sequenza delle interazioni, i group possono dedurre le intenzioni in modo probabilistico anziché categorico.

Ciò consente alle organizzazioni di rimanere aperte acquisendo al tempo stesso una comprensione più sfumata dell’attività.

Etica, privateness e interpretazione responsabile

Man mano che l’analisi diventa più sofisticata, i confini etici diventano più importanti. Comprendere i modelli di interazione non è la stessa cosa che monitorare gli individui.

Gli approcci più resilienti si basano su segnali aggregati e anonimizzati e pratiche trasparenti. L’obiettivo è proteggere l’integrità della piattaforma rispettando le aspettative degli utenti. La fiducia rimane un requisito fondamentale, non un ripensamento.

Il futuro: uno spettro di agenzie

Guardando al futuro, le interazioni net rientrano sempre più in uno spettro. Da un lato gli esseri umani navigano direttamente, al centro gli utenti sono assistiti da strumenti di intelligenza artificiale, dall’altro gli agenti finali agiscono in modo indipendente per conto dell’utente.

Questa evoluzione riflette un ecosistema digitale in maturazione. Richiede anche un cambiamento nel modo in cui viene misurato il successo. Il semplice conteggio dei clic o delle visite non è più sufficiente. Il valore deve essere valutato nel contesto.

Su cosa dovrebbero concentrarsi ora i chief aziendali

Il traffico generato dall’intelligenza artificiale non è un problema da eliminare: è una realtà da comprendere.

I chief che si adattano con successo:

-

Rivalutare il modo in cui vengono interpretate le metriche di coinvolgimento

-

Separare l’attività dall’intento nelle revisioni analitiche

-

Investire in approcci di misurazione contestuali e probabilistici

-

Preservare la qualità dei dati man mano che cresce la partecipazione all’intelligenza artificiale

-

Trattare la fiducia e la privateness come principi di progettazione

Il net si è evoluto prima e si evolverà ancora. La domanda è se le organizzazioni sono disposte a evolvere il modo in cui leggono i segnali che produce.

Shashwat Jain è un ingegnere informatico senior presso Amazon.

Benvenuto nella comunità VentureBeat!

Il nostro programma di visitor posting è il luogo in cui gli esperti tecnici condividono approfondimenti e forniscono approfondimenti neutrali e non conferiti su intelligenza artificiale, infrastruttura dati, sicurezza informatica e altre tecnologie all’avanguardia che plasmano il futuro dell’impresa.

Per saperne di più dal nostro programma di publish per gli ospiti e dai un’occhiata al nostro linee guida se sei interessato a contribuire con un tuo articolo!