Secondo una nuova ricerca di Redis, i staff aziendali che ottimizzano i propri modelli di incorporamento RAG per una maggiore precisione potrebbero involontariamente degradare la qualità di recupero da cui dipendono tali pipeline.

L’articolo, “La formazione per la sensibilità compositiva riduce la generalizzazione del recupero denso”, ha testato cosa succede quando i staff addestrano i modelli di incorporamento per la sensibilità compositiva. Questa è la capacità di cogliere frasi che sembrano quasi identiche ma significano qualcosa di diverso: “il cane ha morso l’uomo” rispetto a “l’uomo ha morso il cane” o un’inversione di negazione che inverte completamente il significato di un’affermazione. Quella formazione ha costantemente rotto la generalizzazione del recupero denso, ovvero quanto bene un modello recupera correttamente attraverso argomenti e domini ampi su cui non è stato specificamente formato. Le prestazioni sono diminuite dell’8-9% sui modelli più piccoli e del 40% sull’attuale modello di incorporamento di medie dimensioni che i staff utilizzano attivamente in produzione. I risultati hanno implicazioni dirette per i staff aziendali che creano pipeline di intelligenza artificiale per agenti, in cui la qualità del recupero determina quale contesto confluisce nella catena di ragionamento di un agente. Un errore di recupero in una pipeline a fase singola restituisce una risposta sbagliata. Lo stesso errore in una pipeline di agenti può innescare una cascata di azioni sbagliate a valle.

Srijith Rajamohan, chief della ricerca sull’intelligenza artificiale presso Redis e uno degli autori dell’articolo, ha affermato che la scoperta mette in discussione un’ipotesi diffusa su come funziona effettivamente il recupero basato sull’incorporamento.

“C’è questa nozione generale secondo cui quando si utilizza la ricerca semantica o una somiglianza semantica simile, otteniamo l’intento corretto. Questo non è necessariamente vero”, ha detto Rajamohan a VentureBeat. “Una somiglianza semantica stretta o elevata non significa in realtà un intento esatto.”

La geometria dietro il compromesso di recupero

I modelli di incorporamento funzionano comprimendo un’intera frase in un singolo punto in uno spazio advert alta dimensione, quindi trovando i punti più vicini a una question al momento del recupero. Funziona bene per un’ampia corrispondenza di argomenti: i documenti su argomenti simili finiscono uno vicino all’altro. Il problema è che due frasi con parole quasi identiche ma significati opposti finiscono anche l’una accanto all’altra, perché il modello funziona dal contenuto delle parole piuttosto che dalla struttura.

Questo è ciò che la ricerca ha quantificato. Quando i staff mettono a punto un modello di incorporamento per separare frasi strutturalmente numerous – insegnandogli che un’inversione di negazione che inverte il significato di un’affermazione non è la stessa dell’originale – il modello utilizza lo spazio rappresentazionale che utilizzava in precedenza per un ampio richiamo di attualità. I due obiettivi competono per lo stesso vettore. La ricerca ha inoltre rilevato che la regressione non è uniforme tra i tipi di guasto. Gli errori di negazione e di ribaltamento spaziale sono migliorati in modo misurabile con l’allenamento strutturato. Gli errori vincolanti – dove un modello confonde quale modificatore si applica a quale parola, come advert esempio su quale parte ricade un obbligo contrattuale – sono stati appena spostati. Per i staff aziendali, ciò significa che il problema della precisione è più difficile da risolvere esattamente nei casi in cui sbagliare ha le maggiori conseguenze.

Il motivo per cui la maggior parte dei staff non lo coglie è che le metriche di messa a punto misurano il compito per cui vengono addestrati, non ciò che accade al recupero generale di argomenti non correlati. Un modello può mostrare un forte miglioramento in caso di rifiuto quasi mancato durante l’addestramento mentre regredisce silenziosamente sul lavoro di recupero più ampio per cui è stato assunto. La regressione emerge solo nella produzione.

Rajamohan ha affermato che l’istinto a cui aspira la maggior parte dei staff – passare a un modello di incorporamento più ampio – non affronta l’architettura sottostante. “Non è possibile uscire da questa situazione”, ha detto. “Non è un problema che puoi risolvere con più dimensioni e più parametri.”

Perché tutte le various normal non sono all’altezza

L’istinto naturale quando la precisione del recupero fallisce è quello di sovrapporre approcci aggiuntivi. La ricerca ne ha testati diversi e ha riscontrato che ciascuno fallisce in modo diverso.

Ricerca ibrida. La combinazione del recupero basato sull’incorporamento con la ricerca per parole chiave è già una pratica normal per colmare le lacune in termini di precisione. Ma Rajamohan ha affermato che la ricerca per parole chiave non è in grado di individuare la modalità di errore identificata da questa ricerca, perché il problema non è la mancanza di parole, ma una struttura mal interpretata. “Se hai una frase come ‘Roma è più vicina di Parigi’ e un’altra che cube ‘Parigi è più vicina di Roma’, e fai un recupero di incorporamento seguito da una ricerca testuale, non sarai in grado di notare la differenza,” ha detto. “Le stesse parole esistono in entrambe le frasi.”

Riclassificazione di MaxSim. Alcuni staff aggiungono un secondo livello di punteggio che confronta le singole parole della question con le singole parole del documento anziché fare affidamento sul singolo vettore compresso. Questo approccio, noto come MaxSim o interazione tardiva e utilizzato in sistemi come ColBERT, ha migliorato i punteggi dei benchmark di pertinenza nella ricerca. Ma non è riuscito a respingere i quasi incidenti strutturali, assegnando loro punteggi di somiglianza quasi identitari.

Il problema è che rilevanza e identità sono obiettivi diversi. MaxSim è ottimizzato per il primo e cieco nei confronti del secondo. Un staff che aggiunge MaxSim e vede un miglioramento del benchmark potrebbe risolvere un problema diverso da quello che ha.

Encoder incrociati. Funzionano inserendo contemporaneamente la question e il documento candidato nel modello, consentendogli di confrontare ogni parola con ogni parola prima di prendere una decisione. Questo confronto completo è ciò che li rende accurati e ciò che li rende troppo costosi per essere gestiti su scala di produzione. Rajamohan ha detto che la sua squadra li ha indagati. Funzionano in laboratorio e superano i volumi di question reali.

Memoria contestuale. A volte indicati anche come memoria agentica, questi sistemi sono sempre più citati come il percorso oltre RAG, ma Rajamohan ha affermato che il passaggio a quel tipo di architettura non elimina il problema del recupero strutturale. Questi sistemi dipendono ancora dal recupero al momento della question, il che significa che si applicano le stesse modalità di errore. La differenza principale sono i requisiti di latenza più flessibili, non una correzione di precisione.

Le due fasi fissano la ricerca convalidata

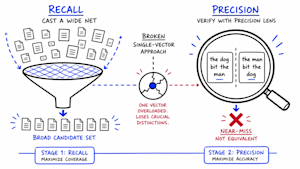

Il filo conduttore di ogni approccio fallito è lo stesso: un unico meccanismo di punteggio che cerca di gestire contemporaneamente sia il ricordo che la precisione. La ricerca ha convalidato un’architettura diversa: smettere di provare a svolgere entrambi i lavori con un unico vettore e assegnare ciascun lavoro a una fase dedicata.

Fase uno: ricordare. La prima fase funziona esattamente come fa oggi il recupero denso normal: il modello di incorporamento comprime i documenti in vettori e recupera le corrispondenze più vicine a una question. Qui non cambia nulla. L’obiettivo è gettare un’ampia rete e riportare rapidamente una serie di candidati forti. Ciò che conta in questa fase è la velocità e l’ampiezza, non la precisione perfetta.

Seconda fase: precisione. La seconda fase è quella in cui risiede la soluzione. Invece di assegnare un punteggio ai candidati con un singolo numero di somiglianza, un piccolo modello Transformer appreso esamina la question e ciascun candidato a livello di token, confrontando singole parole con singole parole per rilevare disallineamenti strutturali come inversioni di negazione o inversioni di ruolo. Questo è il passaggio di verifica che l’approccio a vettore singolo non può eseguire.

I risultati. Nell’ambito della formazione end-to-end, il verificatore Transformer ha sovraperformato ogni altro approccio testato dalla ricerca sul rifiuto strutturale dei quasi incidenti. Period l’unico approccio in grado di individuare in modo affidabile le modalità di guasto mancate dal sistema a vettore singolo.

Il compromesso. L’aggiunta di una fase di verifica comporta un costo di latenza. Il costo della latenza dipende dalla quantità di verifiche eseguite da un staff. Per carichi di lavoro sensibili alla precisione come applicazioni legali o contabili, è garantita la verifica completa a ogni question. Per la ricerca generica, una verifica più leggera potrebbe essere sufficiente.

La ricerca è nata da un problema produttivo reale. I clienti aziendali che utilizzavano sistemi di caching semantico ricevevano risposte rapide ma semanticamente errate: il sistema di recupero trattava question dal suono simile come identiche anche quando il loro significato period diverso. L’architettura a due fasi è la soluzione proposta da Redis, con l’incorporazione nel suo prodotto LangCache sulla roadmap ma non ancora disponibile per i clienti.

Cosa significa questo per i staff aziendali

La ricerca non richiede ai staff aziendali di ricostruire da zero le proprie pipeline di recupero. Ma chiede loro di sottoporre a check di pressione ipotesi che la maggior parte dei staff non ha mai esaminato, su cosa stanno effettivamente facendo i loro modelli di incorporamento, su quali metriche vale la pena fidarsi e dove si trovano le reali lacune di precisione nella produzione.

Riconosci il compromesso prima di adattarlo. Rajamohan ha affermato che il primo passo pratico è comprendere che la regressione esiste. Valuta qualsiasi sistema di recupero basato su LLM in base a tre criteri: correttezza, completezza e utilità. I fallimenti in termini di correttezza si riversano direttamente negli altri due, il che significa che un sistema di recupero che ottiene buoni punteggi nei parametri di riferimento ma fallisce nei quasi incidenti strutturali sta producendo un falso senso di disponibilità della produzione.

RAG non è obsoleto, ma sappi cosa non può fare. Rajamohan ha respinto con fermezza le affermazioni secondo cui RAG è stato sostituito. “Questa è una enorme semplificazione eccessiva”, ha detto. “RAG è una pipeline molto semplice che può essere prodotta praticamente da chiunque con un incremento minimo.” La ricerca non discute contro RAG come architettura. Si oppone al presupposto che una pipeline RAG a fase singola con un modello di incorporamento ottimizzato sia pronta per la produzione per carichi di lavoro sensibili alla precisione.

La soluzione è reale ma non gratuita. Per i staff che necessitano di maggiore precisione, Rajamohan ha affermato che l’architettura a due fasi non rappresenta un passaggio proibitivo all’implementazione, ma l’aggiunta di una fase di verifica costa latenza. “È un problema di mitigazione”, ha detto. “Non è qualcosa che possiamo effettivamente risolvere.”