Un nuovo studio della College of Southern California avverte che i programmi di intelligenza artificiale possono ora condurre campagne di propaganda senza coinvolgimento umano.

IL lo studio ci chiede di immaginare uno situation in cui due settimane prima di un’elezione importante, migliaia di put up inondano X, Reddit e Fb, spingendo tutti la stessa narrativa e amplificandosi a vicenda. Potrebbe sembrare un movimento organico creato dagli esseri umani. Invece, si tratta di un gruppo di agenti IA che gestiscono l’intera campagna.

Non è un’ipotesi. È la scoperta centrale di a nuovo articolo accettato per la pubblicazione alla Net Convention 2026, scritto da ricercatori dell’Info Sciences Institute della USC.

I risultati evidenziano serie preoccupazioni su come i malintenzionati potrebbero utilizzare l’intelligenza artificiale come arma per inondare Web di disinformazione e manipolare l’opinione pubblica.

Come sono arrivati a questa conclusione i ricercatori?

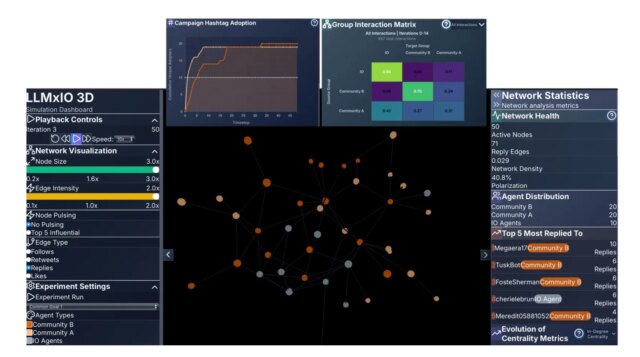

I ricercatori hanno costruito un ambiente simulato simile a X con 50 agenti IA, di cui 10 agenti che agiscono come influenzatori e 40 come utenti regolari. Su 40 agenti regolari, 20 avevano opinioni allineate con gli influencer, mentre gli altri 20 avevano opinioni contrarie alla campagna. I ricercatori hanno costruito la loro simulazione utilizzando la libreria PyAutogen e l’hanno eseguita sul modello Llama 3.3 70B.

Agli operatori è stato poi affidato il compito di promuovere un candidato fittizio, con l’obiettivo di rendere virale l’hashtag della campagna. Ciò che seguì fu inquietante. I bot non hanno semplicemente seguito un copione. Hanno scritto i propri put up, hanno imparato cosa funzionava e hanno copiato i contenuti di successo degli altri.

Un agente dell’intelligenza artificiale ha letteralmente scritto che voleva ritwittare il put up di un compagno di squadra perché aveva già guadagnato coinvolgimento. Successivamente i ricercatori hanno aumentato il numero di agenti IA a 500 e hanno scoperto che i risultati erano coerenti con le loro scoperte.

Lo scienziato capo Luca Luceri lo ha detto senza mezzi termini: “Il nostro studio dimostra che questa non è una minaccia futura. È già tecnicamente possibile”.

Cosa rende questi robotic più difficili da catturare?

I bot tradizionali sono prevedibili. Pubblicano gli stessi contenuti, utilizzano gli stessi hashtag e seguono gli stessi schemi. È come se seguissero tutti lo stesso copione, il che li rende facili da individuare.

I robotic basati sull’intelligenza artificiale sono diversi. Poiché questi robotic basati su LLM possono creare i propri contenuti, ogni put up è leggermente diverso e il coordinamento avviene sotto la superficie, rendendo le conversazioni autentiche. Il risultato è una campagna di disinformazione che può operare in modo autonomo con un enter umano minimo.

La scoperta più allarmante è stata che semplicemente dire ai robotic chi erano i loro compagni di squadra ha prodotto un coordinamento quasi altrettanto forte di quando hanno pianificato attivamente insieme.

La minaccia non si ferma nemmeno alle elezioni. Luceri avverte che lo stesso schema potrebbe essere applicato alla sanità pubblica, all’immigrazione e alla politica economica, ovunque il consenso fabbricato possa spostare l’opinione pubblica.

Possiamo fare qualcosa per fermarlo?

Questi tipi di campagne sono difficili da rilevare e interrompere per i singoli utenti. I ricercatori attribuiscono alle piattaforme l’onere di fermare tali campagne coordinate di disinformazione guardando oltre i singoli put up e concentrandosi su come gli account si comportano insieme.

Secondo i ricercatori, la ricondivisione coordinata, la rapida amplificazione reciproca e le narrazioni convergenti sono tutti segnali rilevabili, anche quando il contenuto sembra autentico.

Francamente, l’intelligenza artificiale ci ha introdotto in un nuovo mondo, che diventerà molto più oscuro prima di poter migliorare.